Rétrospective de mars 2026

Dans notre newsletter mensuelle de mars 2026, nous avons observé l’impasse au MC14 de l’OMC concernant le moratoire sur le commerce électronique, qui a conduit à son expiration, alors même qu’une coalition proposait un accord commercial numérique plurilatéral. Nous avons examiné ce que cela signifie et ce qui va suivre.

Deux récents verdicts rendus par des jurys américains ont jugé Meta et YouTube responsables de préjudices causés à des mineurs, notamment l’exposition à des contenus à caractère sexuel et la dépendance aux réseaux sociaux. Prises ensemble, ces affaires vont au-delà des questions de modération des contenus pour s’étendre à la conception même des plateformes.

Le Mécanisme mondial tant attendu a enfin été lancé, créant le premier forum permanent des Nations unies sur la sécurité des TIC depuis 1998 — mais sa session inaugurale a laissé de nombreuses questions en suspens quant à son fonctionnement concret. Voici pourquoi cela est important et ce qu’il faut surveiller à mesure que le Mécanisme prend forme.

Allons-nous un jour acheter de l’intelligence au mètre ? Ce n’est pas encore certain, mais la simple idée soulève des questions sur le contrôle, l’accès, et la manière dont nous mesurerons et consommerons l’intelligence à l’avenir.

En plus : les principales évolutions de la politique numérique en mars et un résumé de Genève.

Coup d’oeil : les événements qui ont fait la une en mars

TECHOLOGIES

Un nouveau plan de développement quinquennal approuvé par les législateurs à Pékin met l’accent sur l’innovation et les technologies de pointe pour stimuler la croissance économique future et le leadership mondial, en donnant la priorité à l’IA, à la robotique, à l’aérospatiale, aux biotechnologies et à l’informatique quantique, tout en réduisant la dépendance vis-à-vis des technologies étrangères. Il prévoit également une augmentation des financements, les dépenses scientifiques devant augmenter d’environ 10 % par an et la R&D globale d’au moins 7 %.

Le gouvernement britannique a annoncé un budget pouvant atteindre 2 milliards de livres sterling pour les technologies quantiques, dont plus d’un milliard au cours des quatre prochaines années, ainsi qu’un nouveau programme d’approvisionnement appelé ProQure destiné à favoriser le développement de l’informatique quantique au Royaume-Uni. Ce financement soutiendra plusieurs domaines : plus de 500 millions de livres sterling pour l’informatique quantique, 125 millions pour les réseaux quantiques et 205 millions de livres sterling pour la détection et la navigation quantiques, ainsi que des allocations plus modestes pour les pôles de recherche, les infrastructures, les compétences et la commercialisation.

L’UE a lancé un appel à projets doté de 180 millions d’euros visant à renforcer la résilience des câbles Internet sous-marins en soutenant la mise en place de systèmes de secours, d’itinéraires alternatifs et de mesures de redondance. Ce financement a pour objectif de réduire le risque de pannes et les menaces externes pesant sur les infrastructures sous-marines critiques, ce qui témoigne de la préoccupation croissante de l’UE en matière de résilience numérique, de cybersécurité et de souveraineté technologique.La Chine a autorisé NEO, une interface cerveau-ordinateur mise au point par Neuracle, à être utilisée au-delà des essais cliniques afin d’aider les personnes souffrant de paralysie sévère à retrouver la mobilité de leurs mains. L’implant capte les signaux cérébraux lorsque les utilisateurs imaginent bouger leur main et les traduit en commandes destinées à un gant robotisé ; les premiers résultats des essais montrent une amélioration de la capacité à accomplir des tâches quotidiennes telles que saisir des objets, manger et boire.

SÉCURITÉ

Le président américain Donald Trump a publié la stratégie nationale de cybersécurité de son administration, qui définit les priorités dans six domaines d’action : les opérations cyberoffensives et cyberdéfensives, la sécurité des réseaux fédéraux, la protection des infrastructures critiques, la réforme réglementaire, le leadership en matière de technologies émergentes (notamment dans le domaine de l’IA) et le développement des compétences de la main-d’œuvre.

M. Trump a également signé un décret le même jour, enjoignant le ministre de la Justice de donner la priorité aux poursuites en matière de cybercriminalité, chargeant les agences d’examiner les outils permettant de lutter contre les organisations criminelles internationales, et confiant au Département de la Sécurité intérieure des responsabilités accrues en matière de formation. Ce document stratégique compte cinq pages de texte de fond, que les responsables de l’administration qualifient de délibérément général. La Maison Blanche a indiqué que des directives de mise en œuvre plus détaillées suivraient.

Le groupe de hackers pro-iranien Handala a revendiqué la responsabilité d’une cyberattaque contre le géant américain des dispositifs médicaux Stryker. Le groupe a déclaré que cette cyberattaque constituait une riposte à une frappe de missile contre une école primaire en Iran. Stryker a confirmé la cyberattaque dans un communiqué, précisant que le traitement des commandes, la fabrication et les expéditions étaient perturbés, mais que les produits connectés n’avaient pas été affectés. Le FBI a ensuite procédé à la saisie de quatre sites web liés à Handala, le groupe de hackers pro-iranien ayant revendiqué l’attaque, ainsi qu’au ministère iranien du Renseignement et de la Sécurité (MOIS).

Les Gardiens de la Révolution iraniens ont menacé de prendre pour cible les grandes entreprises technologiques américaines, notamment Apple, Google, Meta, Microsoft, Intel, Oracle, Nvidia, Tesla et Palantir, si d’autres dirigeants iraniens venaient à être assassinés, accusant ces entreprises d’avoir contribué à l’identification des cibles d’assassinat. L’armée iranienne a également affirmé avoir pris pour cible des centres de communication, de télécommunications et industriels israéliens en réponse aux attaques contre les infrastructures iraniennes.

Longtemps limité par une doctrine de sécurité défensive, le Japon va introduire des pouvoirs de « contre attaque informatique » à partir du mois d’octobre. Ce changement s’inscrit dans le cadre de la loi japonaise sur la « cyberdéfense active », adoptée en 2025 et dont la mise en œuvre se déroule par étapes jusqu’en 2027.

L’UE a imposé des sanctions à la suite de cyberattaques visant ses États membres et ses partenaires, en inscrivant sur la liste noire les sociétés chinoises Integrity Technology Group et Anxun Information Technology, ainsi que la société iranienne Emennet Pasargad et les cofondateurs d’Anxun. Ces sanctions prévoient le gel des avoirs et une interdiction de voyager pour les personnes visées. Il est en outre interdit aux citoyens et aux entités de l’UE de mettre des fonds à la disposition des sociétés désignées.

Les autorités néerlandaises ont indiqué que des pirates informatiques — soupçonnés d’être liés à la Russie — ont lancé des opérations de hameçonnage à grande échelle visant des diplomates, des militaires, des responsables gouvernementaux et des journalistes. Au lieu de contourner le cryptage des applications, les attaquants incitent les utilisateurs à leur communiquer des codes de vérification ou à associer leurs appareils, ce qui leur permet de prendre le contrôle des comptes et d’accéder à des conversations sensibles.

Les services de renseignement portugais ont émis une alerte similaire, décrivant une campagne mondiale menée par des acteurs soutenus par des États étrangers qui cherchent à accéder aux comptes de messagerie de responsables et d’autres personnes détenant des informations confidentielles. Une fois qu’ils ont pris le contrôle d’un compte, les pirates peuvent lire les conversations, accéder aux fichiers partagés et utiliser le profil compromis pour cibler d’autres victimes par le biais de nouvelles tentatives d’hameçonnage.

L’Union européenne a lancé son programme antiterroriste « ProtectEU » afin de renforcer la vigilance face à l’évolution des menaces, en mettant particulièrement l’accent sur la manière dont les terroristes utilisent les outils numériques tels que les réseaux sociaux, l’intelligence artificielle, les plateformes cryptées, les crypto-actifs et les drones. Ce plan combine un renforcement du renseignement et du soutien d’Europol, une application plus stricte de la réglementation relative aux contenus en ligne dans le cadre de la loi sur les services numériques (DSA), la protection des espaces publics et des infrastructures critiques, ainsi qu’une coopération internationale plus étroite.

INTERPOL a lancé un nouveau groupe de travail mondial lors du Sommet mondial sur la fraude 2026, dans le cadre d’une réponse plus coordonnée et fondée sur les données face à l’expansion rapide de la fraude financière à l’échelle mondiale. Ce groupe de travail, mis en place conjointement par le ministère de l’Intérieur britannique et INTERPOL, porte le nom de code « Opération Shadow Storm ». Il ciblera les centres frauduleux et leurs liens avec la cybercriminalité et la traite des êtres humains, en recourant à des outils tels que les mécanismes de blocage des paiements et les réseaux internationaux de partage de renseignements. Dans un premier temps, le groupe de travail s’attachera à démanteler les opérations criminelles en Asie du Sud-Est.

Parallèlement, de grandes entreprises technologiques et grand public, notamment Google, Amazon, Meta et OpenAI, ont signé l’« Accord sectoriel contre les escroqueries et la fraude en ligne » lors du Global Fraud Summit 2026. Ces entreprises se sont engagées à mettre l’accent sur le déploiement de mesures de sécurité proactives et de systèmes de détection basés sur l’IA ; à renforcer le partage d’informations entre le secteur privé et les forces de l’ordre afin de mieux identifier et lutter contre la fraude ; à améliorer la résilience grâce à des technologies défensives avancées et à des mécanismes de réaction rapide ; et à améliorer la sensibilisation du public afin d’aider les particuliers à reconnaître et à éviter les escroqueries.

L’UE n’a pas parvenu à trouver un accord sur la prolongation des règles temporaires permettant aux plateformes en ligne de détecter les contenus pédopornographiques, ce qui signifie que le cadre actuel devrait expirer en avril. Les règles existantes, en vigueur depuis 2021, permettent aux entreprises technologiques de scanner volontairement leurs services à la recherche de contenus préjudiciables, soutenant ainsi les efforts visant à identifier et à supprimer les contenus illégaux. Mais les négociations entre le Parlement européen et les États membres ont achoppé sur des questions clés — notamment sur la question de savoir si ces mesures devaient s’appliquer aux services cryptés. L’attention se porte désormais sur le cadre permanent longtemps retardé (le règlement sur l’exploitation sexuelle des enfants).

Le Brésil a lancé une nouvelle loi visant à renforcer la protection des enfants en ligne, marquant ainsi un tournant majeur dans la réglementation des plateformes numériques au sein du pays. Cette législation, connue sous le nom d’ECA Digital, impose des obligations telles que la vérification de l’âge, une surveillance plus stricte des contenus et la mise en place de mécanismes permettant de supprimer les contenus préjudiciables impliquant des mineurs sans qu’une décision de justice soit nécessaire. La loi vise également la conception des plateformes, en exigeant des entreprises qu’elles limitent les fonctionnalités susceptibles d’encourager une utilisation compulsive chez les enfants, telles que les notifications excessives, le profilage à des fins de publicité ciblée et les éléments de conception qui prolongent l’engagement des utilisateurs. La loi permet aux autorités d’imposer des avertissements et des amendes pouvant atteindre 10 millions de dollars en cas d’infraction. Dans les cas graves, les tribunaux peuvent ordonner la suspension ou l’interdiction des plateformes opérant au Brésil.

Le ministre indonésien de la Communication et des Affaires numériques a signé un décret gouvernemental qui interdit aux enfants de moins de 16 ans de posséder des comptes sur des plateformes numériques à haut risque. Cette mesure concernerait notamment YouTube, TikTok, Facebook, Instagram, Threads, X, Bigo Live et Roblox. La mise en œuvre de ce décret débutera progressivement à partir du 28 mars.

En Équateur, la question est abordée sous l’angle de la sécurité. Une proposition d’interdiction visant les moins de 15 ans s’explique par la crainte que des groupes criminels n’utilisent ces plateformes pour contacter et recruter des mineurs. Cela déplace la justification de la mesure, qui passe du bien-être à la prévention de la criminalité, et positionne les restrictions imposées aux réseaux sociaux comme faisant partie d’une réponse plus large en matière de sécurité.

Une proposition visant à interdire l’accès aux réseaux sociaux aux moins de 16 ans a été rejetée par les députés britanniques, avec 307 voix contre et 173 pour. Toutefois, un projet pilote soutenu par le gouvernement teste actuellement différentes formes de restriction — interdictions totales, limites de temps et couvre-feux — pendant six semaines. Les participants seront interrogés avant et après l’expérience afin d’évaluer les résultats sur le plan comportemental et pratique, notamment la facilité avec laquelle les restrictions peuvent être appliquées et la tendance des adolescents à contourner ces contrôles.

Le commissaire australien à la sécurité en ligne indique que les plateformes ont supprimé ou restreint l’accès à des millions de comptes d’utilisateurs de moins de 16 ans, conformément à l’interdiction d’accès aux réseaux sociaux imposée par le pays, mais que de graves problèmes de conformité persistent, notamment des systèmes de vérification de l’âge peu efficaces et des outils de signalement difficiles à utiliser pour les parents. Les enquêtes concernant cinq grandes plateformes se poursuivent, et des décisions en matière d’application de la loi sont attendues d’ici la mi-2026.

L’Autriche envisage d’interdire l’utilisation des réseaux sociaux aux enfants de moins de 14 ans, s’inscrivant ainsi dans une tendance internationale plus large visant à renforcer les règles de sécurité en ligne pour les jeunes. Le gouvernement affirme que cette mesure vise à protéger les enfants contre la conception addictive de ces plateformes, la violence, la désinformation et les normes de beauté nocives. Il prévoit également d’introduire une nouvelle matière scolaire consacrée aux médias et à la démocratie afin de renforcer la culture numérique.

La France examine actuellement un nouveau projet de loi visant à interdire l’accès aux réseaux sociaux aux enfants de moins de 15 ans, tout en proposant un couvre-feu numérique pour les adolescents plus âgés et en étendant les restrictions relatives à l’utilisation des téléphones portables à l’école aux établissements secondaires. Cette réglementation s’inscrit dans le cadre d’une initiative plus large visant à renforcer la lutte contre les dangers en ligne qui touchent les jeunes, notamment le cyberharcèlement, les contenus préjudiciables et l’exposition excessive aux écrans, et s’aligne sur des mesures similaires en matière de sécurité des enfants déjà mises en place dans des pays tels que l’Australie.

Une enquête suisse a révélé une forte méfiance du public à l’égard des grandes entreprises technologiques telles que Google, TikTok et Meta, la plupart des personnes interrogées les considérant comme axées sur le profit, influentes sur le plan politique et source de dépendance vis-à-vis de puissances étrangères. Dans le même temps, une majorité continue de percevoir la numérisation comme globalement positive, mais souhaite que l’État joue un rôle plus important pour garantir que l’IA, les algorithmes et les plateformes numériques ne nuisent pas à la démocratie ou à la société.

L’Australie a commencé à appliquer de nouvelles règles en matière de sécurité des enfants en ligne qui obligent les plateformes, notamment les réseaux sociaux, les boutiques d’applications, les services de jeux vidéo, les moteurs de recherche, les sites pornographiques et les agents conversationnels basés sur l’IA, à mettre en place des mesures de vérification de l’âge et à empêcher les mineurs d’accéder à des contenus préjudiciables ou explicites, y compris les interactions avec des agents conversationnels à caractère sexuel ou liées à l’automutilation. Le commissaire à la sécurité numérique (eSafety Commissioner) supervise l’application de ces règles, et les entreprises s’exposent à des amendes pouvant atteindre 49,5 millions de dollars australiens par infraction en cas de non-respect.

La présidente de la Commission européenne, Ursula von der Leyen a convoqué la première réunion du groupe d’experts spécial sur la sécurité des enfants en ligne, annoncé lors de son discours sur l’état de l’Union de 2025. Ce groupe d’experts fournira des conseils spécialisés sur la protection et l’autonomisation des enfants en ligne et examinera la possibilité d’harmoniser les limites d’âge pour l’accès aux réseaux sociaux. Le groupe d’experts a pour objectif de présenter un rapport assorti de recommandations au président de la Commission d’ici l’été 2026.

ÉCONOMIE

L’UE et le Canada ont entamé des négociations en vue d’un accord sur le commerce numérique visant à développer le volet numérique de leurs relations commerciales existantes, dans le but d’établir des règles plus claires pour le commerce numérique transfrontalier. Les discussions portent sur des questions telles que le commerce sans support papier, la reconnaissance des signatures électroniques et des contrats numériques, l’exonération des droits de douane sur les transmissions électroniques, ainsi que les restrictions en matière de localisation des données et d’exigences de transfert forcé de code source, tout en préservant la capacité des gouvernements à réglementer l’économie numérique.

L’UE et l’Australie ont consolidé leurs liens grâce à un nouveau partenariat en matière de sécurité et de défense, à la conclusion des négociations sur l’accord de libre-échange et au lancement des discussions sur l’adhésion de l’Australie à Horizon Europe. Ensemble, ces initiatives visent à élargir la coopération dans les domaines de la cybersécurité, de la gestion des crises, de l’intelligence artificielle et d’autres technologies émergentes, des flux de données, des matières premières critiques et du commerce, marquant ainsi un alignement stratégique plus large qui dépasse le simple cadre économique.

L’Australie s’oriente vers un régime national d’agrément pour les plateformes d’échange de cryptomonnaies et de tokenisation dans le cadre de sa réglementation des services financiers, suite à la recommandation d’une commission sénatoriale d’adopter le projet de loi de 2025 sur le cadre réglementaire des actifs numériques. Cette proposition permettrait de soumettre une plus grande partie du secteur des cryptomonnaies à une réglementation officielle, bien que les associations professionnelles mettent en garde contre le fait que des définitions trop larges pourraient, par inadvertance, concerner certains fournisseurs d’infrastructures et certains services liés aux portefeuilles.

Meta a annoncé que les chatbots IA tiers seront à nouveau autorisés à fonctionner via WhatsApp en Europe moyennant des frais, annulant ainsi les restrictions précédentes qui limitaient l’accès aux services de chatbots concurrents sur la plateforme. Dans le cadre de ce nouvel accord, les entreprises pourront distribuer des chatbots IA à usage général via l’API WhatsApp Business pendant 12 mois. Ce changement vise à donner aux régulateurs européens le temps de mener à bien leur enquête tout en permettant aux services IA concurrents de fonctionner au sein de l’écosystème de la plateforme.

Google va revoir en profondeur les règles de son Play Store après avoir résolu un différend de longue date avec Epic Games, le créateur de Fortnite. Ces changements comprennent la réduction des commissions sur les achats intégrés à 20 %, l’ajout de frais de 5 % pour les développeurs utilisant le système de facturation de Google, ainsi que la réduction des frais d’abonnement à 10 %, tout en facilitant l’installation de boutiques d’applications alternatives sur Android. Dans le cadre de cet accord, Epic réintroduira Fortnite sur le Play Store tout en poursuivant le développement de sa propre boutique d’applications Android.

La réunion de l’OMC s’est terminée sans accord sur la prolongation du moratoire sur les droits de douane sur le commerce électronique, tandis qu’un groupe de membres a proposé un accord distinct sur le commerce numérique. Pour en savoir plus, consultez notre article dédié.

La BCE a lancé Appia, une stratégie visant à développer les marchés financiers tokenisés en Europe, avec Pontes comme solution de règlement basée sur la technologie des registres distribués (DLT) qui reliera l’infrastructure des marchés tokenisés à l’Eurosystème et permettra la mise en place de projets pilotes à partir du troisième trimestre 2026. Ce plan a pour objectif de faciliter la transition de la finance traditionnelle vers les marchés tokenisés tout en préservant la stabilité financière, le règlement par la banque centrale et l’interopérabilité ; il est désormais ouvert à la consultation publique.

Une étude conjointe de l’OIT et de la Banque mondiale révèle que l’IA aura des répercussions inégales sur l’emploi dans 135 économies. Les économies avancées sont davantage exposées, en particulier dans les secteurs administratif et professionnel, tandis que les pays en développement risquent de subir des perturbations sans bénéficier de gains de productivité comparables, car ils manquent souvent d’infrastructures, d’accès à Internet et des compétences nécessaires pour en tirer parti. Le rapport souligne que les conséquences dépendront moins de l’IA en soi que de la connectivité, de la formation, de la conception des emplois et des protections sociales.

JURIDIQUE

L’Organisation mondiale des données (WDO) a été lancée à Pékin en tant que nouvelle plateforme internationale à but non lucratif axée sur le développement et la gouvernance des données à l’échelle mondiale, avec pour objectif déclaré de réduire la fracture numérique mondiale, de soutenir l’économie numérique et d’améliorer la coopération internationale sur des questions telles que les flux transfrontaliers de données, la protection de la vie privée et la sécurité. Cette initiative s’inscrit dans une dynamique plus large visant à intégrer de manière plus structurée la gouvernance des données dans l’élaboration des politiques numériques mondiales.

Un tribunal luxembourgeois a annulé l’amende de 746 millions d’euros infligée à Amazon au titre du RGPD, non pas parce que les violations présumées de la vie privée auraient disparu, mais parce qu’il a estimé que la procédure de sanction engagée par l’autorité de régulation présentait des vices de procédure, notamment en ce qui concerne l’évaluation du degré de responsabilité d’Amazon. L’affaire va désormais être renvoyée à l’autorité luxembourgeoise de protection des données pour réexamen.

L’autorité italienne chargée de la protection des données a infligé une amende de 31,8 millions d’euros à Intesa Sanpaolo après qu’un employé a accédé à plusieurs reprises à des milliers de comptes clients sans autorisation et que la banque n’a pas détecté ces faits à temps. Les autorités de régulation ont déclaré que cette affaire avait mis en évidence de graves lacunes en matière de surveillance interne, de contrôles des risques, de mesures de protection de la confidentialité, de responsabilité et de notification des violations.

DÉVELOPPEMENT

Malte a lancé le projet SMART Food, une initiative malto-italienne qui utilise l’intelligence artificielle et la blockchain pour mettre en place une plateforme numérique permettant de suivre les produits alimentaires de la production à la consommation. L’objectif est d’améliorer la traçabilité, la transparence, la sécurité, la durabilité et la confiance dans le secteur agroalimentaire, tout en aidant les consommateurs et les producteurs à accéder à des informations en temps réel sur les produits.

La Chine a révisé ses règles relatives au recensement agricole national de 2026, élargissant la portée de ce dernier afin de couvrir non seulement l’agriculture, mais aussi le développement industriel rural et la construction des villages, tout en introduisant de nouvelles méthodes de collecte de données telles que la télédétection. Les règles actualisées renforcent également les contrôles de qualité des données, les obligations de confidentialité et les sanctions en cas de falsification des statistiques, ce qui témoigne d’une volonté accrue de diversifier la collecte de données rurales et de renforcer la surveillance de l’État.

Le Royaume-Uni et les Philippines ont conclu un nouvel accord de partenariat visant à développer la coopération dans les domaines de l’éducation numérique et des technologies éducatives, en associant l’expertise et le soutien financier du Royaume-Uni aux priorités des Philippines en matière d’éducation. Cette initiative vise à améliorer l’accès aux outils d’apprentissage numériques, au développement des compétences et aux technologies éducatives, tout en renforçant les relations bilatérales plus larges dans les domaines de l’innovation et du renforcement des capacités.

SOCIOCULTUREL

Les premiers rapports de transparence établis dans le cadre du Code de conduite sur la désinformation lié à la loi européenne sur les services numériques ont été publiés ; parmi les signataires figurent de grandes plateformes et des acteurs de la société civile, qui y décrivent les mesures qu’ils affirment prendre contre la désinformation, notamment en ce qui concerne la guerre en Ukraine et l’intégrité électorale. L’importance de ces rapports réside dans le fait qu’il s’agit des premiers rapports publiés depuis que le Code a été officiellement reconnu dans le cadre de la loi sur les services numériques (DSA) en février 2025, marquant ainsi le passage d’un système essentiellement volontaire à un système de corégulation plus structuré, fondé sur des engagements, des rapports et des audits.

L’UE examine actuellement la proposition de X visant à modifier son système de vérification par le Blue-Check après avoir constaté que la vérification payante sans contrôle d’identité rigoureux pouvait induire les utilisateurs en erreur au regard de la loi sur les services numériques. X s’était vu infliger une amende de 120 millions d’euros en décembre et avait obtenu un délai de 60 jours ouvrables pour présenter des mesures correctives, que la Commission évalue actuellement tandis que l’entreprise conteste également cette décision devant les tribunaux.

L’UNESCO a lancé une initiative de recherche axée sur l’Afrique du Sud concernant la gouvernance des contenus préjudiciables en ligne dans le cadre de son programme « Social Media 4 Peace », soutenu par l’UE, afin d’étudier les discours de haine, la désinformation, les lacunes réglementaires et la gouvernance des plateformes. L’objectif est de formuler des recommandations concrètes, fondées sur les droits, visant à renforcer la gouvernance numérique, la responsabilité des plateformes, la liberté d’expression et l’accès à l’information dans le contexte local.

L’Espagne a lancé HODIO, un outil numérique destiné à mesurer les discours de haine sur les réseaux sociaux. Combinant intelligence artificielle, analyse de données et expertise humaine, cet outil publiera des rapports semestriels classant les plateformes en fonction de l’exposition des utilisateurs à des contenus préjudiciables, dans le but d’éclairer l’élaboration des politiques et d’inciter les entreprises à agir. Cependant, des critiques ont émis des réserves quant à la transparence de HODIO et à la manière dont les autorités définiront et classeront les discours de haine, mettant en garde contre le fait que des critères mal définis pourraient porter atteinte à la liberté d’expression.

Ce mois-ci dans la gouvernance de l’IA

Cadres, stratégies et lignes directrices nationaux

États-Unis. Le gouvernement américain a dévoilé un cadre stratégique national en matière d’IA qui définit une approche globale de l’IA pour l’ensemble des agences fédérales. Ce cadre définit des priorités en matière de développement responsable de l’IA, de gouvernance des données, de formation de la main-d’œuvre et de collaboration internationale, tout en mettant l’accent sur les garanties éthiques, les résultats d’intérêt public et la sécurité nationale. Il préconise également une accélération des investissements dans la recherche et le déploiement de l’IA, ainsi que la mise en place de mécanismes de contrôle coordonnés visant à garantir la transparence et la responsabilité au sein des systèmes fédéraux d’IA.

Égypte. Le 14 mars 2026, l’Égypte a publié les Lignes directrices nationales pour une IA fiable et responsable. Ces lignes directrices constituent une référence nationale pour le développement, le déploiement et la supervision responsables de l’IA dans les secteurs public et privé, garantissant une utilisation sûre, éthique et transparente de l’IA tout en soutenant l’innovation conformément à la Vision 2030 de l’Égypte et à la stratégie nationale en matière d’IA. Complétant le cadre national de gouvernance de l’IA, qui définit ce qui doit être régi, ces lignes directrices précisent les modalités de mise en conformité, en proposant des méthodologies, des indicateurs et des listes de contrôle pour mettre en œuvre les principes éthiques. Destinées aux scientifiques des données, aux responsables de la conformité et aux développeurs, elles fournissent des orientations concrètes pour protéger les droits individuels, promouvoir le bien-être de la société, renforcer la responsabilité et la transparence, et favoriser une innovation fondée sur la sécurité. Ces lignes directrices alignent également l’Égypte sur les normes internationales et engagent les entités gouvernementales, les entreprises privées et les acteurs communautaires dans une gouvernance responsable de l’IA.

Corée du Sud. La Corée du Sud a dévoilé une stratégie nationale visant à devenir l’une des trois premières puissances mondiales en matière d’IA d’ici 2028. Ce plan associe des investissements dans les infrastructures numériques, les systèmes de données et la connectivité de nouvelle génération. Les autorités ont pour objectif d’étendre les réseaux en développant les capacités 5G et en préparant le déploiement commercial de la 6G d’ici 2030. La cybersécurité et l’intégration des données constituent également des priorités essentielles pour soutenir un écosystème numérique plus solide. La stratégie prévoit le développement des talents à tous les niveaux d’enseignement et l’investissement dans des technologies clés telles que les semi-conducteurs et l’informatique quantique. L’adoption de l’IA devrait s’étendre à tous les secteurs, notamment l’industrie manufacturière, la santé et l’agriculture.

Souveraineté

L’UE. Des tensions apparaissent au sein de l’UE concernant les investissements dans les infrastructures d’IA : la France, la Pologne, l’Autriche et la Lituanie font pression pour qu’une partie du projet « AI Gigafactory », d’un montant de 20 milliards d’euros, soit réservée aux technologies européennes, tandis que l’Allemagne se montre sceptique quant à l’idée de lier ce projet aux objectifs de souveraineté numérique. Parallèlement, l’Allemagne poursuit une expansion majeure de ses centres de données nationaux et de sa capacité de traitement en matière d’IA, soutenue par des réformes réglementaires, des incitations fiscales et l’attribution de terrains afin d’attirer les investissements, dans le but de réduire sa dépendance vis-à-vis des fournisseurs étrangers.

Russie. Le gouvernement russe propose des règles susceptibles d’interdire ou de restreindre l’utilisation d’outils d’IA étrangers tels que ChatGPT, Claude et Gemini s’ils ne stockent pas les données des utilisateurs russes sur le territoire national et ne se conforment pas aux exigences réglementaires de Moscou. Ces propositions, émanant du ministère du Développement numérique, visent à renforcer la volonté de la Russie de mettre en place un Internet souverain, afin de protéger les citoyens contre toute « manipulation cachée » et de faire respecter les « valeurs spirituelles et morales traditionnelles russes ». En vertu de ce projet de réglementation, les systèmes d’IA transfrontaliers qui transmettent des données d’utilisateurs à l’étranger seraient soumis à des restrictions, tandis que les modèles étrangers pouvant fonctionner entièrement au sein de l’infrastructure russe, tels que Qwen ou DeepSeek, pourraient être déployés en toute sécurité.

Politique en matière de contenu

L’UE. La Commission européenne a publié une deuxième version préliminaire de son code de bonnes pratiques sur le marquage et l’étiquetage des contenus générés par l’IA, dans le cadre des efforts visant à aider les entreprises à se conformer aux exigences de transparence prévues à l’article 50 de la loi européenne sur l’intelligence artificielle. La section 1 du code se concentre sur les fournisseurs de systèmes d’IA générative et propose une approche à plusieurs niveaux pour le marquage des contenus générés par l’IA, comprenant notamment des métadonnées signées numériquement, des filigranes imperceptibles, ainsi que, de manière facultative, l’apposition d’empreintes numériques ou la journalisation. Les fournisseurs sont également tenus de mettre à disposition des outils de détection afin que les utilisateurs et les autorités puissent vérifier si un contenu a été généré ou manipulé par l’IA. La section 2 s’adresse aux déployeurs de systèmes d’IA et exige une divulgation claire, au moyen d’étiquettes visibles et accessibles, lorsque des des fausses informations (deepfakes) ou des textes générés par l’IA destinés à informer le public ont été artificiellement créés ou manipulés.

Le Conseil européen a approuvé des propositions visant à interdire à l’IA de générer du contenu à caractère sexuel non consensuel (CSAM), à adapter les délais de mise en conformité pour les IA à haut risque et à rationaliser la loi sur l’IA, notamment en prévoyant des exemptions pour certaines PME, des obligations d’enregistrement et une clarification des responsabilités en matière de surveillance. Ces mesures s’inscrivent dans le cadre des efforts plus larges déployés par l’Europe pour garantir la souveraineté de ses infrastructures d’IA et assurer un déploiement sûr et responsable de l’IA.

Pays-Bas, France. Un tribunal néerlandais a ordonné à xAI et à son chatbot Grok de ne pas créer ni diffuser d’images à caractère sexuel non consenties. Le jugement impose aux opérateurs de Grok de mettre en place des mesures techniques visant à bloquer les requêtes ou les résultats susceptibles de générer des images intimes non consenties. Cette décision a été présentée comme une mesure nécessaire pour faire respecter les droits de la personne et la dignité à l’ère numérique, créant ainsi un précédent susceptible d’influencer les tribunaux européens confrontés aux préjudices causés par l’intelligence artificielle.

Par ailleurs, le parquet de Paris a déclaré que la polémique autour des deepfakes à caractère sexuel générés par Grok aurait pu être délibérément amplifiée. L’objectif présumé était de gonfler artificiellement la valeur de X et de xAI avant juin 2026, date à laquelle la nouvelle entité issue de la fusion entre SpaceX et xAI devrait être cotée en bourse.

Sécurité

Australie. Le commissaire à la sécurité en ligne a constaté que les chatbots d’accompagnement basés sur l’IA, notamment Character.AI, Nomi, Chai et Chub AI, ne parviennent pas à protéger les enfants contre les contenus préjudiciables, leurs mesures de protection contre les contenus sexuellement explicites et l’exploitation sexuelle des enfants étant insuffisantes. La plupart des plateformes s’appuyaient sur une vérification de l’âge autodéclarée, ne disposaient pas d’un suivi significatif des entrées et sorties de l’IA et ne fournissaient pas systématiquement de liens vers des services d’aide en cas de crise ou de soutien en santé mentale. La commissaire Julie Inman Grant a averti que, alors que les enfants recourent de plus en plus à des compagnons IA pour obtenir un soutien émotionnel, l’absence de mesures de sécurité solides concernant l’automutilation, le suicide et les contenus illicites pose de graves risques, le non-respect de ces mesures étant passible de sanctions civiles en vertu des codes australiens relatifs aux contenus soumis à restriction d’âge.

Au Royaume-Uni, Le Royaume-Uni. La ministre de la Science, de l’Innovation et de la Technologie a appelé les fournisseurs de services en ligne à renforcer les mesures de lutte contre les préjudices numériques visant les femmes et les filles, dans le cadre d’un engagement visant à réduire de moitié ce type de violence d’ici une décennie. La ministre a appelé les entreprises technologiques à mettre en œuvre les recommandations de l’Ofcom intitulées « Une vie en ligne plus sûre pour les femmes et les filles », qui décrivent des mesures telles que la réalisation d’évaluations des risques axées sur les femmes et les filles, l’évaluation préalable au lancement des fonctionnalités susceptibles de donner lieu à des abus, la mise en place de paramètres de confidentialité par défaut rigoureux, la démonétisation des contenus incitant à la violence, la limitation de la visibilité des contenus misogynes dans les résultats de recherche et les flux de recommandations, ainsi que la mise en place de limites de fréquence pour lutter contre le harcèlement coordonné. Ces lignes directrices devraient être mises en œuvre au plus tard d’ici la fin de l’année 2026.

États-Unis. Le gouvernement américain fait l’objet de deux poursuites judiciaires intentées par la société d’IA Anthropic après que le Pentagone a classé cette entreprise parmi les risques liés à la chaîne d’approvisionnement, ce qui a pour effet d’exclure sa technologie des contrats de défense.

Le ministère de la Justice fait valoir que cette désignation est légale et justifiée par des raisons de sécurité nationale, invoquant le refus d’Anthropic de permettre que son intelligence artificielle soit utilisée pour des armes autonomes et la surveillance intérieure. Anthropic, quant à elle, affirme que cette mesure est illégale et revêt un caractère de représailles, visant ses positions politiques plutôt qu’un véritable risque pour la sécurité.

Dans l’affaire californienne, un juge fédéral a temporairement empêché le gouvernement d’appliquer cette désignation. Le tribunal a estimé que le comportement d’Anthropic ne répondait pas aux critères juridiques prévus par l’article 3252, qui se limite aux menaces hostiles dissimulées telles que le sabotage ou la subversion de systèmes — et non aux prises de position publiques ou aux litiges contractuels. La décision met également en évidence des lacunes procédurales, notamment une évaluation des risques insuffisante, l’absence de consultation interinstitutionnelle et le fait de ne pas avoir envisagé de mesures moins restrictives.

Le juge a également soulevé des questions d’ordre constitutionnel, soulignant que cette désignation avait peut-être été influencée par les déclarations d’Anthropic et que l’entreprise avait probablement été privée d’une procédure régulière. Les preuves d’un préjudice immédiat et grave — perte de contrats, atteinte à la réputation et perturbation des relations commerciales — ont justifié l’octroi d’une injonction préliminaire, même si une décision définitive pourrait prendre des mois.

Parallèlement, Anthropic a engagé une deuxième procédure à Washington, D.C., pour contester son classement au sein de la chaîne d’approvisionnement devant une formation de trois juges de la Cour d’appel du circuit de Washington, D.C., en contestant plus particulièrement la base juridique invoquée en vertu de la loi fédérale sur la sécurité de la chaîne d’approvisionnement (FASCA).Ce litige a suscité un large soutien au sein du secteur technologique, des entreprises telles que Microsoft, Google, Amazon et OpenAI ayant apporté leur soutien à l’action en justice d’Anthropic par le biais de mémoires d’amicus curiae. Les leaders du secteur mettent en garde contre le fait que la classification adoptée par le gouvernement pourrait créer un précédent susceptible de déstabiliser l’écosystème américain de l’IA et de perturber les activités des fournisseurs travaillant à la fois avec les systèmes d’IA du secteur public et ceux du secteur privé.

Payer pour penser : une intelligence facturée à l’usage

« Nous envisageons un avenir où l’intelligence sera un service public, à l’instar de l’électricité ou de l’eau, et où les gens l’achèteront chez nous via un compteur pour l’utiliser comme bon leur semble », a récemment déclaré Sam Altman, PDG d’OpenAI.

À première vue, cela pourrait ressembler à une vision d’autonomisation : un accès à la demande à un raisonnement surhumain, accessible à quiconque dispose de suffisamment d’argent pour se le procurer. Mais la métaphore d’Altman est pertinente. Les services publics n’appartiennent pas à la collectivité ; ils sont contrôlés par de puissants fournisseurs qui fixent les tarifs, les conditions et l’infrastructure.

Nos connaissances sont déjà en train d’être commercialisées par les entreprises technologiques et le secteur de la publicité. Mais ce que laisse entrevoir le PDG d’OpenAI, c’est un monde dans lequel l’intelligence elle-même serait confiée à une poignée de plateformes.

La mainmise de l’IA sur l’intelligence remet en cause l’un des piliers de la civilisation, érigé au fil des millénaires : celui selon lequel la connaissance définit ce que signifie être humain.

Altman ne se contente donc pas de décrire un modèle économique ; il esquisse également un nouvel ordre social, dans lequel l’intelligence est centralisée, privatisée, puis revendue à l’humanité par les grandes entreprises spécialisées dans l’IA.

Ce n’est pas un avenir inévitable. La lutte pour l’intelligence et le savoir humains – c’est-à-dire pour savoir à qui appartient la capacité de penser, de connaître et de décider – n’est pas encore terminée.

La véritable alternative à la mainmise sur nos connaissances et à leur facturation n’est pas de renoncer à l’IA ; la véritable alternative consiste à considérer l’IA comme un prolongement de nos connaissances personnelles, partagées au sein des communautés, des pays et de l’humanité tout entière, conformément à nos préférences.

Les communautés, les universités, les entreprises et les pays peuvent développer une IA ascendante, ancrée dans leurs propres langues, valeurs et systèmes de connaissances. Les modèles open source ont rendu l’IA centrée sur l’humain techniquement possible et financièrement abordable. Cela conduirait à un écosystème distribué dans lequel l’IA renforcerait les communautés humaines au lieu de les subordonner.

Ce texte est une adaptation de l’article de blog du Dr Jovan Kurbalija intitulé «La guerre que nous ne voyons pas : le combat pour l’avenir du savoir humain.».

Du contenu au design : les verdicts marquent le début d’une nouvelle ère de responsabilité pour les géants de la technologie

Deux récents verdicts rendus par des tribunaux américains commencent à redéfinir les limites de la responsabilité des plateformes de réseaux sociaux, avec des implications qui vont bien au-delà des cas individuels.

Au Nouveau-Mexique, un jury a condamné Meta à verser 375 millions de dollars après avoir conclu que l’entreprise avait induit les utilisateurs en erreur quant à la sécurité de ses plateformes pour les enfants. Le procès, intenté par le procureur général Raul Torrez, reprochait à Meta d’avoir enfreint les lois de l’État en matière de protection des consommateurs en présentant de manière trompeuse la sécurité de ses plateformes pour les mineurs, tout en développant des fonctionnalités et des algorithmes qui, selon les procureurs, incitent à une utilisation prolongée et exposent les enfants à des risques importants. Ces risques comprennent une dépendance, l’exposition à des contenus sexuels préjudiciables, des communications privées non désirées avec des adultes, des troubles du sommeil dus à une utilisation compulsive, ainsi que des environnements où les prédateurs peuvent agir avec une relative facilité. Les jurés ont pris connaissance d’études internes et de témoignages d’anciens employés, dont le lanceur d’alerte Arturo Béjar, suggérant que l’entreprise avait connaissance de ces risques mais n’avait pas suffisamment averti le public ni pris de mesures pour atténuer les préjudices. Meta a rejeté le verdict et compte faire appel.

Parallèlement, un juge de Los Angeles est parvenu à une conclusion similaire dans un autre contexte. Il a estimé que Meta et YouTube — propriété de Google — avaient fait preuve de négligence dans la conception et l’exploitation de leurs plateformes, dans une affaire portant sur la dépendance aux réseaux sociaux. Le procès, intenté par une jeune femme identifiée sous le nom de K.G.M., faisait valoir que l’utilisation compulsive de ces plateformes pendant son adolescence avait contribué à une dépression, à de l’anxiété et à une dysmorphie corporelle. Le juge a donné raison à la plaignante, lui accordant 6 millions de dollars de dommages-intérêts et attribuant 70 % de la responsabilité à Meta et 30 % à Google. Les deux entreprises ont déclaré qu’elles feraient appel, soutenant que les conséquences sur la santé mentale ne peuvent être attribuées à une seule plateforme.

Pourquoi est-ce important ? Les sanctions financières infligées dans ces affaires sont modestes pour des entreprises de cette envergure. L’importance plus large de ces jugements réside ailleurs.

Historiquement, les plateformes se sont appuyées sur des protections juridiques — notamment l’article 230 de la loi américaine sur les communications — pour se prémunir contre toute responsabilité concernant les contenus générés par les utilisateurs. Ces décisions judiciaires commencent toutefois à mettre à l’épreuve une théorie différente : celle selon laquelle la responsabilité peut découler non seulement de ce que les utilisateurs publient, mais aussi de la manière dont les plateformes structurent, recommandent et amplifient ces contenus.

Cette distinction est importante car elle touche au cœur même du modèle économique actuel des réseaux sociaux. Des plateformes telles que Meta et Google sont conçues pour maximiser l’engagement des utilisateurs — temps passé, interactions et consommation de contenu —, ce qui génère à son tour des revenus publicitaires. Pour y parvenir, elles s’appuient sur des systèmes de recommandation, des interfaces fluides et des fonctionnalités de conception comportementale telles que la lecture automatique, le défilement infini et les notifications push. Il ne s’agit pas là d’éléments accessoires ; ils sont essentiels à la manière dont ces plateformes fidélisent leurs utilisateurs et monétisent leur attention.

L’argument juridique qui se fait jour est que certains de ces choix de conception peuvent contribuer activement à causer un préjudice, en particulier chez les mineurs. Dans l’affaire du Nouveau-Mexique, l’accent a été mis sur l’exposition à des contenus préjudiciables et exploitants. À Los Angeles, on a insisté sur l’utilisation compulsive et ses effets sur la santé mentale. Mais ces deux affaires convergent vers un point similaire : l’architecture même de la plateforme — et pas seulement des défaillances isolées au niveau des contenus — peut créer des risques prévisibles.

Si ce raisonnement venait à s’imposer devant les tribunaux, cela exercerait une nouvelle forme de pression sur les entreprises technologiques. Le problème ne réside pas dans le montant d’une amende prise isolément, mais dans l’effet cumulatif de milliers de poursuites similaires, dans l’augmentation des coûts de mise en conformité et dans la possibilité que des décisions de justice créant des précédents redéfinissent les pratiques de conception jugées acceptables. Les systèmes visant à maximiser l’engagement, longtemps considérés comme un avantage concurrentiel, pourraient devenir une source de vulnérabilité juridique.

Cela crée une tension structurelle. Pour réduire les effets néfastes, il peut s’avérer nécessaire de limiter précisément les caractéristiques qui permettent aux plateformes d’attirer si efficacement l’attention. Même des baisses modestes, lorsqu’elles s’appliquent à des milliards d’utilisateurs, peuvent se traduire par des répercussions importantes sur les revenus.

La marche à suivre. La voie à suivre. Il est peu probable que les entreprises abandonnent purement et simplement leurs modèles de base. Une adaptation constitue une réponse plus probable. Cela pourrait passer par une réoptimisation des algorithmes en faveur de formes d’interaction plus sûres, une segmentation des produits par tranche d’âge avec des paramètres par défaut plus stricts pour les mineurs, ainsi que des investissements dans des mécanismes de sécurité et d’audit plus robustes. On pourrait également assister à une transition progressive vers d’autres sources de revenus — telles que les abonnements, la monétisation des créateurs ou les intégrations commerciales — afin de réduire la dépendance à l’égard de la publicité purement basée sur l’attention.

La stratégie juridique jouera également un rôle. Meta et Google font tous deux appel de ces verdicts, et les décisions futures détermineront jusqu’où les tribunaux sont prêts à aller pour attribuer un préjudice à des choix de conception. Les entreprises sont susceptibles de renforcer leurs obligations d’information, d’étendre les contrôles parentaux et de documenter leurs évaluations internes des risques afin de démontrer leur diligence raisonnable. De telles mesures n’élimineront peut-être pas la responsabilité, mais elles peuvent influencer la manière dont celle-ci est interprétée.

En fin de compte, la question clé est de savoir si ces affaires constituent des cas isolés ou le début d’un changement juridique plus large.

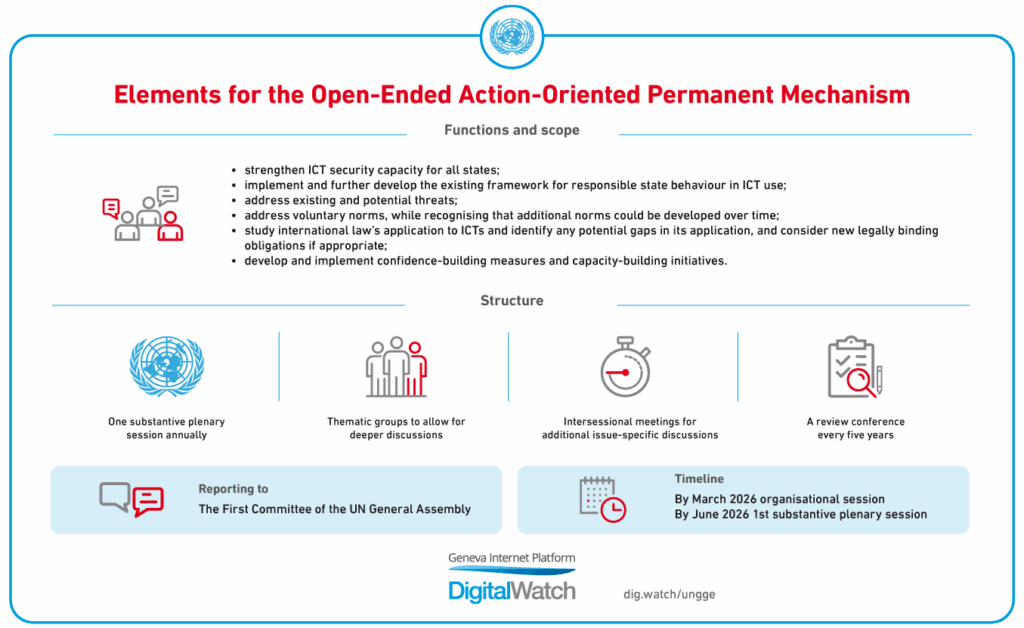

L’ONU lance un mécanisme mondial sur la sécurité des TIC, mais l’avenir reste incertain

Après quasi trois décennies de négociations en dents de scie sur la cybersécurité au sein des Nations unies, le Mécanisme mondial sur la sécurité des TIC, tant attendu, a enfin vu le jour.

Il s’agit du premier forum permanent de ce type depuis le début des discussions sur la sécurité des TIC en 1998, et sa simple existence en dit long sur le chemin parcouru par ces pourparlers.

Mais si ce lancement a été perçu comme une avancée majeure, la session d’organisation a rapidement ramené les choses à la réalité. Au-delà de ce qui avait déjà été esquissé dans l’annexe C et dans le rapport final du Groupe de travail à composition non limitée (GTCNL) , la manière dont le Mécanisme s’organiserait concrètement restait floue.

Cette session a soulevé de nombreuses questions — concernant la structure, les priorités et les procédures — mais n’a apporté que peu de réponses concrètes, laissant planer le doute : si le Mécanisme existe désormais, ce qu’il fera et comment il s’y prendra reste encore largement à préciser.

Un nouvel organe, un nouveau mandat et une présidente nouvellement élue, Egriselda López, du Salvador, ont insufflé un regain d’optimisme à la première session organisationnelle du Mécanisme mondial. Pourtant, en l’espace de quelques minutes, il est apparu clairement que le Mécanisme mondial ne partait pas d’une page blanche, mais héritait plutôt de la longue liste de désaccords du GTCNL

La Russie a ouvert la discussion en contestant la légitimité de la nomination de la présidente, affirmant que celle-ci avait été guidée uniquement par l’UNODA et avait ainsi limité la participation des États au processus. Elle a saisi cette occasion pour souligner que toutes les décisions prises dans le cadre du nouveau processus devaient être fondées sur le consensus et être entièrement intergouvernementales.

Les points importants à l’ordre du jour

En ce qui concerne l’ordre du jour provisoire de la session de juillet du mécanisme, la présidence a diffusé un projet d’ordre du jour articulé autour des cinq piliers du cadre régissant le comportement responsable des États dans l’utilisation des TIC. Toutefois, l’Iran et la Russie ont fait valoir que la formulation du point 5 de l’ordre du jour ne reflétait pas fidèlement le paragraphe 9 de l’annexe C du rapport final du Groupe de travail à composition non limitée (GTCNL) et ont demandé qu’une correction soit apportée lors de cette session. L’UE et le Canada ont rejeté cette demande, faisant valoir que le projet faisait déjà référence à tous les documents pertinents et que le fait d’isoler un paragraphe constituerait en soi une renégociation. Les États-Unis ont entièrement réservé leur position, préférant que la plénière de juillet adopte son propre ordre du jour. Aucun consensus n’a été atteint, et le Président poursuivra ses consultations avant juillet.

Ce mécanisme a hérité de ses prédécesseurs de nombreux débats de fond restés en suspens.

En matière de droit international, il est largement admis qu’il reste encore beaucoup à faire, mais les avis divergent quant à la manière de s’y prendre. La majorité des délégations se sont clairement prononcées en faveur d’un renforcement du cadre normatif existant et d’une réaffirmation de l’applicabilité de la Charte des Nations Unies au cyberespace.

Une large majorité d’États s’est prononcée en faveur du maintien d’un mécanisme axé sur l’action, mettant fortement l’accent sur l’aspect pratique et la mise en œuvre des cadres convenus en matière de droit international, de normes, de mesures de confiance et de renforcement des capacités (Chili, Nauru, Portugal, Suisse, Royaume-Uni, Estonie, Italie, Australie, République démocratique du Congo, Antigua-et-Barbuda, le Soudan, Vanuatu, l’Albanie, le Vietnam, l’Inde, la Grèce, le Rwanda, la République dominicaine, la Macédoine du Nord, Kiribati).

En particulier, certaines délégations ont plaidé en faveur de l’application du cadre à des scénarios concrets afin de stimuler sa mise en œuvre (Japon, Pays-Bas, Royaume-Uni, Soudan). La Chine a été la seule délégation à souligner que le développement du cadre était tout aussi important que sa mise en œuvre.

L’UE a mis en avant la liste de contrôle des normes, une question qui avait fait l’objet de vifs débats dans le cadre du mécanisme précédent, comme un domaine nécessitant des améliorations supplémentaires.

Toutefois, pour de nombreux États, une préoccupation fondamentale demeure. Les initiatives de renforcement des capacités risquent de s’enliser sans financement fiable ; c’est pourquoi de nombreuses délégations, principalement issues de pays en développement, ont exhorté le Mécanisme mondial à donner la priorité à la mise en œuvre du Fonds volontaire des Nations unies, qui avait été proposé mais laissé en suspens par le Groupe de travail à composition ouverte (GTCNL).

Groupes thématiques spécialisés : qui, quoi et comment

L’ordre du jour souvent très chargé et les déclarations interminables des délégations lors des séances plénières du GTCNL laissaient peu de place à une analyse technique approfondie, ce qui a suscité la frustration de nombreuses délégations face au fossé existant entre les formulations consensuelles et les mesures concrètes.

Les groupes thématiques spécialisés (DGT) ont été créés précisément pour remédier à ce problème en mettant en place un forum technique informel destiné à faire avancer les initiatives pratiques déjà approuvées, telles que le Portail mondial de coopération et de renforcement des capacités en matière de sécurité des TIC. Cependant, les modalités pratiques de leur mise en place et de leur gestion vont faire l’objet de vives controverses, car elles auront une incidence sur le contenu de l’ordre du jour, sur les acteurs qui le piloteront et sur la capacité de ce nouveau système à produire des résultats concrets à long terme.

Qui dirigera les groupes thématiques spécialisés (DTG) ?

La question qui a dominé la séance et suscité le plus de débats était de savoir qui nommerait les co-animateurs des deux groupes thématiques spécialisés. La Présidente a proposé de nommer deux cofacilitateurs par groupe de travail technique (DTG) : l’un issu d’un pays développé, l’autre d’un pays en développement, s’inspirant ainsi de la pratique de l’Assemblée générale, selon laquelle la Présidente nomme des cofacilitateurs pour les processus intergouvernementaux. Elle a fait part de son intention de mener de larges consultations informelles avant de procéder à ces nominations, et s’est engagée à respecter l’équilibre géographique, la parité entre les sexes lorsque cela est possible, ainsi que l’expertise technique pertinente comme critères de sélection.

Le choix des personnes qui occuperont ces fonctions revêt une importance considérable : les co-animateurs dirigeront les discussions des groupes de travail, influenceront leurs ordres du jour et transmettront les recommandations à la séance plénière.

Une large coalition d’États a soutenu l’approche de la présidence, notamment l’Union européenne, s’exprimant au nom de ses États membres, ainsi que plusieurs pays partageant la même position, tels que la France, l’Allemagne, l’Australie, le Royaume-Uni, les Pays-Bas, la Suisse, le Japon, l’Égypte, le Sénégal, le Nigeria, la Malaisie, la Moldavie et d’autres. L’Égypte et le Sénégal ont été parmi les plus directs, soulignant que tout retard dans la mise en œuvre du mécanisme ferait perdre du temps pendant la période intersessionnelle et éroderait sa crédibilité, en particulier aux yeux des pays en développement désireux de passer de la procédure au fond.

Un autre groupe d’États, mené par la Russie et soutenu par l’Iran, la Chine, la Biélorussie, le Nicaragua et Cuba, a fait valoir que la nomination des cofacilitateurs devait être approuvée par consensus par les États membres plutôt que décidée unilatéralement par la présidence. La Russie a soutenu que les cofacilitateurs des groupes de discussion thématiques (DTG) traitaient de questions politiques de fond et constituaient donc des responsables dont la nomination nécessitait un accord collectif. La Russie a également avancé un argument géographique : la désignation d’un cofacilitateur issu d’un pays développé et d’un autre issu d’un pays en développement par groupe de travail thématique (DTG) continue de favoriser de manière disproportionnée les États développés, qui représentent moins d’un cinquième des membres de l’ONU. L’Iran a ajouté que le projet de texte initial du GTCNL avait explicitement autorisé le président à nommer les facilitateurs des DTG, mais que cette disposition avait été délibérément supprimée au cours des négociations, ce qui témoignait d’un manque d’accord sur la question.

La présidente a confirmé son intention de consulter tous les États membres de manière informelle avant de présenter des candidats et a invité les délégations à faire preuve de souplesse compte tenu de l’urgence de mettre en route les travaux du mécanisme. La Russie a ensuite déclaré comprendre que les candidats seraient désignés à l’issue d’une large consultation, suivie d’une approbation par consensus, mais la présidente n’a ni confirmé ni infirmé cette interprétation.

La question est en fait reportée à la période intersessionnelle, ce qui signifie que la composition des équipes de direction du DTG reste en suspens et nécessitera la poursuite des efforts diplomatiques d’ici juillet.

De quoi les DTG discuteront-ils ?

Un débat étroitement lié portait sur la question de savoir qui décide des thèmes qui seront effectivement abordés par les groupes de travail. Plusieurs délégations occidentales et partageant les mêmes vues (par exemple, l’Allemagne, la France, le Canada, le Royaume-Uni et l’Australie) ont souligné qu’il s’agissait d’une prérogative de la présidence et des cofacilitateurs, à exercer en étroite consultation avec les États. Ces délégations ont proposé de prendre comme points de départ naturels les rançongiciels et la protection des infrastructures critiques, en invoquant leur présence fréquente dans les déclarations nationales et les discussions du GTCNL

L’Iran et la Russie ont souligné que les thèmes devaient être déterminés par consensus entre tous les États membres. L’Argentine a fait valoir que la plénière devait garder le contrôle de l’ordre du jour plutôt que de céder trop de responsabilités aux cofacilitateurs.

Le Maroc a quant à lui préconisé un modèle ascendant dans lequel les DTG définissent dès le départ leurs propres sous-thèmes prioritaires, sur la base des préférences exprimées par les États membres, afin de préserver l’équilibre régional et l’appropriation.

En ce sens, la crédibilité des groupes de travail thématiques repose sur un équilibre délicat : ils doivent être suffisamment ambitieux pour transformer les discussions en actions, mais aussi suffisamment concentrés sur des questions bénéficiant d’un large soutien afin que leurs résultats soient validés en plénière.

Aucune décision n’a été prise. Pour les organisations du secteur privé et de la société civile ayant des priorités thématiques spécifiques, cette possibilité reste d’actualité : les États sont actuellement ouverts aux suggestions concernant les thèmes que les groupes de travail thématiques (DTG) devraient privilégier.

La Colombie a présenté une proposition de procédure qui a suscité des réactions globalement positives de la part des délégations. Elle recommandait que :

- Les mandats des groupes de travail (DTG) doivent être limités dans le temps et comporter des résultats clairement définis et mesurables ;

- le DTG 1 traite de thèmes spécifiques à tour de rôle plutôt que l’ensemble de son mandat simultanément, et

- les résultats des DTG établissent systématiquement une distinction entre les recommandations faisant l’objet d’un consensus et celles qui sont encore en cours d’élaboration.

Le Sénégal a fait une remarque complémentaire : les rapports devraient rendre compte à la fois des points d’accord et des divergences, afin de conserver une trace des discussions même lorsqu’aucun consensus n’a été atteint. Ces deux propositions reflètent une préoccupation plus générale selon laquelle, sans résultats structurés ni calendrier précis, le mécanisme risque de reproduire les délibérations sans fin du GTCNL sans aboutir à des résultats applicables.

Comment les groupes de discussion (DTG) contribueront-ils à la séance plénière ?

Une autre question abordée concernait la manière dont les travaux des groupes de discussion thématiques (DGT) alimentent ceux de la plénière. Le Brésil a clairement indiqué qu’en l’absence d’un protocole défini pour transmettre les rapports des DGT à la plénière et accepter formellement leurs recommandations, ces groupes risquaient de devenir de simples forums de discussion déconnectés des conclusions officielles du mécanisme. La solution qu’il propose, qui doit encore recueillir un soutien, consiste à maintenir le caractère essentiellement informel des discussions au sein des DGT, tout en y incluant une brève partie formelle dédiée à la prise de décision

Participation des parties prenantes

Le rôle des acteurs non gouvernementaux au sein des groupes a constitué un différend de longue date, et sans doute politiquement le plus sensible. La participation effective des parties prenantes concernées reste incertaine.

Certaines délégations ont adopté une position plus conciliante, reconnaissant que les parties prenantes peuvent améliorer la qualité des délibérations (Soudan, Antigua-et-Barbuda) et contribuer à des résultats plus concrets (Vietnam, République dominicaine), tout en soulignant l’importance de préserver le caractère intergouvernemental du processus (Soudan, Vietnam).

Le Canada et les États partageant le même point de vue ont fait valoir que le consensus de juillet 2025 prévoit clairement que les États désignent des experts pour les séances d’information des groupes de travail techniques (DTG) et que l’ensemble de la communauté des parties prenantes participe à l’ensemble des discussions des DTG.

L’Iran a contesté ce point, affirmant que les modalités convenues pour les parties prenantes s’appliquent de la même manière aux groupes de discussion techniques. La Russie a également fait valoir que les exposés d’experts provenant de parties prenantes externes constituent une possibilité plutôt qu’une caractéristique standard, et que l’invitation d’intervenants externes nécessite l’accord des États membres au cas par cas.

La manière dont cette question sera résolue déterminera directement le degré d’accès dont bénéficieront, dans la pratique, le secteur privé, la communauté technique et les organisations de la société civile au processus des groupes de discussion techniques.

Et maintenant ?

La session s’est achevée sans qu’aucune décision n’ait été prise sur ses deux questions les plus importantes : la nomination des cofacilitateurs et l’ordre du jour provisoire de la plénière. Le Président organisera des consultations informelles intersessions sur ces deux points et publiera, avant le mois de juillet, un document de programme de travail dans toutes les langues de l’ONU.

Le Secrétariat ouvrira une période annuelle d’accréditation des parties prenantes dans les semaines à venir ; les parties prenantes souhaitant participer aux sessions plénières et aux conférences d’examen peuvent consulter la page web du Digital Watch Observatory, où nous suivons le processus, pour plus de détails.

La tension générale reste sans solution, et la manière dont elle sera gérée pendant la période intersessionnelle déterminera en grande partie si la session plénière de juillet pourra s’ouvrir avec les fondements opérationnels du mécanisme en place.

Le Président a également confirmé les deux dates clés pour 2026 :

- la session plénière de fond prévue du 20 au 24 juillet, et

- les réunions du DTG prévues du 7 au 11 décembre, toutes deux au Siège de l’ONU à New York

Pour les parties prenantes qui suivent ces discussions ou souhaitent y contribuer, ce sont les dates à retenir pour leur planification.

Impasse à l’OMC : l’expiration du moratoire face à la dynamique plurilatérale

Lors de la 14e Conférence ministérielle de l’Organisation mondiale du commerce (CM14) à Yaoundé, au Cameroun, le commerce numérique a dominé l’ordre du jour à travers deux volets distincts, chacun allant dans une direction différente et illustrant à la fois les limites et l’évolution du système multilatéral.

Le moratoire sur les droits de douane applicables aux transmissions électroniques. Ce moratoire de longue date — renouvelé tous les deux ans depuis 1998 — a expiré le 31 mars, les membres n’étant pas parvenus à un consensus sur la durée d’une nouvelle prolongation, leurs divergences de vues ayant empêché la conclusion d’un accord.

Alors que certains membres, en particulier les États-Unis, recherchaient une solution à plus long terme, d’autres ont traditionnellement plaidé en faveur d’une période de renouvellement plus courte, reflétant un désir de prudence compte tenu du rythme rapide des changements technologiques et de la nécessité de préserver la flexibilité politique pour l’avenir.

Au cours de la 14e session du Conseil des mesures correctives (MC14), le Brésil s’est fait le porte-parole principal de cette initiative, soulignant la nécessité de faire preuve de prudence face à des évolutions telles que l’intelligence artificielle et l’impression 3D, et suggérant qu’une prolongation plus courte, assortie d’une possibilité de réexamen, permettrait aux membres de réévaluer la situation à mesure que le paysage numérique évolue. Les efforts visant à trouver un terrain d’entente ont finalement échoué, faute de temps.

Ce résultat a également eu pour conséquence que les discussions plus larges sur la réforme de l’OMC, qui étaient politiquement liées à l’approbation du moratoire, sont restées en suspens.

Ce n’est pas la première fois que le moratoire arrive à expiration ; cela s’était déjà produit lors de la conférence ministérielle de Seattle en 1999, avant qu’il ne soit rétabli à Doha deux ans plus tard. Son expiration actuelle ne signifie pas que des droits de douane seront automatiquement imposés.

Toutefois, cela crée une marge de manœuvre politique permettant à certains pays d’envisager l’introduction de droits de douane s’ils ne sont pas liés par des accords commerciaux interdisant les droits de douane sur les transmissions électroniques.

Accord plurilatéral sur le commerce électronique. Parallèlement, cependant, une autre dynamique s’est mise en place. Une coalition de 66 membres de l’OMC a annoncé son intention de poursuivre la mise en œuvre de l’Accord sur le commerce électronique conclu en 2024 dans le cadre de l’Initiative de déclaration conjointe sur le commerce électronique (IDC), par le biais de dispositions provisoires.

Rappel : Les initiatives de déclaration conjointe (IDC) de l’OMC permettent à un groupe de membres de l’Organisation mondiale du commerce d’avancer sur des questions spécifiques sans attendre que l’ensemble de l’organisation parvienne à un consensus. Elles sont ouvertes à tout membre de l’OMC.

L’Australie, le Japon et Singapour, en tant que co-organisateurs de la IDC sur le commerce électronique, ont confirmé que le pacte, qui vise à faciliter le commerce numérique et à interdire les droits de douane sur les transactions de commerce électronique, entrera en vigueur dès que 45 membres auront officiellement notifié leur acceptation.

Quelle sera la suite des discussions sur le commerce électronique ? Les discussions sur le moratoire, la réforme de l’OMC et l’avenir du programme de travail sur le commerce électronique (WPEC) devraient se poursuivre lors de la prochaine réunion du Conseil général, qui se tiendra en mai à Genève.

Dans l’intervalle, les membres de l’IDC continueront de plaider en faveur de l’intégration de l’accord dans l’architecture juridique de l’OMC.

Les initiatives conjointes (IDC) et leurs résultats se heurtent à l’opposition d’un certain nombre de membres de l’OMC. Ces pays font valoir que les IDC elles-mêmes n’ont pas de statut juridique, car elles n’ont pas été lancées par consensus. De même, ces pays affirment que les résultats des IDC ne reposent pas sur un consensus et ne constituent ni des accords multilatéraux ni des accords plurilatéraux au sens de l’article IV de l’accord ayant institué l’OMC – l’Accord de Marrakech.

Par exemple, l’Inde a exprimé son désaccord quant à l’intégration dans le corpus réglementaire de l’OMC de l’accord conclu dans le cadre d’une autre négociation plurilatérale, sur la facilitation des investissements au service du développement.Le pays a fait valoir que l’intégration de tels cadres dans le corpus réglementaire de l’OMC risquait de porter atteinte aux principes fondateurs de l’organisation. Il a demandé que des discussions aient lieu sur les garde-fous et les garanties juridiques avant d’intégrer tout résultat plurilatéral spécifique au sein de l’OMC.

Le mois dernier à Genève

Le Séminaire sur les technologies des données 2026, organisé par l’Union européenne de radio-télévision, s’est tenu du 10 au 12 mars à Genève. Cet événement a réuni des professionnels des médias et des experts en technologie afin de discuter de la manière dont l’intelligence artificielle et les systèmes de données sont développés, régis et déployés au sein des médias de service public. Les sessions ont abordé des thèmes tels que la stratégie et la gouvernance en matière d’intelligence artificielle, les plateformes de métadonnées, la recherche hybride, la personnalisation pour l’audience et l’utilisation de l’intelligence artificielle générative dans les processus éditoriaux et de production.

L’Organisation mondiale de la propriété intellectuelle (OMPI) a lancé l’AI Infrastructure Interchange (AIII) le 17 mars à Genève et en ligne. Le programme comprenait des discours d’ouverture, des tables rondes et des exposés consacrés au rôle de la collaboration technique entre les créateurs, les titulaires de droits et les entreprises technologiques. Les participants ont également débattu des objectifs de l’initiative AIII et de la mise en place d’un réseau d’échanges techniques destiné à soutenir un dialogue continu entre experts sur les défis pratiques et les opportunités.

L’Institut universitaire de Genève a organisé un déjeuner-débat le 23 mars afin d’examiner l’évolution des dynamiques transatlantiques à la croisée de la politique américaine et de l’influence mondiale des grandes plateformes technologiques. La discussion a porté sur la manière dont les récents développements politiques aux États-Unis et la concentration du pouvoir technologique influencent la position de l’Europe, notamment en ce qui concerne les questions de dépendance, de réglementation et d’autonomie stratégique.

L’Organisation internationale du travail (OIT) a organisé le 25 mars une session consacrée aux répercussions macroéconomiques de l’IA, au cours de laquelle a été présenté un nouveau modèle du Groupe de la Banque mondiale qui considère l’IA comme une transformation structurelle de la production. Cet outil simule l’impact de l’adoption de l’IA sur les secteurs, les professions et les prix, aidant ainsi les décideurs politiques à évaluer les implications en matière de croissance, d’équité et de changement structurel. Une première étude de cas menée en Pologne explorera son application, avec des perspectives d’utilisation dans d’autres économies émergentes et à revenu intermédiaire.

Les 30 et 31 mars, l’Union internationale des télécommunications (UIT) a organisé à Genève un atelier de deux jours sur le thème «Identités numériques fiables et interopérables pour l’IA humaine et agentique». Cet atelier a réuni des parties prenantes issues des pouvoirs publics, de l’industrie, du monde universitaire et des organismes de normalisation afin d’examiner les approches techniques liées aux cadres de confiance, à la gestion de la confiance, à la sécurité et à l’interopérabilité, et d’étudier des recommandations concrètes ainsi que des conclusions consolidées visant à faire progresser les travaux de normalisation dans ce domaine.L’Union interparlementaire (UIP) a organisé un webinaire intitulé « Renforcer la culture de l’IA au sein des parlements » le mercredi 1er avril 2026, afin d’examiner comment les parlements peuvent mettre en place des formations et des ressources visant à favoriser la culture de l’IA chez les députés, le personnel parlementaire et les équipes informatiques. Ce webinaire mettra en avant les lignes directrices de l’UIP relatives à l’IA dans les parlements, en soulignant que la culture de l’IA doit concerner tous les acteurs au sein des parlements.