Rétrospective de février 2026

La sécurité en ligne des enfants est sous les projecteurs. Le procès de Los Angeles sur l’addiction aux réseaux sociaux et le procès sur la protection des consommateurs à Santa Fe ont débuté, ce qui est une première pour les plateformes de réseaux sociaux qui doivent se défendre devant un tribunal. Parallèlement, de plus en plus de pays envisagent d’interdire l’accès aux réseaux sociaux pour les enfants.

Les points forts de ce mois :

Pourquoi le cyberespace n’existe pas : 30 ans après la Déclaration d’indépendance du cyberespace, nous examinons comment le mythe du cyberespace en tant que monde à part entière façonne aujourd’hui la gouvernance de l’IA.

Anthropic contre le Pentagone : L’entreprise d’IA Anthropic a été exclue des travaux avec le Pentagone après avoir refusé de renoncer à ses garanties éthiques, ce qui a donné lieu à un affrontement majeur entre la Silicon Valley et l’armée.

Souveraineté technologique : de l’autonomie stratégique européenne à la riposte américaine, la souveraineté numérique continue de dominer l’année 2026.

En route vers Genève 2027 : dix étapes clés avant le prochain Sommet mondial sur l’IA, développé par les recherches de DiploAI.

En plus : les principales évolutions des politiques numériques en février et un récapitulatif de l’actualité à Genève.

Coup d’œil : les événements qui ont marqué le mois de février

TECHOLOGIES

Aux Pays-Bas, une cour d’appel néerlandaise a ordonné une enquête approfondie sur Nexperia et a confirmé les décisions prises précédemment de suspendre son ancien PDG, lié à la société mère chinoise Wingtech. La décision de la cour renforce la surveillance de la gouvernance et des activités de l’entreprise, reflétant les préoccupations plus générales de l’Europe concernant la propriété et le contrôle étrangers d’actifs stratégiques sensibles dans le domaine des semi-conducteurs, en particulier pour les secteurs de l’automobile et de la technologie. Nexperia s’est engagée à coopérer pleinement à l’enquête, tandis que Wingtech a critiqué cette décision, la jugeant préjudiciable à l’industrie mondiale.

Taiwan Semiconductor Manufacturing Company (TSMC) a annoncé qu’elle produirait des puces IA avancées de 3 nanomètres dans sa deuxième usine de fabrication à Kumamoto, au Japon. Cette expansion souligne la demande mondiale croissante en processeurs IA et s’aligne sur la stratégie du Japon visant à renforcer les capacités nationales en matière de semi-conducteurs et à diversifier la production critique en dehors des pôles traditionnels.

Le Royaume-Uni et la Bulgarie ont convenu d’approfondir leur coopération dans le domaine des semi-conducteurs. Le Réseau britannique pour la science et la technologie et le ministère britannique des Affaires et du Commerce établissant un lien entre l’expertise britannique en matière de semi-conducteurs composés et la base manufacturière bulgare. Le principal résultat de ce partenariat est l’avancement du projet de construction d’une usine de plaquettes de « carbure de silicium vert » d’une valeur de 350 millions d’euros en Bulgarie, ainsi que de nouveaux partenariats en matière de R&D et d’industrie, notamment un protocole d’accord de recherche entre les universités de Glasgow et de Sofia et un accord de coopération industrielle avec le groupe allemand Wacker Chemie AG.

Un examen de sécurité nationale américain retarde l’octroi des licences permettant à Nvidia d’expédier ses puces IA H200 en Chine, empêchant ainsi les clients chinois de passer ou de confirmer leurs commandes près de deux mois après que la Maison Blanche ait donné son accord de principe. Bien que le département du Commerce ait terminé son évaluation, les consultations interinstitutionnelles, notamment entre les départements d’État, de la Défense et de l’Énergie, sont toujours en cours pour négocier des garanties supplémentaires et des conditions potentielles telles que la répartition des expéditions, les tests et les rapports sur l’utilisation finale. Ces retards perturbent déjà les prévisions de la demande et la planification de la production tout au long de la chaîne d’approvisionnement de Nvidia et poussent les entreprises chinoises à explorer d’autres options. Défense et Énergie, sont toujours en cours de négociation concernant des garanties supplémentaires et des conditions potentielles telles que la répartition des expéditions, les tests et les rapports sur l’utilisation finale. Ces retards perturbent déjà les prévisions de la demande et la planification de la production tout au long de la chaîne d’approvisionnement de Nvidia et poussent les entreprises chinoises à explorer d’autres moyens de s’approvisionner en puces IA.

Découvrez les développements de ce mois-ci en matière de gouvernance de l’IA dans notre section dédiée à la newsletter sur l’IA.

INFRASTRUCTURE

Les ingénieurs procèdent actuellement à la récupération du TAT-8, le premier câble transatlantique à fibre optique, des fonds marins de l’Atlantique, plus de trois décennies après qu’il ait révolutionné les communications mondiales. Bien qu’il ait été mis hors service en 2002 à la suite d’une défaillance irréparable, le câble est resté immergé jusqu’à présent. Cette opération permet de dégager les fonds marins pour y installer de nouvelles infrastructures et de récupérer les composants en fibre de verre, en cuivre et en acier à des fins de recyclage, dans un contexte de pénurie mondiale de métaux.

Starlink, de SpaceX, a obtenu l’autorisation réglementaire d’opérer au Vietnam, élargissant ainsi sa présence mondiale et renforçant son rôle de fournisseur de connectivité alternatif sur des marchés fortement réglementés. Parallèlement, un responsable russe a reconnu que les systèmes Starlink avaient été hors service pendant deux semaines dans certaines régions de Russie.

Une coalition de grandes entreprises technologiques a annoncé la création de la Trusted Tech Alliance (TTA) et présenté cinq principes fondamentaux pour définir ce qui constitue une infrastructure numérique « fiable » : une gouvernance d’entreprise transparente, un développement sécurisé et une évaluation indépendante, une supervision de la chaîne d’approvisionnement, une surveillance de l’écosystème et une responsabilité accrue des entreprises.

CYBERSÉCURITÉ

Le ministère de la Sécurité publique de la République populaire de Chine a rédigé un projet de loi autorisant les autorités à imposer des interdictions de sortie du territoire pouvant aller jusqu’à trois ans aux cybercriminels condamnés et à ceux qui soutiennent ou facilitent de telles activités. Ce projet de loi interdirait également l’entrée sur le territoire aux contrevenants, étendrait la juridiction aux ressortissants chinois à l’étranger, ciblerait les entités étrangères jugées préjudiciables aux intérêts nationaux et renforcerait les contrôles sur les contenus en ligne jugés faux ou perturbateurs. Cette proposition pourrait avoir des répercussions sur les entreprises mondiales, la coopération transfrontalière et la mobilité internationale des professionnels de la technologie.

Les États-Unis et Israël ont lancé des frappes militaires coordonnées contre l’Iran, accompagnées d’opérations cybernétiques menées par l’USCYBERCOM. Ces opérations cybernétiques, associées à des opérations spatiales, ont perturbé les communications iraniennes. La riposte cybernétique de l’Iran s’est jusqu’à présent limitée à des attaques par déni de service distribué, à l’usurpation de signaux GPS près du détroit d’Ormuz et au piratage de caméras IP pour soutenir les opérations de missiles, ainsi qu’à une coupure Internet à l’échelle nationale.

La Commission européenne a lancé ProtectEU, un nouveau programme de lutte contre le terrorisme qui renforce la réponse de l’Union européenne aux menaces en constante évolution, particulièrement celles amplifiées par les outils numériques, en renforçant l’analyse du renseignement et le soutien d’Europol, en resserrant la coopération avec les plateformes afin de supprimer plus rapidement les contenus extrémistes et en renforçant l’application de la loi sur les services numériques, tout en proposant un cadre européen de réponse aux crises en ligne afin de coordonner l’action des entreprises technologiques lors d’incidents de sécurité et en élargissant les mesures visant à protéger les espaces publics, les infrastructures critiques et à perturber le financement du terrorisme, y compris via les crypto-actifs.

Découvrez les dernières évolutions en matière de sécurité des enfants dans notre rubrique qui leur est dédiée.

ÉCONOMIE

La Commission européenne et la Commission de la concurrence et de la consommation du COMESA mènent chacune de leur côté une enquête sur les craintes que Meta abuse de sa position dominante en limitant l’accès des assistants IA tiers à WhatsApp tout en privilégiant sa propre IA Meta. La Commission européenne a déjà officiellement notifié à Meta qu’elle avait enfreint le droit européen de la concurrence et envisage des mesures provisoires pour empêcher la poursuite de cette exclusion et protéger l’entrée de concurrents sur le marché.

La France durcit sa position à l’égard des détaillants en ligne à très bas prix, le ministre Serge Papin ayant déclaré 2026 « année de la résistance » aux plateformes telles que Shein. Le gouvernement fait valoir que les places de marché mondiales bénéficient de normes réglementaires moins strictes que les magasins physiques français. Paris fait appel d’une décision de justice qui a autorisé Shein à poursuivre ses activités malgré des produits inappropriés et prépare une législation permettant aux autorités de suspendre les plateformes en ligne sans autorisation judiciaire préalable, élargissant ainsi les pouvoirs exécutifs sur l’économie numérique.

Le parti AK au pouvoir en Turquie a présenté un projet de loi visant à officialiser la taxation des cryptomonnaies en liant les règles relatives aux actifs numériques à la loi sur les marchés financiers et en exigeant des plateformes agréées qu’elles retiennent une taxe de 10 % sur les gains et les revenus liés aux cryptomonnaies chaque trimestre pour les particuliers et les entreprises, y compris les résidents et les non-résidents. La proposition ajoute également une taxe de transaction de 0,03 % sur les prestataires de services cryptographiques, oblige les investisseurs utilisant des plateformes non agréées à déclarer leurs gains chaque année et permettrait au président d’ajuster le taux de retenue de 0 % à 20 % en fonction de facteurs tels que le type de jeton ou la période de détention. Le nouveau régime fiscal devrait entrer en vigueur deux mois après sa publication si le projet de loi est adopté.

Le ministre sud-coréen des Finances, Koo Yun-cheol, s’est engagé à réformer de toute urgence la manière dont les agences gouvernementales traitent les cryptomonnaies saisies et détenues par l’État après plusieurs défaillances en matière de conservation, notamment un cas dans lequel la police de Séoul aurait perdu l’accès à 22 BTC (environ 1,4 million de dollars) lorsque les clés privées n’ont pas été correctement conservées et qu’un tiers a été autorisé à gérer les actifs. Les procureurs enquêtent également sur des allégations de corruption liées à cet incident, et le ministère des Finances affirme que le gouvernement ne détient des cryptomonnaies que dans le cadre de mesures coercitives légales, telles que des saisies dans des affaires fiscales et pénales.

La banque centrale russe indique qu’elle intensifie sa lutte contre les systèmes pyramidaux basés sur les cryptomonnaies, signalant que deux tiers de ces opérateurs s’appuient désormais sur les cryptomonnaies et que les fonds des victimes ont été transférés vers plus de 4 600 portefeuilles contrôlés par des fraudeurs en 2025. L’autorité de régulation indique avoir identifié 7 087 escroqueries en ligne l’année dernière, bloqué 21 500 pages web et publications sur les réseaux sociaux liées à des escroqueries, et exhorte les Russes à ne recourir qu’à des prestataires d’investissement agréés, alors que les autorités renforcent la surveillance des fraudes en ligne propagées via les réseaux sociaux, les applications de chat et les appels téléphoniques.

DROITS DE L’HOMME

L’UE a abandonné son projet de révision de la définition des « données à caractère personnel » dans le projet de paquet omnibus du RGPD, suite à une forte opposition des régulateurs nationaux et de la société civile, et a choisi de maintenir intact le champ d’application actuel du règlement. L’attention se porte désormais sur les prochaines orientations du Comité européen de la protection des données en matière de pseudonymisation, qui devraient clarifier la manière dont les principales garanties doivent être appliquées dans la pratique, ce qui témoigne d’une préférence générale pour la clarté réglementaire et les orientations de mise en œuvre plutôt que pour la réouverture des concepts fondamentaux de la législation en matière de protection de la vie privée.

Les négociations entre l’Australie et les États-Unis sur l’élargissement du partage des données biométriques ont suscité l’inquiétude des défenseurs de la vie privée et des commentateurs juridiques. Selon certaines informations, ces discussions pourraient élargir l’accès des États-Unis aux données biométriques sensibles australiennes, notamment les images faciales, les empreintes digitales et les données d’identité, en contournant les cadres traditionnels de coopération juridique au cas par cas.

L’autorité italienne de protection de la vie privée a ordonné à Amazon Italia Logistics de cesser le traitement des données sensibles des employés sur son site de Passo Corese et d’arrêter l’utilisation des données collectées par les caméras de surveillance installées près des toilettes et des zones de pause, après avoir découvert que l’entreprise enregistrait des informations telles que l’état de santé des travailleurs, les activités syndicales/de grève et des détails privés sur leur famille, et les conservait pendant une durée pouvant aller jusqu’à 10 ans, ce qui dépasse largement ce que les autorités considèrent comme légal pour la gestion du lieu de travail.

La Commission nigériane de protection des données (NDPC) a ouvert une enquête sur le géant chinois du commerce électronique Temu pour violation présumée de la loi nigériane sur la protection des données. Les autorités enquêtent sur les pratiques de l’entreprise en matière de traitement des données, en particulier sur des allégations de traitement non transparent des données, de mécanismes de surveillance intrusifs, de transferts transfrontaliers et de non-respect éventuel des limites imposées à la collecte de données. Temu s’est engagé à coopérer, les régulateurs avertissant que le non-respect de la réglementation pourrait entraîner des sanctions légales et créer un précédent en matière de gouvernance des données sur le plus grand marché numérique d’Afrique.

Un projet de loi sur la souveraineté cognitive et la protection de l’attention humaine a été présenté à la Chambre des députés argentine. Il propose la mise en place d’un cadre réglementaire reconnaissant l’autonomie cognitive comme un bien protégé par la loi en vertu du droit constitutionnel et du droit international des droits de l’homme, exigeant la transparence, la personnalisation opt-in et des alternatives non algorithmiques sur les plateformes à large audience. Il suggère également d’imposer des paramètres stricts « sécurisés par défaut » pour les mineurs, d’interdire le profilage comportemental et la publicité ciblée pour les utilisateurs de moins de 13 ans, et d’imposer des évaluations d’impact, des obligations d’enregistrement, des audits et des rapports annuels de transparence.

SOCIOCULTUREL

L’UNESCO et l’université Hamad Bin Khalifa (HBKU) ont lancé une chaire UNESCO sur les technologies numériques et le comportement humain au Qatar afin d’étudier l’impact des technologies émergentes sur la vie quotidienne, en mettant l’accent sur le bien-être numérique, la conception éthique et des environnements en ligne plus sains. Le programme abordera des questions telles que la dépendance à Internet, la cyberintimidation et la désinformation, et vise à établir un lien entre la recherche et le dialogue politique entre les gouvernements, les organisations internationales et les universités afin de promouvoir un développement technologique plus responsable.

Le Royaume-Uni introduit une législation obligeant les entreprises technologiques à supprimer les images intimes non consensuelles dans les 48 heures suivant leur signalement. En vertu du projet de loi actualisé sur la criminalité et la police, les entreprises qui ne se conforment pas à cette obligation s’exposent à des amendes pouvant atteindre 10 % de leur chiffre d’affaires mondial ou à des restrictions de service potentielles, dont l’application est supervisée par l’Ofcom.

Le département d’État américain serait en train de préparer le lancement de « freedom.gov », un portail en ligne conçu pour aider les utilisateurs du monde entier, y compris en Europe et ailleurs, à contourner les restrictions locales en matière de contenu et à accéder à des informations bloquées, notamment celles que leurs gouvernements classent comme discours haineux ou propagande terroriste.

L’UE enquête pour déterminer si les éléments de conception de Shein, tels que l’engagement ludique et les algorithmes de recommandation opaques, compromettent la sécurité des consommateurs et les obligations de transparence prévues par le DSA. Les enquêteurs examineront si Shein a manqué à son obligation d’empêcher la vente de produits illégaux, notamment des articles pouvant constituer du matériel pédopornographique. Les systèmes d’atténuation des risques, les processus de retrait des produits et le respect des exigences en matière d’options de recommandation sans profilage de Shein seront évalués, avec des amendes potentielles pouvant atteindre 6 % du chiffre d’affaires mondial en cas de violations confirmées.

La Commission européenne a conclu à titre préliminaire que la conception de TikTok enfreint la loi sur les services numériques (DSA) de l’Union européenne en raison de fonctionnalités que la Commission considère comme addictives, telles que le défilement infini, la lecture automatique, les notifications push et son système de recommandation hautement personnalisé. Selon la Commission, les mesures de protection existantes sur TikTok, telles que la gestion du temps d’écran et les outils de contrôle parental, ne semblent pas suffisantes pour atténuer les risques associés à ces choix de conception. À ce stade, la Commission indique que TikTok devrait modifier la conception fondamentale de son service. Les mesures envisageables comprennent la suppression progressive ou la limitation du défilement infini, l’introduction de pauses plus efficaces dans le temps d’écran, y compris la nuit, et l’ajustement de son système de recommandation afin de réduire les effets addictifs.

DÉVELOPPEMENT

La Malaisie a imposé une interdiction immédiate et totale de toutes les importations de déchets électroniques, reclassant ces derniers dans la catégorie « interdiction absolue » de ses règles d’importation, à la suite d’une enquête approfondie sur la corruption dans la surveillance de ce secteur. Les autorités affirment que cette mesure vise à mettre fin au dumping étranger et à protéger la santé publique et la sécurité nationale, tout en avertissant que les contrôles seront renforcés pour empêcher la contrebande. L’enquête aurait conduit à la détention de hauts responsables environnementaux et au gel de leurs avoirs.

Le Gabon a imposé une suspension indéfinie des plateformes de réseaux sociaux, invoquant la propagation de fausses informations, le cyberharcèlement et la divulgation non autorisée de données personnelles. L’autorité de régulation des médias du Gabon, la Haute Autorité de la communication (HAC), a déclaré que les mesures de modération existantes ne fonctionnaient pas et que la fermeture était nécessaire pour mettre fin aux violations du Code des communications de 2016 du Gabon.

La Commission européenne a proposé d’ouvrir des négociations afin d’intégrer l’Albanie, la Bosnie-Herzégovine, le Kosovo*, le Monténégro, la Macédoine du Nord et la Serbie dans le régime « Roam Like at Home » (Itinérance au prix national) de l’UE. Si cette mesure est mise en œuvre, les citoyens et les entreprises pourront passer des appels, envoyer des SMS et utiliser des données mobiles à l’étranger aux tarifs nationaux, tant lorsqu’ils se rendent dans l’UE que lorsque les citoyens de l’UE voyagent dans la région.La Commission a adopté des propositions de mandats de négociation et sollicite actuellement l’approbation du Conseil européen pour entamer des discussions officielles. Le gouvernement du Cap-Vert a lancé Gov.CV, un portail numérique unifié conçu pour centraliser les services publics et rationaliser les interactions entre l’État, les citoyens et les entreprises. En regroupant les services, le gouvernement espère réduire les délais de traitement, limiter les redondances et offrir une expérience utilisateur plus transparente.

Gouvernance de l’IA en février

GOUVERNANCE MONDIALE

L’ONU. L’Assemblée générale a approuvé la création d’un organe consultatif scientifique mondial historique sur l’IA, le Comité scientifique international indépendant sur l’intelligence artificielle (IA), chargé de fournir des évaluations indépendantes et fondées sur des preuves concernant les technologies, les risques, les opportunités et les impacts de l’IA.

Premier du genre, le groupe d’experts a pour principale mission de « publier des évaluations scientifiques fondées sur des données probantes, synthétisant et analysant les recherches existantes relatives aux opportunités, aux risques et aux impacts de l’IA », sous la forme d’un « rapport de synthèse annuel pertinent sur le plan politique mais non prescriptif » qui sera présenté au Dialogue mondial sur la gouvernance de l’IA. Le groupe d’experts « fera également le point sur ses travaux jusqu’à deux fois par an afin de recueillir les avis dans le cadre d’un dialogue interactif entre l’Assemblée générale en séance plénière et les coprésidents du groupe ». Lors de la réunion inaugurale du groupe d’experts, M. Guterres a déclaré aux experts qu’ils avaient la lourde responsabilité de contribuer à définir la manière dont cette technologie serait utilisée « au profit de l’humanité ».

Sommet sur l’impact de l’IA 2026 à New Delhi. Pour la première fois dans les pays du Sud, l’Inde a accueilli le plus grand sommet mondial sur l’IA à Bharat Mandapam.

Les engagements de New Delhi Frontier AI Impact ont été dévoilés lors de l’ouverture du sommet, axés sur deux priorités fondamentales. La première, qui consiste à faire progresser la compréhension de l’utilisation de l’IA dans le monde réel, vise à générer des données anonymisées et agrégées afin d’éclairer l’élaboration des politiques sur l’impact de l’IA sur l’emploi, les compétences et la productivité. L’objectif est de soutenir une réglementation et une planification économique fondées sur des données probantes à mesure que l’adoption de l’IA s’accélère.

La seconde priorité, qui consiste à renforcer les évaluations multilingues et contextuelles, vise à améliorer les performances de l’IA dans les langues et les contextes culturels sous-représentés. Les organisations participantes collaboreront avec les gouvernements et les écosystèmes locaux pour développer des ensembles de données, des benchmarks et une expertise en matière d’évaluation, en mettant particulièrement l’accent sur les pays du Sud.

Au cœur du sommet, le Premier ministre Narendra Modi a dévoilé la « MANAV Vision », une approche de la gouvernance de l’IA centrée sur l’humain. Présentée comme une série de principes visant à placer l’humain au centre du développement et du déploiement de l’IA, MANAV signifie :

- Moral and ethical systems (systèmes moraux et éthiques) – garantir que l’IA soit guidée par des normes éthiques

- Accountable governance (gouvernance responsable) – règles transparentes et mécanismes de contrôle

- National sovereignty (souveraineté nationale) – droits sur les données et les actifs numériques

- Accessible and inclusive AI (IA accessible et inclusive) – éviter les monopoles et élargir la participation

- Valid and legitimate systems (systèmes valides et légitimes) — technologies légales et vérifiables.

Modi a décrit ce cadre comme essentiel pour prévenir de futures disparités dans l’impact de l’IA et garantir que la technologie serve le bien-être de l’humanité. Il a également souligné que l’IA devrait être un moyen d’inclusion et d’autonomisation, en particulier pour les pays du Sud, plutôt qu’un outil qui concentre le pouvoir entre les mains de quelques acteurs.

L’édition 2027 du sommet sera accueillie par la Suisse. Pour en savoir plus sur la route vers le sommet de 2027, veuillez consulter notre newsletter dédiée.

INVESTISSEMENTS ET PROGRAMMES NATIONAUX

Etats-Unis. Sept géants technologiques (Google, Meta, Microsoft, Oracle, OpenAI, Amazon et xAI) ont signé l’engagement de la Maison Blanche en faveur de la protection des contribuables, encourageant les grandes entreprises technologiques à couvrir les coûts supplémentaires d’électricité liés à leur infrastructure d’IA et, dans certains cas, à investir dans la production d’énergie dédiée plutôt que de dépendre uniquement du réseau public.

Allemagne. L’Allemagne a présenté son projet de « Sovereign AI Factory », une initiative soutenue par le gouvernement visant à développer des modèles et des infrastructures d’IA souverains adaptés à la langue, au contexte culturel et aux besoins industriels locaux. Ce projet soutiendra l’innovation nationale en fournissant des ressources informatiques, des ensembles de données et des cadres de certification conformes aux normes européennes en matière de sécurité et de confidentialité, dans le but de réduire la dépendance vis-à-vis des fournisseurs d’IA non européens. Berlin indique que cette usine servira également de plateforme collaborative permettant aux instituts de recherche et à l’industrie de concevoir conjointement des systèmes d’IA sécurisés et interopérables pour les secteurs public et privé.

Pakistan. Le gouvernement pakistanais s’est engagé à réaliser d’importants investissements dans l’IA d’ici 2030, en déployant une stratégie nationale globale visant à accélérer la transformation numérique dans l’ensemble de l’économie. Ce plan vise à renforcer les capacités en matière d’IA dans des secteurs clés, notamment l’agriculture, la santé et l’éducation, grâce au financement de pôles de recherche, de partenariats public-privé et de programmes de perfectionnement ciblés. Selon les responsables, cet investissement a pour objectif d’attirer les investissements directs étrangers, de stimuler les exportations et de positionner le Pakistan comme un acteur technologique régional, tout en abordant les questions éthiques et les cadres de gouvernance afin d’orienter un déploiement responsable de l’IA.

Slovénie. La Slovénie a défini une vision nationale ambitieuse en matière d’IA, soulignant des priorités stratégiques telles qu’une IA centrée sur l’humain, des cadres éthiques solides et des investissements dans la recherche et les talents. La feuille de route met l’accent sur la collaboration avec les partenaires européens et le respect des normes internationales, positionnant la Slovénie comme un acteur proactif dans les discussions sur la gouvernance de l’IA.

PARTENARIATS

Corée du Sud et Singapour. La Corée du Sud et Singapour ont lancé une alliance Corée-Singapour pour l’IA, une initiative bilatérale visant à approfondir la coopération dans le domaine de l’IA et des technologies connexes. Annoncée lors du sommet Corée-Singapour AI Connect à Singapour, cette alliance vise à créer un écosystème d’innovation ouvert qui relie les capitaux, les talents et les technologies entre les deux nations, dans le but de renforcer la compétitivité sur le marché mondial de l’IA et de soutenir le développement conjoint de solutions d’IA qui répondent aux défis régionaux et mondiaux. Ce partenariat comprend l’engagement de créer d’ici 2030 un fonds d’investissement mondial de 300 millions de dollars américains à Singapour pour soutenir les start-ups et la recherche collaborative.

GOUVERNANCE DES CONTENUS

Chine. Un tribunal de l’est de la Chine a établi un précédent juridique en limitant la responsabilité des développeurs en cas d’hallucinations de l’IA, jugeant que les développeurs ne sont pas automatiquement responsables à moins que les utilisateurs ne puissent prouver une faute et un préjudice démontrable. Les juges ont qualifié les services d’IA de prestataires de services, exigeant des plaignants qu’ils démontrent à la fois la faute du prestataire et le préjudice réel causé par des résultats erronés, un cadre destiné à équilibrer les incitations à l’innovation et la protection des utilisateurs.

Les autorités chargées de la protection des données. Les autorités chargées de la protection des données de 61 juridictions et le Contrôleur européen de la protection des données (CEPD) ont publié une déclaration commune mettant en garde contre les outils d’IA qui génèrent des images réalistes de personnes identifiables sans leur consentement. Ils ont exprimé leurs préoccupations concernant la vie privée, la dignité et la sécurité des enfants, soulignant que ces technologies, souvent intégrées aux réseaux sociaux, permettent la diffusion d’images intimes non consenties et d’autres contenus préjudiciables. Les autorités ont souligné que les systèmes d’IA doivent se conformer aux lois sur la protection des données et que certaines utilisations peuvent constituer des infractions pénales. Les organisations ont été invitées à mettre en place des mesures de protection, à garantir la transparence, à permettre la suppression rapide des contenus et à collaborer de manière proactive avec les régulateurs afin de protéger les droits fondamentaux.

Inde. L’Inde a commencé à appliquer une règle de suppression dans les trois heures pour les contenus deepfake générés par l’IA, exigeant des plateformes et des intermédiaires qu’ils retirent les contenus spécifiés dans les 180 minutes suivant la notification, sous peine de sanctions réglementaires. Ce délai accéléré vise à freiner la propagation rapide de médias synthétiques trompeurs, dans un contexte de préoccupations accrues concernant la désinformation et les perturbations sociales.

Coalition mondiale pour la sécurité des enfants. Une large coalition de défenseurs des droits de l’enfant, d’organisations de sécurité numérique et de décideurs politiques a exhorté les gouvernements à interdire les outils d’IA de « nudification », demandant instamment la criminalisation des logiciels qui transforment des images de personnes habillées en versions sexuellement explicites sans leur consentement. Le groupe soutient que les approches existantes en matière de modération des contenus sont insuffisantes pour protéger les mineurs et souligne que des interdictions légales préventives sont nécessaires pour empêcher une exploitation généralisée.

UNICEF. Le Fonds des Nations Unies pour l’enfance (UNICEF) a exhorté les gouvernements à criminaliser la création, la possession et la distribution de contenus générés par l’IA représentant des abus sexuels sur des enfants, mettant en garde contre une forte augmentation des deepfakes sexuellement explicites impliquant des enfants et demandant instamment le renforcement des pratiques de sécurité dès la conception et une modération rigoureuse des contenus. Une étude citée par l’agence a révélé qu’au moins 1,2 million d’enfants dans 11 pays ont signalé que leurs images avaient été manipulées pour créer des deepfakes explicites à l’aide de l’IA, les outils de « nudification » qui déshabillent ou modifient les vêtements présentant des risques accrus. L’UNICEF a souligné que les deepfakes à caractère sexuel impliquant des mineurs devraient être traités comme du matériel pédopornographique au sens de la loi et a exhorté les plateformes numériques à empêcher leur diffusion plutôt que de se contenter de supprimer les contenus après coup.

Espagne. En Espagne, le Premier ministre Pedro Sánchez a ordonné aux procureurs d’enquêter sur X, Meta et TikTok pour la diffusion présumée de contenus pédopornographiques générés par l’IA (CSAM). L’enquête fait suite à des informations selon lesquelles les systèmes des plateformes auraient permis la création et la diffusion d’images deepfake à caractère sexuel impliquant des mineurs. Les autorités espagnoles examinent si les entreprises ont manqué à leur obligation d’empêcher la diffusion de tels contenus et si les outils d’IA intégrés ou liés aux plateformes ont contribué à ces préjudices.

Royaume-Uni. Le Royaume-Uni s’associe à Microsoft, à des universitaires et à des experts en technologie afin de développer un système de détection des deepfakes pour lutter contre les contenus préjudiciables générés par l’IA. Le cadre mis en place par le gouvernement permettra de normaliser la manière dont les outils de détection sont évalués par rapport aux menaces réelles telles que l’usurpation d’identité et l’exploitation sexuelle, en s’appuyant sur la législation récente qui criminalise la création d’images synthétiques intimes non consensuelles. Les responsables ont invoqué l’augmentation spectaculaire du nombre de deepfakes partagés en ligne ces dernières années pour justifier cette initiative.

Grok/X. La brigade chargée de la cybercriminalité du parquet de Paris a procédé à une perquisition dans les locaux français de X dans le cadre de cette enquête élargie. M. Musk et l’ancienne PDG Linda Yaccarino ont été convoqués pour des entretiens volontaires. X a nié toute malversation et a qualifié cette perquisition d’« acte abusif de la part des forces de l’ordre », tandis que M. Musk l’a décrite comme une « attaque politique ».

Le Bureau du commissaire à l’information du Royaume-Uni (ICO) a ouvert une enquête officielle sur X et xAI afin de déterminer si le traitement des données personnelles par Grok est conforme à la législation britannique en matière de protection des données, notamment aux principes fondamentaux de protection des données (légalité, équité et transparence), et si sa conception et son déploiement comprennent des protections intégrées suffisantes pour empêcher l’utilisation abusive des données personnelles à des fins de création d’images préjudiciables ou manipulées.

La Commission irlandaise de protection des données (DPC) a lancé une enquête à grande échelle au titre du RGPD sur le chatbot IA Grok de X, à la suite d’informations selon lesquelles ses capacités d’IA générative auraient été utilisées pour produire des contenus préjudiciables, non consensuels et à caractère sexuel impliquant des données à caractère personnel. Cette enquête, déclenchée par une controverse généralisée sur les images produites par Grok, se déroule parallèlement à la découverte de preuves indiquant que le chatbot a gagné des parts de marché aux États-Unis, alors que les régulateurs mondiaux examinent sa conformité aux normes fondamentales en matière de protection des données.

L’Agence nationale brésilienne de protection des données et le Bureau national des droits des consommateurs ont ordonné à X de cesser de fournir des images explicites via son IA Grok, invoquant les risques que des contenus préjudiciables atteignent des mineurs et la violation des normes locales en matière de sécurité numérique. La directive exige des mesures techniques immédiates pour bloquer certaines invites et certains contenus dans le cadre d’un examen continu des pratiques de modération du contenu de la plateforme.

Par ailleurs, l’Indonésie a rétabli l’accès à Grok après l’avoir interdit en janvier, ayant reçu de X l’assurance que des mesures de protection plus strictes seraient mises en place pour empêcher toute nouvelle utilisation abusive de l’outil d’IA.

Chili. Le Chili a lancé Latam-GPT afin de renforcer la présence de l’Amérique latine dans le domaine mondial de l’intelligence artificielle. Ce projet, développé par le Centre national pour l’intelligence artificielle avec le soutien de toute l’Amérique du Sud, vise à corriger les préjugés de longue date en formant les systèmes à partir des données propres à la région plutôt que de celles provenant principalement des États-Unis ou d’Europe. Le président Gabriel Boric a déclaré que ce modèle contribuera à préserver l’identité culturelle et permettra à la région de jouer un rôle plus actif dans le développement technologique. Latam-GPT n’est pas conçu comme un outil conversationnel, mais plutôt comme un vaste ensemble de données qui servira de base à de futures applications. Plus de huit téraoctets d’informations ont été collectés, principalement en espagnol et en portugais, et il est prévu d’ajouter des langues indigènes à mesure que le projet se développera.

SÛRETÉ ET SÉCURITÉ

Experts internationaux. Le deuxième rapport international sur la sécurité de l’IA 2026 a été publié. Ce rapport synthétise les données disponibles sur les capacités de l’IA, telles que l’amélioration du raisonnement et de la performance des tâches, ainsi que les risques émergents tels que les deepfakes, les cyber abus et la dépendance émotionnelle vis-à-vis des compagnons IA, tout en soulignant le manque de fiabilité et les défis persistants en matière de gestion des risques. Il vise à fournir aux décideurs politiques une base scientifique pour leurs décisions en matière de réglementation et de gouvernance, sans pour autant prescrire de politiques spécifiques.

L’ONU. La gouvernance de l’IA a été au cœur des discussions lors du récent dialogue spécial des Nations unies intitulé « Des principes à la pratique : dialogue spécial sur l’intelligence artificielle et la prévention et la lutte contre l’extrémisme violent ». Des diplomates et des experts ont discuté de la manière dont l’IA remodèle la stabilité mondiale, la dynamique des conflits et le droit international. Les participants ont souligné les risques liés aux systèmes autonomes et aux campagnes de désinformation, et ont insisté sur la nécessité d’une coopération multilatérale et de normes communes pour atténuer les menaces émergentes.

L’Europe. La Commission européenne a confirmé qu’elle reporterait à nouveau la publication des lignes directrices relatives aux systèmes d’IA à haut risque dans le cadre de la loi européenne sur l’IA. Ces lignes directrices devaient être publiées avant le 2 février 2026, mais elles suivront désormais un calendrier révisé. Ce report marque le deuxième délai non respecté et s’ajoute aux retards plus généraux pris dans la mise en œuvre de la loi européenne sur l’IA.

DROITS DE PROPRIÉTÉ INTELLECTUELLE

Le Royaume-Uni. La Cour suprême britannique a statué que les inventions assistées par l’IA peuvent être brevetées lorsque le rôle inventif de l’humain est identifiable et substantiel. Selon les experts juridiques, cette décision favorisera l’innovation en clarifiant la protection de la propriété intellectuelle dans le domaine du développement hybride humain-IA. Le jugement vise à encourager les investissements dans la recherche sur l’IA tout en maintenant les normes de brevetabilité établies.

L’AVENIR DU TRAVAIL

Corée du Sud. La Corée du Sud a mis en place un organisme gouvernemental chargé de traiter les pressions exercées par l’automatisation liée à l’intelligence artificielle sur la main-d’œuvre, créant ainsi un conseil intersectoriel chargé de prévoir les tendances en matière de suppression d’emplois et de recommander des mesures politiques. Cette initiative rassemble des syndicats, des dirigeants industriels et des ministères afin de coordonner les programmes de reconversion et de perfectionnement professionnels, de renforcer les dispositifs de protection sociale et d’étudier des modèles de soutien au revenu pour les travailleurs touchés par l’automatisation.

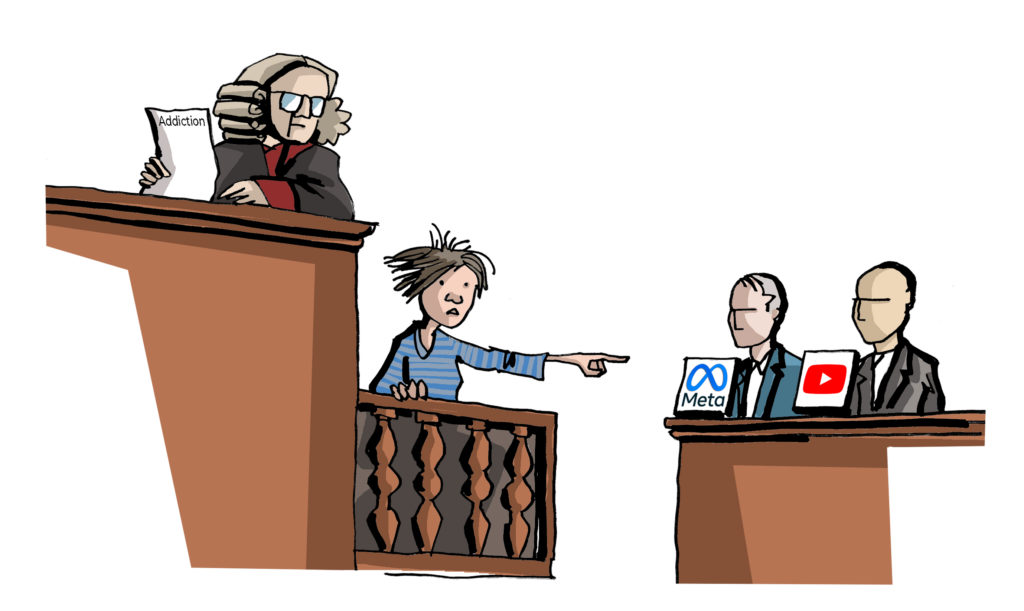

Des procès phares débutent alors que de plus en plus de pays envisagent d’interdire l’accès aux réseaux sociaux aux enfants

Les procès commencent

Le procès de Los Angeles sur l’addiction aux réseaux sociaux. Un procès historique s’est ouvert à Los Angeles, aux États-Unis, en février 2026 contre Meta et YouTube, centré sur des allégations selon lesquelles leurs plateformes sont délibérément conçues pour créer une dépendance et ont nui à la santé mentale des jeunes utilisateurs.

La plaignante, Kaley, âgée de 20 ans en 2026, affirme qu’Instagram et YouTube lui ont causé de l’anxiété, une dysmorphie corporelle et des pensées suicidaires.

Ses avocats ont comparé les fonctionnalités telles que le défilement infini, la lecture automatique, les likes et les filtres beauté à un « casino numérique » pour enfants, citant des documents internes montrant que les plateformes ciblaient les jeunes utilisateurs et utilisaient même YouTube comme une « baby-sitter numérique ». Kaley avait initialement également poursuivi Snap Inc. et TikTok, mais ces plateformes ont conclu des accords confidentiels avant le procès, laissant Meta et YouTube comme seuls défendeurs à comparaître devant un jury.

La défense de Meta et YouTube a fait valoir que les réseaux sociaux n’étaient pas responsables des difficultés de Kaley, citant son milieu familial difficile, les dossiers des thérapeutes et la disponibilité d’outils de sécurité.

YouTube a souligné que l’utilisation quotidienne moyenne de Kaley était de 29 minutes depuis 2020 et a comparé la plateforme à d’autres services de divertissement, soulignant qu’elle n’était pas dépendante.

Le PDG de Meta, Mark Zuckerberg, a témoigné et a insisté sur le fait qu’Instagram interdit les utilisateurs de moins de 13 ans et qu’il est difficile de faire respecter les limites d’âge, car de nombreux mineurs mentent sur leur date de naissance. Il a souligné les efforts continus visant à réduire le temps passé devant les écrans et à améliorer les fonctionnalités de sécurité. Néanmoins, des documents internes présentés au tribunal suggèrent que l’engagement des jeunes adolescents était une priorité stratégique. Cette affaire est suivie de près, car elle pourrait servir de modèle pour la responsabilité des plateformes en matière de fonctionnalités addictives.

La psychiatre de la plaignante, Virginia Burke, a également témoigné. Mme Burke a déclaré que l’utilisation des réseaux sociaux par la plaignante Kaley avait contribué à ses problèmes de santé mentale, citant notamment le harcèlement en ligne. Cependant, Mme Burke a noté que Kaley aimait également créer et partager des vidéos artistiques, même si elle était frustrée lorsque d’autres s’en attribuaient le mérite. Mme Burke a déclaré que la dépendance aux réseaux sociaux n’était pas encore un diagnostic largement reconnu en psychiatrie et qu’elle ne figurait pas dans le dernier Manuel diagnostique et statistique, le texte de référence pour les professionnels de la santé mentale aux États-Unis.

Kaley elle-même a témoigné que dès son plus jeune âge, elle passait presque tout son temps sur des plateformes telles que YouTube et Instagram, décrivant son incapacité à limiter son utilisation, même lorsqu’elle était victime de harcèlement. Elle a déclaré qu’elle récupérait secrètement son téléphone la nuit après que sa mère le lui ait confisqué, qu’elle était bouleversée lorsqu’on lui refusait l’accès aux applications de réseaux sociaux, qu’elle se retirait des interactions familiales et qu’elle pensait que sa santé, son sommeil, ses notes et son bien-être général auraient été meilleurs sans les réseaux sociaux.

Le procès devrait durer jusqu’à la fin mars 2026.

Le procès pour la protection des consommateurs à Santa Fe. Un autre procès s’est ouvert à Santa Fe, au Nouveau-Mexique, aux États-Unis, après plus de deux ans de débats préliminaires. Le procès, intenté en 2023 par le procureur général du Nouveau-Mexique, Raúl Torrez, a été porté devant les tribunaux et un jury.

La plainte accuse Meta d’avoir enfreint les lois de l’État sur la protection des consommateurs en présentant de manière trompeuse la sécurité de ses plateformes pour les mineurs, tout en développant des fonctionnalités et des algorithmes qui, selon les procureurs, incitent à une utilisation prolongée et exposent les enfants à des risques importants. Ces risques comprennent une dépendance, l’exposition à des contenus sexuels préjudiciables, des communications privées non désirées avec des adultes, des troubles du sommeil dus à une utilisation compulsive et des environnements où les prédateurs peuvent agir relativement facilement.

Le 3 mars, les procureurs de l’État ont présenté les dépositions enregistrées du PDG de Meta, Mark Zuckerberg, et du directeur d’Instagram, Adam Mosseri, cherchant à démontrer que l’entreprise était consciente des mesures et des recherches indiquant de graves problèmes de sécurité pour les enfants, mais qu’elle n’avait pas suffisamment agi ni averti les utilisateurs et les familles. Dans ces dépositions, les procureurs ont interrogé les dirigeants de Meta sur des questions telles que les priorités en matière de sécurité par rapport aux profits de l’entreprise, la portée de leurs plateformes auprès des adolescents et les choix spécifiques de produits — des systèmes de recommandation aux filtres cosmétiques — susceptibles d’affecter le bien-être des adolescents.

Les avocats de Meta ont déclaré au jury lors de leurs déclarations liminaires que l’entreprise avait mis en place de nombreux outils de sécurité et systèmes de modération des contenus. Meta soutient qu’elle n’a pas commis de tromperie et qu’elle a toujours divulgué les risques et pris des mesures de sécurité.

Le procès des districts scolaires d’Oakland. Un autre procès phare devrait débuter en juin à Oakland, en Californie. Il s’agit du premier procès intenté par des districts scolaires contre des plateformes de réseaux sociaux pour préjudice causé à des enfants.

Le fond du problème. Environ 1 600 plaignants, dont des particuliers, plus de 350 familles, 250 districts scolaires et des procureurs généraux d’État, ont intenté des poursuites contre Meta Platforms, Snap Inc., TikTok et Google. En raison de leur nombre, ces poursuites sont coordonnées dans le cadre d’une procédure de coordination du Conseil judiciaire (JCCP). Au sein de ce groupe coordonné, 22 procès phares ont été sélectionnés, dont trois — à Los Angeles, Santa Fe et Oakland — devraient être jugés en premier.

Un procès phare est un procès test choisi parmi un grand nombre de procès similaires pour être jugé en premier, afin d’évaluer la réaction des jurys face aux preuves et aux arguments juridiques. Son verdict ne tranche pas les autres affaires, mais il donne une indication sur la manière dont les futurs procès ou négociations de règlement pourraient se dérouler.

C’est pourquoi les procès de Los Angeles et de Santa Fe ont suscité beaucoup d’attention : leur verdict devrait influencer les futures pratiques en matière de conception des plateformes.

Le nombre de pays interdisant l’accès aux réseaux sociaux aux mineurs augmente

La tendance visant à interdire aux enfants l’accès aux réseaux sociaux se poursuit, dix autres pays envisageant des mesures législatives et des outils de mise en application.

Le parlement portugais a approuvé une loi restreignant l’accès aux réseaux sociaux pour les mineurs de moins de 16 ans, exigeant le consentement explicite et vérifié des parents pour accéder à des plateformes telles qu’Instagram, TikTok et Facebook. L’accès sera contrôlé par le biais de la clé mobile numérique, le système national d’identification numérique du Portugal, garantissant une vérification efficace de l’âge et la conformité des plateformes. Cette loi renforce les protections face aux préoccupations croissantes concernant l’impact des réseaux sociaux sur la santé mentale des jeunes. Les règles détaillées de mise en œuvre et d’application sont désormais soumises à l’examen de la commission parlementaire.

En Espagne, le gouvernement du Premier ministre Pedro Sánchez a proposé une législation qui interdirait l’accès aux réseaux sociaux aux utilisateurs de moins de 16 ans, présentant cette mesure comme un outil nécessaire à la protection des enfants contre la dépendance, l’exploitation et les contenus préjudiciables. Selon le projet de plan, les plateformes doivent mettre en place des systèmes obligatoires de vérification de l’âge conçus comme des barrières applicables plutôt que comme des mesures de protection symboliques, ce qui marque un changement vers une application plus stricte de la réglementation plutôt que vers une conformité volontaire de la part des entreprises technologiques. Les propositions incluent également la responsabilité juridique des dirigeants du secteur technologique en cas de contenu illégal ou haineux restant en ligne.

Le parti AK au pouvoir en Turquie a proposé un projet de loi interdisant l’accès aux réseaux sociaux aux enfants de moins de 15 ans, obligeant les plateformes à mettre en place une vérification de l’âge. Les plateformes devront également créer une version distincte de la plateforme spécialement destinée aux mineurs âgés de 15 à 18 ans. Les responsables ont invoqué le code pénal turc, qui limite la responsabilité pénale des enfants de moins de 15 ans, pour justifier la limite d’âge fixée à 15 ans.

La coalition au pouvoir en Pologne est actuellement en train d’élaborer une loi qui interdirait l’utilisation des réseaux sociaux aux enfants de moins de 15 ans. Les législateurs souhaitent finaliser la loi d’ici la fin février 2026 et la mettre en œuvre potentiellement d’ici Noël 2027. La Pologne souhaite mettre à jour son application d’identité numérique, mObywatel, afin de permettre aux utilisateurs de vérifier leur âge.

La Slovénie prépare actuellement un projet de loi visant à interdire aux mineurs de moins de 15 ans d’accéder aux réseaux sociaux, une initiative lancée par le ministère de l’Éducation.

La Grèce serait sur le point d’annoncer une interdiction d’utilisation des réseaux sociaux pour les enfants de moins de 15 ans. Le ministère de la Gouvernance numérique a l’intention de s’appuyer sur l’application Kids Wallet, lancée l’année dernière, comme mécanisme de mise en œuvre de la mesure, plutôt que de développer un nouveau cadre de contrôle.

En Autriche, le gouvernement débat activement d’une interdiction d’utilisation des réseaux sociaux pour les enfants de moins de 14 ans. Le secrétaire d’État aux Affaires numériques, Alexander Pröll, a confirmé que cette politique était en cours de discussion dans le but de la mettre en œuvre d’ici la rentrée scolaire de septembre 2026.

L’Allemagne envisage de limiter l’accès des enfants aux réseaux sociaux, le parti au pouvoir exhortant le gouvernement fédéral à introduire un âge minimum légal de 14 ans. Le chancelier Friedrich Merz a signalé son soutien à cette proposition, se déclarant très favorable à cette idée.

Le Royaume-Uni a lancé une consultation publique afin de déterminer si les enfants de moins de 16 ans devraient faire l’objet de restrictions ou d’une éventuelle interdiction d’utiliser les réseaux sociaux. Les jeunes, les parents et les éducateurs sont invités à partager leurs points de vue avant que les ministres ne se prononcent sur la politique future. Les mesures envisagées pourraient inclure la fixation d’un âge minimum pour l’utilisation des réseaux sociaux, la restriction des fonctionnalités préjudiciables telles que le défilement infini et l’examen des protections contre l’envoi ou la réception d’images explicites par les enfants. La consultation explorera également les restrictions à l’utilisation des chatbots IA par les enfants et les limites à l’utilisation des VPN lorsqu’ils compromettent les mesures de sécurité. Le gouvernement a l’intention d’agir rapidement sur la base de ses conclusions dans les mois à venir en introduisant des pouvoirs juridiques ciblés qui pourront être mis en œuvre rapidement à mesure que la technologie évolue.

L’UE dans son ensemble réexamine l’idée d’une restriction d’âge pour les réseaux sociaux à l’échelle européenne. La question a été soulevée dans le nouveau plan d’action de la Commission européenne contre le cyberharcèlement, publié le mardi 10 février. Ce plan confirme qu’un groupe d’experts en protection de l’enfance conseillera la Commission d’ici l’été sur d’éventuelles restrictions d’âge à l’échelle de l’UE pour l’utilisation des réseaux sociaux. Le groupe évaluera les options pour une approche européenne coordonnée, y compris une éventuelle législation et des mesures de sensibilisation des parents.

Le document note que des règles nationales divergentes pourraient conduire à une protection inégale des enfants dans l’ensemble de l’Union. Selon la Commission, un cadre européen harmonisé contribuerait à garantir des garanties cohérentes et à réduire la fragmentation dans la manière dont les plateformes appliquent les restrictions d’âge.

Ces efforts nationaux individuels s’inscrivent dans un contexte de coordination réglementaire internationale croissante. Le 3 février 2026, la Commission européenne s’est réunie avec le commissaire australien à la sécurité électronique et l’Ofcom britannique afin de partager leurs points de vue sur les mesures de vérification de l’âge, c’est-à-dire les approches techniques et politiques permettant de vérifier l’âge des utilisateurs et d’appliquer des restrictions en ligne adaptées à leur âge.

Cette réunion faisait suite à une communication conjointe signée à la fin de 2025, dans laquelle les trois régulateurs s’engageaient à poursuivre leur collaboration afin de renforcer la sécurité en ligne des enfants, notamment en explorant les technologies efficaces de vérification de l’âge, les stratégies d’application et le rôle des données et de la recherche indépendante dans l’action réglementaire.

Vue d’ensemble. Le nombre de membres du club des interdictions a atteint les deux chiffres. Nous continuerons à suivre l’évolution de la situation.

Zooming arrière. Ces initiatives menées dans plusieurs pays confirment que l’interdiction des réseaux sociaux en Australie n’était pas une expérience politique isolée, mais plutôt le début d’un effet d’entraînement mondial. Cette dynamique est particulièrement frappante étant donné que l’interdiction australienne n’est pas encore largement considérée comme un succès : son efficacité et ses répercussions plus larges font encore l’objet d’études et de débats.

Ces développements interviennent alors que le rapport eSafety australien souligne que les géants de la technologie, notamment Apple, Google, Meta, Microsoft, Discord, Snap, Skype et WhatsApp, n’ont réalisé que des progrès limités dans la lutte contre l’exploitation et les abus sexuels des enfants en ligne (CSEA), bien qu’ils soient légalement tenus de rendre compte des mesures prises en vertu de la loi australienne sur la sécurité en ligne.

Des interdictions à la conformité

Au-delà des interdictions pures et simples, un deuxième front réglementaire se dessine : le renforcement des conditions juridiques et techniques dans lesquelles les plateformes traitent les données des mineurs et hébergent des contenus susceptibles de nuire aux enfants.

Parallèlement, les mesures coercitives prises au Royaume-Uni soulignent les risques financiers et les atteintes à la réputation liés au non-respect de la réglementation. L’autorité britannique de protection de la vie privée a infligé une amende de 20 millions de livres sterling à Reddit pour avoir traité illégalement les données personnelles d’enfants et ne pas avoir protégé les utilisateurs de moins de 13 ans. L’autorité de régulation a estimé que Reddit ne disposait pas de « mécanismes fiables de vérification de l’âge » et s’appuyait sur une auto-déclaration facilement contournable, ce qui signifie qu’il n’avait aucune base légale pour traiter les données des enfants et les exposait à des contenus potentiellement préjudiciables. Reddit n’a pas non plus réalisé l’évaluation d’impact sur la protection des données requise avant 2025. Cette amende est la plus importante infligée par l’ICO en matière de protection de la vie privée des enfants. Reddit prévoit de faire appel.

L’autorité chargée de la protection des données en Turquie a ouvert une nouvelle enquête sur la manière dont les principales plateformes de réseaux sociaux gèrent les données personnelles des enfants. L’Autorité de protection des données personnelles examine actuellement la manière dont les données personnelles des enfants sont traitées sur TikTok, Instagram, Facebook, YouTube, X et Discord, ainsi que les mesures de protection mises en place. Par ailleurs, le Parti de la justice et du développement (AKP), au pouvoir, devrait introduire un dispositif familial qui exigerait la vérification de l’identité de chaque compte par le biais de numéros de téléphone ou du système e-Devlet. Les enfants de moins de 15 ans ne seraient pas autorisés à créer de profil, et d’autres restrictions pourraient s’appliquer aux utilisateurs de moins de 18 ans.

Au Brésil, une nouvelle proposition législative (projet de loi n° 730/2026) a été présentée à la Chambre des députés. Cette proposition impose des mécanismes de vérification de l’âge conformes à la loi brésilienne sur la protection des données (loi n° 13.709/2018), qui donne la priorité à la minimisation des données, à la pseudonymisation et à la conservation limitée. Elle interdit également la monétisation directe ou indirecte impliquant des enfants de moins de 14 ans et exige une autorisation judiciaire préalable pour les travaux artistiques rémunérés des adolescents âgés de 14 à 18 ans, sous réserve de garanties. S’il est adopté, le projet de loi officialiserait les exigences de conformité de base pour les plateformes opérant sur le marché brésilien.

Les mesures provisoires chinoises qui classifient et réglementent les informations en ligne susceptibles de nuire à la santé physique et mentale des mineurs sont entrées en vigueur le 1er mars. Les contenus concernés comprennent les contenus incitant à des comportements dangereux, à des émotions extrêmes, à la discrimination, à des modes de vie malsains, à une consommation irrationnelle, au culte des célébrités ou à des valeurs déformées telles que l’hédonisme et la pseudoscience. Les règles limitent également l’utilisation abusive des images et des données personnelles des mineurs. Les fournisseurs de systèmes de recommandation algorithmiques et de services d’IA générative sont tenus de renforcer et d’affiner leurs cadres de gouvernance en matière de sécurité et leurs mesures de protection techniques, et il leur est interdit de promouvoir ou de diffuser des contenus en ligne susceptibles d’avoir un impact négatif sur le bien-être physique ou psychologique des mineurs.

Pourquoi le cyberespace n’existe pas

Il y a trente ans, le 8 février 1996, deux événements ont donné lieu à un discours influent sur Internet, affirmant qu’il occupait un domaine distinct du droit et de la politique ordinaires. Il s’agit de la Déclaration d’indépendance du cyberespace et de la loi américaine sur la décence dans les communications (Communications Decency Act, CDA).

Déclaration d’indépendance du cyberespace. À Davos, la Déclaration d’indépendance du cyberespace de John Perry Barlow affirmait que les « gouvernements du monde industriel » n’avaient « aucune souveraineté » dans le cyberespace.

Cette vision a donné naissance à une génération de penseurs qui affirmaient qu’Internet signifiait « la fin de la géographie ». Des milliers d’articles, de livres, de thèses et de discours ont été publiés pour soutenir que nous avons besoin d’une nouvelle gouvernance pour le « nouveau monde courageux » du numérique.

Ce château de cartes intellectuel et politique reposait sur l’hypothèse qu’il existe un cyberespace au-delà de l’espace physique. C’était (et c’est toujours) une hypothèse erronée. Le cyberespace n’existe pas. Chaque e-mail, chaque publication, chaque requête d’IA est en fin de compte un événement physique : des impulsions d’électrons transportant des bits et des octets à travers des câbles sous-marins, le Wi-Fi, des serveurs de données et l’infrastructure Internet.

The CDA and its Section 230. Le jour même de la déclaration de Barlow, le président Clinton a promulgué la loi américaine sur la décence dans les communications (US Communications Decency Act, CDA), qui avait été adoptée par le Congrès américain. Cette loi comprenait la section 230, qui accordait aux plateformes Internet une immunité sans précédent : elles ne pouvaient être considérées comme des éditeurs ou des diffuseurs du contenu qu’elles hébergeaient.

Pour la première fois dans l’histoire, les entités commerciales se voyaient accorder une large protection contre toute responsabilité pour l’activité même dont elles tiraient profit. Il s’agissait d’une rupture avec la longue tradition de responsabilité juridique, par exemple celle d’un journal pour les textes qu’il publie ou celle des diffuseurs pour leurs émissions.

Cette disposition était justifiée comme un moyen de protéger une industrie naissante contre des litiges paralysants. À l’époque, les entreprises Internet étaient petites et expérimentales. L’immunité a permis une croissance et une innovation rapides.

Au fil du temps, cependant, ces start-ups sont devenues certaines des entreprises les plus valorisées de l’histoire, avec une portée mondiale et des capitalisations boursières de plusieurs milliers de milliards de dollars. Le cadre juridique est toutefois resté largement inchangé, alors même que les entreprises Internet ont développé des algorithmes sophistiqués qui sélectionnent, amplifient et monétisent le contenu des utilisateurs à grande échelle. Cette divergence a créé une tension centrale dans le droit et l’économie contemporains : des intermédiaires extrêmement puissants opérant avec une responsabilité limitée quant aux effets systémiques.

La convergence des deux. La séparation conceptuelle du « cyberespace » a facilité la défense de cet arrangement. Si Internet était un nouveau monde, des règles exceptionnelles semblaient justifiées.

Cependant, les critiques ont rapidement contesté ce raisonnement. Le juge américain Frank H. Easterbrook a fait valoir que nous n’avions pas besoin d’une loi sur Internet, tout comme nous n’avions pas besoin d’une « loi sur les chevaux » lorsque ceux-ci ont été introduits comme mode de transport dominant. Internet devrait être réglementé en appliquant les principes juridiques existants. Le droit régit les relations entre les personnes et les institutions, quelles que soient les technologies qu’elles utilisent. Le support peut changer, mais les principes sous-jacents demeurent.

L’expérience a largement confirmé ce point de vue. Les technologies numériques n’ont pas effacé les frontières géographiques, elles les ont renforcées. Les États affirment leur juridiction sur les flux de données, la modération des contenus, la fiscalité, la concurrence et la sécurité. La géolocalisation de haute précision, les exigences en matière de localisation des données et les régimes réglementaires nationaux démontrent qu’Internet fonctionne strictement dans les limites territoriales.

Cependant, la CDA reste en vigueur et s’étend à l’ère de l’IA. Les entreprises qui développent de grands modèles linguistiques et d’autres systèmes d’IA s’appuient souvent sur des protections intermédiaires et des doctrines analogues pour limiter leur responsabilité. En conséquence, les outils d’IA peuvent être déployés à l’échelle mondiale avec une surveillance ex ante relativement limitée. Pourtant, leurs résultats peuvent façonner le discours public, influencer les élections, affecter la santé mentale et générer des perturbations économiques.

La question centrale n’est pas de savoir si l’innovation doit être restreinte, mais si elle doit être alignée sur les principes établis de responsabilité. Les technologies n’existent pas en dehors de la société ; elles y sont intégrées. Si une entité conçoit, déploie et tire profit d’un système, elle doit assumer la responsabilité de ses impacts prévisibles. L’ère de l’exceptionnalisme juridique doit prendre fin.

Les gouvernements poursuivent leurs efforts en faveur de la souveraineté numérique

Le mois dernier a été marqué par de nouveaux développements indiquant que la souveraineté numérique est la tendance dominante, qui s’est poursuivie de décembre 2025 à janvier et février 2026.

La Commission européenne a commencé à tester le protocole open source Matrix comme alternative possible aux plateformes de messagerie propriétaires pour la communication interne. L’architecture fédérée de Matrix permet d’héberger les communications sur des infrastructures européennes et de les régir selon les règles de l’UE, ce qui s’inscrit dans le cadre d’efforts plus larges visant à mettre en place des services publics numériques souverains et à réduire la dépendance à l’égard des plateformes externes.

La Commission a également dévoilé EURO-3C, une nouvelle initiative d’une valeur de 75 millions d’euros dans le cadre du programme Horizon Europe visant à construire la première infrastructure européenne à grande échelle de télécommunications fédérées et de cloud de pointe. En fédérant les infrastructures nationales existantes au-delà des frontières, EURO-3C vise à réduire la dépendance vis-à-vis des géants mondiaux hors UE et à renforcer le rôle de l’UE dans le cloud, l’edge computing et les infrastructures d’IA.

En France, le gouvernement a adopté une position ferme en matière de contrôle des infrastructures satellitaires, autre pilier de la souveraineté numérique. Paris a bloqué la vente des actifs des stations terrestres appartenant à Eutelsat à un investisseur externe, arguant que ces infrastructures soutiennent les communications spatiales civiles et militaires et doivent rester sous autorité nationale. Les responsables français ont décrit ces installations comme essentielles à l’autonomie stratégique, en partie parce qu’Eutelsat représente l’un des rares concurrents européens des constellations de satellites américaines telles que Starlink.

En Russie, l’autorité de régulation des télécommunications Roskomnadzor a renforcé les restrictions imposées à Telegram, ralentissant la diffusion des médias et limitant certaines fonctionnalités afin d’inciter les utilisateurs à se tourner vers des alternatives nationales. Roskomnadzor a déclaré que Telegram ne prenait pas de mesures significatives pour lutter contre la fraude, ne protégeait pas les données personnelles des utilisateurs et enfreignait les lois russes. Le fondateur de Telegram a critiqué ces mesures, les qualifiant d’autoritaires et avertissant qu’elles pourraient nuire aux services de communication essentiels.

Cette répression s’est intensifiée avec le blocage complet de WhatsApp, propriété de Meta, utilisé par 100 millions de Russes. Les autorités ont justifié cette interdiction en invoquant le refus de WhatsApp de se conformer aux exigences légales russes. Les utilisateurs sont encouragés à adopter des plateformes soutenues par le gouvernement qui, selon les critiques, permettent la surveillance de l’État, ce qui soulève des inquiétudes quant à la confidentialité et à l’accès à des canaux de communication indépendants. Meta a qualifié cette interdiction de préjudiciable à la sécurité et à la confidentialité.

Malgré ces mesures, la Russie a décidé de suspendre ses actions agressives contre Google, invoquant la dépendance du pays à l’égard des appareils Android et avertissant qu’une interdiction soudaine pourrait perturber des millions d’utilisateurs. Les responsables ont indiqué que toute transition vers des alternatives nationales se ferait progressivement, reflétant une approche prudente visant à réduire la dépendance à l’égard des technologies étrangères.

Pendant ce temps, aux Pays-Bas, la souveraineté numérique est devenue un sujet central des débats parlementaires. Les législateurs ont renouvelé leurs appels en faveur du transfert des données des secteurs public et privé hors des services cloud basés aux États-Unis, invoquant les risques liés à la législation américaine telle que le Cloud Act. Les inquiétudes se sont intensifiées à la suite du projet d’acquisition de Solvinity, qui héberge une partie du système d’identité numérique néerlandais DigiD, par une entreprise américaine. Les députés ont souligné la nécessité de renforcer les garanties, de promouvoir des alternatives européennes ou néerlandaises au cloud et de mettre à jour les règles de passation des marchés publics afin de protéger les données sensibles.

Alors que les décideurs politiques européens évaluent l’autonomie stratégique et le contrôle réglementaire, Washington intensifie simultanément ses efforts pour contrer ce qu’il considère comme des mesures potentiellement perturbatrices au niveau mondial.

Un câble interne du département d’État américain consulté par Reuters demande aux diplomates américains de s’opposer activement aux lois étrangères sur la souveraineté et la localisation des données et de promouvoir une politique internationale plus affirmée des États-Unis en matière de données. Ce câble, signé le 18 février, fait valoir que de telles réglementations pourraient perturber les flux de données mondiaux, augmenter les coûts, créer des exigences de conformité inutilement lourdes et entraver les services de cloud computing et d’intelligence artificielle. La directive encourage également la promotion du Global Cross-Border Privacy Rules Forum (CBPR) comme mécanisme alternatif soutenant les flux de données avec des protections de la vie privée.

Zoom arrière. Cette décision souligne les tensions croissantes avec l’Europe concernant la réglementation en matière de confidentialité et de souveraineté numérique, et reflète une volonté de défendre les intérêts technologiques américains à l’étranger.

Vue d’ensemble. Le fil conducteur est clair : la souveraineté numérique est désormais une considération essentielle pour les gouvernements du monde entier. Les approches peuvent différer, mais l’objectif reste largement le même : garantir que l’avenir numérique d’une nation soit façonné par ses propres priorités et règles. Cependant, la véritable indépendance est entravée par des chaînes d’approvisionnement mondiales profondément ancrées, des coûts prohibitifs pour la mise en place de systèmes parallèles et le risque d’étouffer l’innovation par l’isolement. Si la volonté stratégique de souveraineté est claire, se détacher des écosystèmes technologiques interdépendants nécessitera des années d’investissement, de migration et d’adaptation. Les initiatives actuelles marquent le début d’une transition longue et difficile.

Quand l’éthique de l’IA entre en conflit avec la sécurité nationale : le différend entre Anthropic et le Pentagone

Dans un affrontement à haut risque qui redessine les lignes de front entre la Silicon Valley et l’armée américaine, la société d’intelligence artificielle Anthropic s’est retrouvée exclue du Pentagone après avoir refusé de renoncer à ses garanties éthiques.

Comment cela a commencé : un différend contractuel. Le Pentagone a demandé à Anthropic de garantir que son modèle, Claude, pourrait être utilisé à « toutes fins légales ». Anthropic a refusé, arguant que cette formulation ne limitait pas suffisamment les utilisations que l’entreprise considère comme à haut risque, en particulier la surveillance domestique de masse et les systèmes d’armes entièrement autonomes. L’entreprise a demandé des garde-fous plus clairs.

Comment la situation s’est aggravée : une menace pour la chaîne d’approvisionnement. Les responsables ont indiqué qu’Anthropic risquait de perdre ses contrats fédéraux et pourrait même être désignée comme un risque pour la chaîne d’approvisionnement. L’administration a finalement donné suite à cette mesure, ordonnant aux agences de cesser d’utiliser les systèmes d’Anthropic et accordant une période de transition limitée à six mois pour les accords existants.

Les désignations de risque pour la chaîne d’approvisionnement concernent généralement les menaces étrangères, et non les entreprises nationales qui négocient les termes d’un contrat. Les experts et Anthropic affirment qu’une telle désignation n’a pas de précédent clair et qu’elle est susceptible d’être contestée devant les tribunaux pour cause d’illégalité.

Entrée en scène : la société concurrente.C’est dans ce vide qu’OpenAI est intervenu. Peu après l’inscription d’Anthropic sur la liste noire, OpenAI a conclu son propre accord avec le Pentagone. La société a publiquement souligné qu’elle maintenait des « lignes rouges » en matière de sécurité, notamment des restrictions liées à la surveillance de masse et l’exigence d’un contrôle humain dans l’usage de la force. Le PDG Sam Altman a indiqué qu’OpenAI partageait bon nombre des préoccupations éthiques soulevées par Anthropic. Le Pentagone a accepté le cadre proposé par OpenAI, ce qui soulève des questions quant à la raison pour laquelle des garanties similaires se sont avérées intenables dans le cas d’Anthropic.

Les réactions. Cet épisode a eu des répercussions dans tout le monde technologique. De grands groupes industriels, dont des représentants d’Amazon, de Nvidia, d’Apple et d’autres, ont mis en garde le gouvernement contre une utilisation généralisée des désignations de risque pour la chaîne d’approvisionnement des entreprises technologiques américaines, craignant des effets dissuasifs sur l’innovation et la coopération entre les secteurs public et privé.

Les investisseurs d’Anthropic ont également fait pression pour apaiser les tensions, craignant que l’impasse ne nuise aux activités commerciales de l’entreprise et à ses perspectives d’introduction en bourse si des contrats clés étaient perdus.

Cependant, le lendemain de la perte du contrat avec le Pentagone par Anthropic, Claude s’est hissé à la première place des téléchargements d’applications aux États-Unis, tandis que les désinstallations de l’application mobile ChatGPT ont bondi de 295 % d’un jour à l’autre. Cela suggère que Claude pourrait ne pas perdre en popularité auprès des utilisateurs.

Pourquoi est-ce important ? En fin de compte, ce différend a mis en évidence une tension structurelle plus profonde. Les systèmes d’IA avancés occupent une place de plus en plus centrale dans la planification militaire, la logistique, l’analyse du renseignement et la prise de décision sur le champ de bataille. Dans le même temps, les principales entreprises d’IA ont défini des limites éthiques en matière de surveillance, d’autonomie létale et de risques liés au double usage.

La confrontation entre Anthropic et le Pentagone a cristallisé la question de savoir qui détermine ces limites lorsque la sécurité nationale et la gouvernance d’entreprise entrent en conflit.

Cependant, alors qu’Anthropic et le Pentagone seraient de retour à la table des négociations, cela souligne que la question est loin d’être résolue.tection mises en œuvre jusqu’à présent, soulignant que les solutions pourraient devoir être adaptées aux différentes juridictions.

Le mois dernier à Genève

Comprendre le groupe de travail d’UNCTAD sur la gouvernance des données | Partie 3

Le 10 février, Diplo, l’Open Knowledge Foundation et la Geneva Internet Platform ont coorganisé un événement en ligne intitulé « Décrypter le groupe de travail d’UNCTAD sur la gouvernance des données | Partie 3 », qui a examiné les progrès et les perspectives du groupe de travail multipartite des Nations unies sur la gouvernance des données. Les participants ont indiqué que les discussions s’étaient intensifiées ces derniers mois après des retards procéduraux initiaux. Cependant, de profondes divergences subsistent. L’une des lignes de fracture concerne la question de savoir si la gouvernance des données doit se concentrer principalement sur la protection de la vie privée des individus ou intégrer des droits sociétaux et collectifs plus larges en matière de données. Une autre porte sur la question de savoir si l’interopérabilité doit être considérée comme un bien public intrinsèque ou évaluée à la lumière des risques potentiels tels que la concentration du marché et l’extractivisme des données. Un troisième sujet de controverse concerne les flux transfrontaliers de données. Certains considèrent que la libre circulation des données dans un climat de confiance est essentielle à l’intégration dans les marchés mondiaux de l’innovation.

D’autres soutiennent que les asymétries en matière d’infrastructures et de pouvoir de négociation nécessitent de préserver l’autonomie réglementaire des pays en développement, y compris la capacité de mener des politiques de souveraineté des données alignées sur les priorités nationales de développement. Les intervenants ont souligné que le renforcement des capacités est devenu un domaine de convergence croissante. Les gouvernements de toutes les régions ont appelé à un soutien technique, institutionnel et politique pour développer des systèmes interopérables et renforcer les cadres nationaux de gouvernance des données. Bien que le rapport final sera succinct, les membres ont indiqué qu’il refléterait les divergences de vues sans privilégier les positions majoritaires.

Les discussions se poursuivent pour déterminer si le résultat final doit inclure des recommandations ou rester descriptif.

Le groupe de travail doit se réunir à nouveau à Genève en mars, alors qu’il s’apprête à finaliser un document qui, selon ses promoteurs, devrait guider les débats internationaux sur la gouvernance des données dans les années à venir.

Menaces hybrides: Comment améliorer la résilience face à ce phénomène?

L’Institut des Nations Unies pour la recherche sur le désarmement (UNIDIR), en partenariat avec l’Organisation internationale de la Francophonie (OIF), a organisé un événement afin d’examiner le phénomène des menaces hybrides. Les experts ont recommandé de renforcer la gouvernance multilatérale grâce à des normes harmonisées pour l’espace et les plateformes en ligne, de renforcer la résilience sociétale par l’information et l’application de la loi, et de protéger les infrastructures critiques par la cybersécurité et des mesures de protection opérationnelles. Il est essentiel de soutenir les États moins bien équipés en leur fournissant des outils techniques, réglementaires et de gestion des risques, tout en envoyant des signaux stratégiques pour clairement montrer les conséquences d’actions inacceptables. Le principe directeur de toutes ces mesures est l’intégration : les domaines spatial, informationnel et cybernétique doivent être gérés conjointement afin de maintenir la stabilité et la résilience mondiales.

Lancement du Rapport mondial sur la propriété intellectuelle 2026 : La technologie en mouvement