Rétrospective de décembre 2025 et janvier 2026

La newsletter de ce mois-ci revient sur les mois de décembre 2025 et janvier 2026 et explore les forces qui façonnent le paysage numérique en 2026 :

Bilan du SMSI+20 : examen approfondi du document final et de la réunion d’examen de haut niveau, et implications pour la coopération numérique mondiale.

Sécurité des enfants en ligne : la dynamique en faveur des interdictions se poursuit, tandis que des procès historiques aux États-Unis examinent la dépendance aux plateformes et la responsabilité.

Souveraineté numérique : les gouvernements réévaluent leurs politiques en matière de données, d’infrastructures et de technologies afin de limiter l’exposition étrangère et de renforcer les capacités nationales.

Grok Shock : l’outil d’IA de X, Grok, fait l’objet d’un examen réglementaire après des signalements de contenus sexuels non consensuels et de deepfakes.

Geneva Engage Awards : les temps forts de la 11e édition, qui récompense l’excellence en matière de communication et d’engagement numériques dans la Genève internationale.

Prévisions annuelles en matière d’IA et de numérique : nous mettons en avant les 10 tendances et événements qui, selon nous, façonneront le paysage numérique au cours de l’année à venir.

Baromètre

GOUVERNANCE NUMÉRIQUE

Les États-Unis se sont retirés d’un large éventail d’organisations, de conventions et de traités internationaux qu’ils jugent contraires à leurs intérêts, notamment de dizaines d’organismes des Nations unies et d’entités non onusiennes. Dans le domaine de la technologie et de la gouvernance numérique, ils ont explicitement abandonné deux initiatives : la Freedom Online Coalition et le Forum mondial sur l’expertise cybernétique. Les implications du retrait de la CNUCED et du Département des affaires économiques et sociales des Nations unies restent floues, compte tenu de leurs liens avec des processus tels que le SMSI, le suivi de l’Agenda 2030, le Forum sur la gouvernance de l’Internet et les travaux plus larges sur la gouvernance des données.

TECHNOLOGIES

Le président américain Donald Trump a signé une proclamation présidentielle imposant un droit de douane de 25 % sur certaines puces informatiques avancées et orientées vers l’IA, y compris des produits haut de gamme tels que le H200 de Nvidia et le MI325X d’AMD, dans le cadre d’un examen de sécurité nationale. Les responsables ont décrit cette mesure comme une « première étape » visant à renforcer la production nationale et à réduire la dépendance vis-à-vis des fabricants étrangers, en particulier ceux de Taïwan, tout en captant les revenus provenant des importations qui ne contribuent pas à la capacité de production américaine. L’administration a laissé entendre que d’autres mesures pourraient suivre en fonction de l’évolution des négociations avec les partenaires commerciaux et l’industrie.

Les États-Unis et Taïwan ont annoncé un accord commercial historique axé sur les semi-conducteurs. Dans le cadre de cet accord, les droits de douane sur un large éventail de produits taïwanais exportés seront réduits ou supprimés, tandis que les entreprises taïwanaises de semi-conducteurs, notamment des sociétés de premier plan telles que TSMC, se sont engagées à investir au moins 250 milliards de dollars dans la fabrication de puces, l’IA et des projets énergétiques aux États-Unis, avec le soutien d’un crédit supplémentaire de 250 milliards de dollars garanti par le gouvernement.

Le conflit juridique et politique qui oppose depuis longtemps le fabricant néerlandais de semi-conducteurs Nexperia, une entreprise basée aux Pays-Bas et détenue par la société chinoise Wingtech Technology, se poursuit également. Ce litige a éclaté à l’automne 2025, lorsque les autorités néerlandaises ont brièvement pris le contrôle de Nexperia, invoquant la sécurité nationale et des inquiétudes concernant d’éventuels transferts de technologie vers la Chine. La direction européenne de Nexperia et les représentants de Wingtech s’affrontent actuellement devant un tribunal d’Amsterdam, qui doit décider s’il y a lieu d’ouvrir une enquête officielle sur des allégations de mauvaise gestion. Le tribunal devrait rendre sa décision dans un délai de quatre semaines.

Selon certaines informations, des scientifiques chinois auraient construit un prototype de machine de lithographie par ultraviolets extrêmes, une technologie longtemps dominée par ASML. Cette entreprise néerlandaise est le seul fournisseur de systèmes EUV et un maillon essentiel dans la fabrication de puces de pointe. Les outils EUV sont indispensables à la production de puces de pointe utilisées dans l’IA, le calcul haute performance et les armes modernes, car ils permettent de graver des circuits ultra-fins sur des plaquettes de silicium. Le prototype produirait déjà de la lumière EUV, mais n’aurait pas encore permis de fabriquer des puces fonctionnelles. D’anciens ingénieurs d’ASML auraient participé à ce projet en procédant à la rétro-ingénierie de composants clés.

Le Canada a lancé la phase 1 du programme Canadian Quantum Champions dans le cadre d’un investissement de 334,3 millions de dollars prévu dans le budget 2025, fournissant jusqu’à 92 millions de dollars de financement initial, soit jusqu’à 23 millions de dollars chacun à Anyon Systems, Nord Quantique, Photonic et Xanadu, afin de faire progresser les ordinateurs quantiques tolérants aux pannes et de conserver des capacités clés au Canada, les progrès étant évalués grâce à une nouvelle plateforme d’analyse comparative dirigée par le Conseil national de recherches.

Les États-Unis auraient suspendu la mise en œuvre de leur accord Tech Prosperity Deal avec le Royaume-Uni, un pacte conclu lors de la visite du président Trump à Londres en septembre, qui visait à approfondir la coopération dans le domaine des technologies de pointe telles que l’IA et le quantique et comprenait des engagements d’investissement prévus par les grandes entreprises technologiques américaines. Selon le Financial Times, cette suspension reflète la frustration générale des États-Unis face à la position du Royaume-Uni sur des questions commerciales plus larges, Washington cherchant à obtenir des concessions du Royaume-Uni sur les barrières non tarifaires, en particulier les normes réglementaires applicables aux denrées alimentaires et aux produits industriels, avant de faire avancer l’accord technologique.

Lors du 16e sommet UE-Inde à New Delhi, l’UE et l’Inde sont entrées dans une nouvelle phase de coopération en concluant un accord de libre-échange historique et en lançant un partenariat en matière de sécurité et de défense, signe d’un alignement plus étroit dans un contexte de pressions économiques et géopolitiques mondiales. L’accord commercial vise à réduire les barrières tarifaires et non tarifaires et à renforcer les chaînes d’approvisionnement, tandis que le volet sécurité élargit la coopération dans des domaines tels que la sécurité maritime, les menaces cybernétiques et hybrides, la lutte contre le terrorisme, l’espace et la collaboration industrielle en matière de défense.La Corée du Sud et l’Italie ont convenu d’approfondir leur partenariat stratégique en élargissant leur coopération dans les domaines de la haute technologie, en particulier l’IA, les semi-conducteurs et l’espace. Les responsables ont présenté cette initiative comme un moyen de renforcer la compétitivité à long terme grâce à une collaboration plus étroite en matière de recherche, à des échanges de talents et à des initiatives de développement conjointes, même si les programmes spécifiques n’ont pas encore été détaillés publiquement.

INFRASTRUCTURE

L’UE a adopté la loi sur les réseaux numériques, qui vise à réduire la fragmentation grâce à une harmonisation limitée du spectre et à un système de numérotation à l’échelle de l’UE pour les services commerciaux transfrontaliers, sans pour autant parvenir à un véritable marché unifié des télécommunications. Le principal obstacle reste la résistance des États membres qui souhaitent conserver le contrôle de la gestion du spectre, en particulier pour la 4G, la 5G et le Wi-Fi, ce qui fait de ce paquet une mesure progressive plutôt qu’une refonte structurelle, malgré les appels de longue date en faveur d’une intégration plus poussée.

Le deuxième Sommet international sur la résilience des câbles sous-marins s’est conclu par la déclaration de Porto sur la résilience des câbles sous-marins, qui réaffirme le rôle essentiel des câbles de télécommunications sous-marins pour la connectivité mondiale, le développement économique et l’inclusion numérique. La déclaration s’appuie sur la déclaration d’Abuja de 2025 et contient des orientations pratiques supplémentaires ainsi que des recommandations non contraignantes visant à renforcer la coopération internationale et la résilience, notamment en rationalisant les procédures d’autorisation et de réparation, en améliorant les cadres juridiques et réglementaires, en favorisant la diversité géographique et la redondance, en adoptant les meilleures pratiques en matière d’atténuation des risques, en améliorant la planification de la protection des câbles et en stimulant le renforcement des capacités et l’innovation, afin de soutenir une infrastructure numérique mondiale plus fiable et plus inclusive.

CYBERSÉCURITÉ

Roblox fait l’objet d’une enquête officielle aux Pays-Bas, l’Autoriteit Consument & Markt (ACM) ayant ouvert une enquête officielle afin d’évaluer si Roblox prend des mesures suffisantes pour protéger les enfants et les adolescents qui utilisent le service. L’enquête examinera la conformité de Roblox avec la loi européenne sur les services numériques (DSA), qui oblige les services en ligne à mettre en œuvre des mesures appropriées et proportionnées pour garantir la sécurité et la confidentialité des utilisateurs mineurs, et pourrait durer jusqu’à un an.

Meta, qui faisait l’objet d’une surveillance intense de la part des régulateurs et de la société civile en raison de ses chatbots qui autorisaient auparavant des conversations provocantes ou abusives avec des mineurs, suspend l’accès des adolescents à ses personnages IA à l’échelle mondiale pendant qu’elle repense l’expérience en renforçant la sécurité et le contrôle parental. La société a déclaré que les adolescents ne pourront plus interagir avec certains personnages IA jusqu’à ce qu’une plateforme révisée soit prête, guidée par des principes similaires à un système de classification PG-13 afin de limiter l’exposition à des contenus inappropriés.

L’ETSI a publié une nouvelle norme, EN 304 223, qui définit les exigences en matière de cybersécurité pour les systèmes d’IA tout au long de leur cycle de vie, en traitant les menaces spécifiques à l’IA telles que l’empoisonnement des données et l’injection rapide, avec des conseils supplémentaires sur les risques liés à l’IA générative attendus dans un rapport complémentaire.

L’UE a proposé un nouveau paquet de mesures en matière de cybersécurité afin de renforcer la sécurité de la chaîne d’approvisionnement, d’étendre et d’accélérer la certification, de rationaliser la conformité et la notification au titre de la directive NIS2, et de conférer à l’ENISA des pouvoirs opérationnels plus étendus, tels que l’alerte en cas de menace, la gestion des vulnérabilités et l’assistance en cas de rançongiciel.

Un groupe d’agences internationales de cybersécurité a publié de nouvelles directives techniques concernant la sécurité des technologies opérationnelles (OT) utilisées dans les environnements industriels et les infrastructures critiques. Ces directives, élaborées sous l’égide du Centre national de cybersécurité (NCSC) du Royaume-Uni, fournissent des recommandations pour connecter en toute sécurité les systèmes de contrôle industriels, les capteurs et autres équipements opérationnels qui soutiennent les services essentiels. Selon les agences co-auteurs, les environnements industriels sont la cible d’une série d’acteurs, notamment des groupes cybercriminels et des acteurs liés à des États.

Le Royaume-Uni a lancé un programme intitulé « Software Security Ambassadors Scheme » (Programme des ambassadeurs de la sécurité logicielle), dirigé par le ministère des Sciences, de l’Innovation et de la Technologie et le Centre national de cybersécurité. Ce programme invite les organisations participantes à promouvoir un nouveau code de bonnes pratiques en matière de sécurité logicielle dans leurs secteurs respectifs et à améliorer la sécurité du développement et des achats afin de renforcer la résilience de la chaîne d’approvisionnement.

Les responsables britanniques et chinois de la sécurité ont convenu de créer un nouveau forum de dialogue sur la cybersécurité afin de discuter des cyberattaques et de gérer les menaces numériques, dans le but de créer des canaux de communication plus clairs, de réduire le risque d’erreurs d’appréciation dans le cyberespace et de promouvoir un comportement responsable des États en matière de sécurité numérique.

ÉCONOMIE

Les ministres de l’UE ont appelé à accélérer les progrès vers les objectifs numériques de l’Union pour 2030, en demandant un renforcement des compétences numériques, une adoption plus large des technologies et des règles plus simples pour les PME et les start-ups, tout en préservant la protection des données et les droits fondamentaux, ainsi qu’une application plus stricte et plus cohérente des règles en matière de sécurité en ligne, de contenus illégaux, de protection des consommateurs et de cyber-résilience.

La Corée du Sud a approuvé des modifications législatives visant à reconnaître les titres tokenisés et à établir des règles pour leur émission et leur négociation dans le cadre du système réglementé des marchés de capitaux. La mise en œuvre est prévue pour janvier 2027, après une période de préparation. Ce cadre permet aux émetteurs éligibles de créer des produits de dette et d’actions basés sur la blockchain, tandis que la négociation se ferait par l’intermédiaire d’intermédiaires agréés, conformément aux règles existantes en matière de protection des investisseurs.

La Russie conserve le rouble comme seul moyen de paiement légal et continue de rejeter les cryptomonnaies en tant que monnaie, mais les législateurs s’orientent vers une reconnaissance juridique plus large des cryptomonnaies en tant qu’actifs, avec notamment une proposition visant à les traiter comme des biens matrimoniaux en cas de divorce, parallèlement à une utilisation limitée et réglementée des cryptomonnaies dans le commerce extérieur.

Le Royaume-Uni prévoit d’intégrer pleinement les cryptoactifs dans son périmètre de réglementation financière, les entreprises de cryptomonnaies étant réglementées par la Financial Conduct Authority à partir de 2027 selon des règles similaires à celles applicables aux produits financiers traditionnels, dans le but de renforcer la protection des consommateurs, la transparence et la confiance du marché tout en soutenant l’innovation et en réprimant les activités illicites, parallèlement aux efforts visant à définir des normes internationales grâce à une coopération telle que celle mise en place par un groupe de travail britannique-américain.

Le projet d’extension des licences cryptographiques à Hong Kong suscite l’inquiétude du secteur, qui craint que des seuils plus stricts ne contraignent davantage d’entreprises à obtenir une licence complète, n’augmentent les coûts de mise en conformité et ne prévoient pas de période de transition claire, ce qui pourrait perturber les activités pendant le traitement des demandes.

Les efforts de la Pologne pour introduire une loi complète sur les cryptomonnaies ont abouti à une impasse après que le Sejm n’ait pas réussi à renverser le veto du président Karol Nawrocki sur un projet de loi visant à aligner les règles nationales sur le cadre MiCA de l’UE. Le gouvernement a fait valoir que la réforme était essentielle pour la protection des consommateurs et la sécurité nationale, mais le président l’a rejetée, la jugeant trop contraignante et menaçant la liberté économique. À la suite de cela, le Premier ministre Donald Tusk s’est engagé à renouveler ses efforts pour faire adopter une législation sur les cryptomonnaies.

Les efforts déployés par la Pologne pour introduire une loi globale sur les cryptomonnaies ont abouti à une impasse après que la Diète nationale (Sejm) n’ait pas réussi à passer outre le veto du président Karol Nawrocki sur un projet de loi visant à aligner les règles nationales sur le cadre MiCA de l’UE. Le gouvernement a fait valoir que cette réforme était essentielle pour la protection des consommateurs et la sécurité nationale, mais le président l’a rejetée, la jugeant trop contraignante et menaçante pour la liberté économique. À la suite de cela, le Premier ministre Donald Tusk s’est engagé à renouveler ses efforts pour faire adopter une législation sur les cryptomonnaies.

En Norvège, la Norges Bank a conclu que les conditions actuelles ne justifiaient pas le lancement d’une monnaie numérique de banque centrale, arguant que le système de paiement norvégien restait sûr, efficace et bien adapté aux utilisateurs. La banque soutient que la couronne norvégienne continue de fonctionner de manière fiable, grâce à des dispositifs d’urgence solides et à des performances opérationnelles stables. La gouverneure Ida Wolden Bache a déclaré que cette évaluation reflétait davantage un choix de timing qu’un rejet des CBDC, précisant que la banque pourrait en introduire une si les conditions changeaient ou si de nouveaux risques apparaissaient dans le paysage des paiements nationaux.

Les États membres de l’UE introduiront un nouveau droit de douane sur les importations de faible valeur issues du commerce électronique à compter du 1er juillet 2026. En vertu de l’accord, un droit de douane de 3 euros par article sera appliqué aux colis d’une valeur inférieure à 150 euros importés directement dans l’UE en provenance de pays tiers. Ce droit temporaire vise à combler le vide jusqu’à ce que le centre de données douanières de l’UE, une initiative de réforme douanière plus large destinée à fournir des données complètes sur les importations et à renforcer les capacités de contrôle, soit pleinement opérationnel en 2028.

DÉVELOPPEMENT

L’UNESCO a exprimé sa préoccupation croissante face à l’utilisation croissante des coupures d’Internet par les gouvernements qui cherchent à gérer les crises politiques, les manifestations et les périodes électorales. Des données récentes indiquent que plus de 300 coupures ont eu lieu dans 54 pays au cours des deux dernières années, 2024 étant l’année la plus grave depuis 2016. Selon l’UNESCO, la restriction de l’accès à Internet porte atteinte au droit universel à la liberté d’expression et affaiblit la capacité des citoyens à participer à la vie sociale, culturelle et politique. L’accès à l’information reste essentiel non seulement pour l’engagement démocratique, mais aussi pour les droits liés à l’éducation, à la réunion et à l’association, en particulier en période d’instabilité. Les perturbations d’Internet exercent également une pression considérable sur les journalistes, les médias et les systèmes d’information publique qui diffusent des informations vérifiées.

L’OCDE affirme que l’IA générative se répand rapidement dans les écoles, mais que les résultats sont mitigés : les chatbots à usage général peuvent améliorer la qualité du travail des élèves sans pour autant améliorer leurs résultats aux examens, et peuvent affaiblir l’apprentissage profond lorsqu’ils remplacent les « efforts productifs ». Elle soutient que les outils d’IA spécifiques à l’éducation, conçus autour des sciences de l’apprentissage et utilisés comme tuteurs ou assistants collaboratifs, sont plus susceptibles d’améliorer les résultats et devraient être prioritaires et rigoureusement évalués.

Le Royaume-Uni va tester des outils de tutorat basés sur l’IA dans les écoles secondaires, dans le but de les rendre disponibles à l’échelle nationale d’ici la fin 2027. Les enseignants participeront à leur conception et à leur test, et la sécurité, la fiabilité et l’alignement sur le programme national seront considérés comme des exigences fondamentales. Cette initiative vise à fournir un soutien personnalisé et à contribuer à réduire les écarts de réussite scolaire. Elle pourrait bénéficier chaque année à près de 450 000 élèves défavorisés de la 3e à la 1re, tout en positionnant ces outils comme un complément à l’enseignement en classe et non comme un substitut.

SOCIOCULTUREL

L’UE a désigné WhatsApp comme une très grande plateforme en ligne au titre de la loi sur les services numériques (DSA) après que celle-ci a déclaré plus de 51 millions d’utilisateurs mensuels dans l’Union, ce qui entraîne des obligations plus strictes en matière d’évaluation et d’atténuation des risques systémiques tels que la désinformation et de renforcement de la protection des mineurs et des utilisateurs vulnérables. La Commission européenne supervisera directement la conformité, avec des amendes pouvant atteindre 6 % du chiffre d’affaires annuel mondial, et WhatsApp a jusqu’à la mi-mai pour aligner ses politiques et ses évaluations des risques sur les exigences de la DSA.

L’UE a rendu sa première décision de non-conformité au DSA à l’encontre de X, infligeant une amende de 120 millions d’euros à la plateforme pour avoir induit en erreur avec sa vérification payante « blue check », pour le manque de transparence de ses publicités en raison d’un référentiel publicitaire incomplet et les entraves à l’accès aux données publiques pour les chercheurs. X doit proposer des solutions pour le système de vérification dans un délai de 60 jours ouvrables et soumettre un plan plus large sur l’accès aux données et la transparence publicitaire dans un délai de 90 jours, sous peine de faire l’objet de nouvelles mesures coercitives.

L’UE a accepté les engagements contraignants pris par TikTok dans le cadre de la DSA pour rendre les publicités plus transparentes, notamment en affichant les publicités exactement telles que les utilisateurs les voient, en ajoutant des détails sur le ciblage et les données démographiques, en mettant à jour son référentiel publicitaire dans les 24 heures et en élargissant les outils et l’accès pour les chercheurs et le public, avec des délais de mise en œuvre allant de deux à douze mois.

WhatsApp fait face à une pression croissante de la part des autorités russes, qui affirment que le service ne respecte pas les règles nationales en matière de stockage des données et de coopération avec les forces de l’ordre, tandis que Meta n’a aucune présence légale en Russie et rejette les demandes d’informations sur les utilisateurs. Les responsables font la promotion d’alternatives soutenues par l’État, telles que l’application de messagerie nationale Max, et les détracteurs avertissent que cibler WhatsApp limiterait les communications privées plutôt que de répondre à de véritables menaces pour la sécurité.

Gouvernance de l’IA en décembre 2025 et janvier 2026

Réglementation nationale en matière d’IA

Vietnam. L’Assemblée nationale vietnamienne a adopté la première loi complète du pays sur l’IA, établissant un régime de gestion des risques, des tests en sandbox, un fonds national de développement de l’IA et des programmes de bons pour les start-ups afin d’équilibrer les mesures de protection strictes et les incitations à l’innovation. La législation de 35 articles, largement inspirée des modèles de l’UE et d’autres pays, centralise la surveillance de l’IA sous l’égide du gouvernement et entrera en vigueur en mars 2026.

Royaume-Uni. Plus d’une centaine de parlementaires britanniques de tous bords politiques poussent le gouvernement à adopter des règles contraignantes sur les systèmes d’IA avancés, affirmant que les cadres actuels sont en retard par rapport aux progrès technologiques rapides et présentent des risques pour la sécurité nationale et mondiale. Cette campagne multipartite, soutenue par d’anciens ministres et des personnalités du monde technologique, vise à instaurer des normes de test obligatoires, une surveillance indépendante et une coopération internationale renforcée, remettant en cause la préférence du gouvernement pour la réglementation existante, largement volontaire.

États-Unis. Le président américain Donald Trump a signé un décret vcontre ce que l’administration considère comme les lois les plus contraignantes et excessives en matière d’IA au niveau des États. La Maison Blanche estime que la multiplication des règles étatiques menace de freiner l’innovation, d’alourdir la charge des développeurs et d’affaiblir la compétitivité des États-Unis.

Pour remédier à cette situation, le décret crée un groupe de travail sur les litiges liés à l’IA chargé de contester les lois étatiques jugées contraires à la politique définie dans le décret, afin de maintenir et de renforcer la domination mondiale des États-Unis dans le domaine de l’IA grâce à un cadre politique national peu contraignant. Le département du Commerce est chargé d’examiner toutes les réglementations étatiques en matière d’IA dans un délai de 90 jours afin d’identifier celles qui imposent des contraintes excessives. Il utilise également les fonds fédéraux comme levier, en conditionnant l’octroi de certaines subventions à l’alignement des États sur la politique nationale en matière d’IA.

Plans et investissements nationaux

Russie. La Russie met en œuvre un plan national visant à étendre l’utilisation de l’IA générative dans l’administration publique et les secteurs clés, avec la création d’un siège central chargé de coordonner les ministères et les agences. Les responsables considèrent que le déploiement accru de systèmes génératifs nationaux est un moyen de renforcer la souveraineté, d’améliorer l’efficacité et de stimuler le développement économique régional, en donnant la priorité à l’IA développée localement plutôt qu’aux plateformes étrangères.

Qatar. Le Qatar a lancé Qai, une nouvelle entreprise nationale d’IA conçue pour accélérer la transformation numérique du pays et renforcer sa présence mondiale dans le domaine de l’IA. Qai fournira des infrastructures informatiques haute performance et une infrastructure d’IA évolutive, en collaboration avec des instituts de recherche, des décideurs politiques et des partenaires du monde entier afin de promouvoir l’adoption de technologies de pointe qui soutiennent le développement durable et la diversification économique.

L’UE. L’UE a mis en place un programme ambitieux de gigafactories afin de renforcer son leadership en matière d’IA en développant les infrastructures et les capacités de calcul dans tous les États membres. Cela implique l’extension d’un réseau d’« usines » et d’antennes d’IA qui fournissent des capacités de calcul haute performance et une expertise technique aux start-ups, aux PME et aux chercheurs, en intégrant le soutien à l’innovation aux cadres réglementaires tels que la loi sur l’IA.

Australie. L’Australie a conclu un accord de 4,6 milliards de dollars pour la création d’un nouveau pôle d’IA dans l’ouest de Sydney, en partenariat avec des acteurs du secteur privé, afin de construire un campus d’IA doté d’une infrastructure GPU étendue capable de prendre en charge des charges de travail avancées. Cet investissement s’inscrit dans le cadre d’efforts nationaux plus larges visant à établir une capacité nationale d’innovation et de calcul en matière d’IA.

Maroc. Le Maroc s’apprête à dévoiler « Maroc IA 2030 », une feuille de route nationale en matière d’IA conçue pour structurer l’écosystème de l’IA du pays et renforcer la transformation numérique. Ce plan vise à ajouter environ 10 milliards de dollars au PIB d’ici 2030, à créer des dizaines de milliers d’emplois liés à l’IA et à intégrer l’IA dans l’industrie et le gouvernement, notamment en modernisant les services publics et en renforçant l’autonomie technologique. Au cœur de cette stratégie se trouve le lancement de l’Institut JAZARI ROOT, plaque tournante d’un réseau prévu de centres d’excellence en IA qui fera le lien entre la recherche, l’innovation régionale et le déploiement pratique. D’autres initiatives comprennent la mise en place d’une infrastructure de données souveraine et des partenariats avec des entreprises mondiales spécialisées dans l’IA. Les autorités mettent également l’accent sur le renforcement des compétences nationales et de la confiance dans l’IA, avec des structures de gouvernance et des propositions législatives qui devraient accompagner la mise en œuvre.

Initiatives de renforcement des capacités

États-Unis. L’administration Trump a dévoilé une nouvelle initiative, baptisée US Tech Force, qui vise à reconstruire les capacités techniques du gouvernement américain après d’importantes réductions d’effectifs, en mettant particulièrement l’accent sur l’IA et la transformation numérique.

Selon le site officiel TechForce.gov, les participants travailleront sur des missions fédérales à fort impact, relevant des défis civiques et nationaux à grande échelle. Le programme se positionne comme un pont entre la Silicon Valley et Washington, encourageant les technologues expérimentés à introduire les pratiques industrielles dans les environnements gouvernementaux. Le programme reflète la préoccupation croissante au sein de l’administration quant au manque d’expertise interne des agences fédérales pour déployer et superviser les technologies de pointe, d’autant plus que l’IA devient centrale dans l’administration publique, la défense et la prestation de services.

Taïwan. Le gouvernement taïwanais s’est fixé l’objectif ambitieux de former 500 000 professionnels de l’IA d’ici 2040 dans le cadre de sa stratégie de développement à long terme de l’IA, soutenue par un fonds de capital-risque de 100 milliards de nouveaux dollars taïwanais (environ 3,2 milliards de dollars américains) et une initiative nationale de centre de calcul. Le président Lai Ching-te a annoncé cet objectif lors d’un forum sur les talents en IA organisé à Taipei en 2026, soulignant la nécessité d’une large culture de l’IA dans toutes les disciplines afin de maintenir la compétitivité nationale, de soutenir les écosystèmes d’innovation et d’accélérer la transformation numérique dans les petites et moyennes entreprises. Le gouvernement met en place des programmes de formation pour les étudiants et les fonctionnaires et met l’accent sur la coopération entre l’industrie, le monde universitaire et le gouvernement afin de développer un vivier de talents polyvalents en IA.

El Salvador. El Salvador s’est associé à xAI pour lancer le premier programme éducatif national au monde basé sur l’IA, déployant le modèle Grok dans plus de 5 000 écoles publiques afin d’offrir un tutorat personnalisé et adapté au programme scolaire à plus d’un million d’élèves au cours des deux prochaines années. Cette initiative aidera les enseignants grâce à des outils d’IA adaptatifs, tout en développant conjointement des méthodologies, des ensembles de données et des cadres de gouvernance pour une utilisation responsable de l’IA dans les salles de classe, dans le but de combler les lacunes en matière d’apprentissage et de moderniser le système éducatif. Le président Nayib Bukele a décrit cette initiative comme un bond en avant dans la transformation numérique nationale.

Centre de ressources de l’ONU sur l’IA. Le Centre de ressources de l’ONU sur l’IA a été mis en ligne en tant que plateforme centralisée regroupant les activités et l’expertise en matière d’IA dans l’ensemble du système des Nations unies. Présentée par le Groupe de travail interinstitutions des Nations unies sur l’IA, la plateforme a été développée grâce à la collaboration conjointe du PNUD, de l’UNESCO et de l’UIT. Elle permet aux parties prenantes d’explorer les initiatives par agence, par pays et par ODD. Le centre soutient la collaboration interinstitutions, les capacités des États membres de l’ONU et une meilleure cohérence dans la gouvernance et la terminologie de l’IA.

Partenariats

Canada-UE. Le Canada et l’UE ont élargi leur partenariat numérique en matière d’IA et de sécurité, s’engageant à approfondir leur coopération sur les systèmes d’IA fiables, la gouvernance des données et les infrastructures numériques partagées. Cela comprend des protocoles d’accord visant à faire progresser l’interopérabilité, à harmoniser les normes et à encourager la collaboration sur les services numériques fiables.

Le Réseau international pour la mesure, l’évaluation et la science avancées en matière d’IA. Ce réseau mondial a renforcé la coopération en matière d’analyse comparative des progrès réalisés dans la gouvernance de l’IA, en se concentrant sur des indicateurs qui permettent de comparer les politiques nationales, d’identifier les lacunes et de soutenir la prise de décision fondée sur des données probantes dans la réglementation internationale de l’IA. Ce réseau comprend l’Australie, le Canada, l’UE, la France, le Japon, le Kenya, la République de Corée, Singapour, le Royaume-Uni et les États-Unis. Le Royaume-Uni a assumé le rôle de coordinateur du réseau.

BRICS. Les discussions sur la gouvernance de l’IA au sein du bloc BRICS se sont intensifiées, les États membres cherchant à harmoniser leurs approches nationales et à partager des principes communs pour un déploiement éthique, inclusif et coopératif de l’IA. Il est toutefois encore prématuré de parler de la création d’une IA-BRICS, a déclaré le vice-ministre des Affaires étrangères Sergueï Riabkov, sherpa russe du BRICS.

ASEAN-Japon. Le Japon et l’Association des nations de l’Asie du Sud-Est (ASEAN) ont convenu d’approfondir leur coopération en matière d’IA, comme l’a officialisé une déclaration commune lors d’une réunion des ministres du numérique à Hanoï. Ce partenariat se concentre sur le développement conjoint de modèles d’IA, l’harmonisation des législations connexes et le renforcement des liens de recherche afin d’améliorer les capacités technologiques et la compétitivité régionales face à la concurrence mondiale des États-Unis et de la Chine.

Pax Silica. Un groupe diversifié de nations a annoncé la création de Pax Silica, un nouveau partenariat visant à mettre en place des chaînes d’approvisionnement sûres, résilientes et axées sur l’innovation pour les technologies qui sous-tendent l’ère de l’IA. Il s’agit notamment des minéraux et des intrants énergétiques essentiels, de la fabrication de pointe, des semi-conducteurs, des infrastructures d’IA et de la logistique. Les analystes préviennent que des divergences d’opinion pourraient apparaître si Washington poussait à l’adoption de mesures plus strictes à l’encontre de la Chine, ce qui pourrait accroître la pression politique et économique sur les pays participants. Cependant, les États-Unis, qui dirigent la plateforme, ont précisé que celle-ci se concentrerait sur le renforcement des chaînes d’approvisionnement entre ses membres plutôt que sur la pénalisation des pays non membres, comme la Chine.

Gouvernance des contenus

Italie. L’autorité antitrust italienne a officiellement clos son enquête sur le développeur chinois d’IA DeepSeek après que l’entreprise ait accepté de prendre des engagements contraignants pour rendre les risques liés aux hallucinations de l’IA (résultats faux ou trompeurs) plus clairs et plus accessibles aux utilisateurs. Les régulateurs ont déclaré que DeepSeek améliorera la transparence en fournissant des avertissements et des informations plus clairs adaptés aux utilisateurs italiens, alignant ainsi le déploiement de son chatbot sur les exigences réglementaires locales. Si ces conditions ne sont pas remplies, des mesures coercitives pourraient être prises en vertu de la loi italienne.

Espagne. Le gouvernement espagnol a approuvé un projet de loi visant à lutter contre les deepfakes générés par l’IA et à renforcer les règles de consentement relatives à l’utilisation d’images et de voix. Le projet de loi fixe à 16 ans l’âge minimum pour consentir à l’utilisation d’images et interdit la réutilisation d’images en ligne ou de ressemblances générées par l’IA sans autorisation explicite, y compris à des fins commerciales, tout en autorisant les satires ou les œuvres créatives clairement identifiées impliquant des personnalités publiques. Cette réforme renforce les mesures de protection des enfants et s’inscrit dans le cadre des projets plus larges de l’UE visant à criminaliser les deepfakes sexuels non consensuels d’ici 2027. Les procureurs examinent également si certains contenus générés par l’IA pourraient être qualifiés de pornographie enfantine en vertu de la législation espagnole.

Malte. Le gouvernement maltais prépare des mesures juridiques plus strictes pour lutter contre les abus de la technologie deepfake. La législation actuelle est en cours de révision, avec des propositions visant à introduire des sanctions pour l’utilisation abusive de l’IA dans les cas de harcèlement, de chantage et d’intimidation, en s’appuyant sur les lois existantes en matière de cyberharcèlement et de cybertraque et en étendant des protections similaires aux préjudices résultant de contenus générés par l’IA. Les responsables soulignent que si l’adoption de l’IA est une priorité nationale, des garanties solides contre les utilisations abusives sont essentielles pour protéger les individus et les droits numériques.

Chine. L’autorité chinoise de régulation du cyberespace a proposé de nouvelles restrictions concernant les chatbots « petits amis » et « petites amies » basés sur l’IA. Le projet de réglementation exige que les plateformes interviennent lorsque les utilisateurs expriment des tendances suicidaires ou autodestructrices lors de leurs interactions avec des services d’IA émotionnellement interactifs, tout en renforçant la protection des mineurs et en limitant les contenus préjudiciables. L’autorité de régulation définit ces services comme des systèmes d’IA qui simulent des traits de personnalité humains et des interactions émotionnelles.

Note aux lecteurs : nous avons rendu compte séparément de la réaction négative suscitée en janvier 2026 par Grok, à la suite d’allégations selon lesquelles il aurait été utilisé pour générer des images sexualisées et deepfake non consensuelles.

Sécurité

L’ONU. L’ONU a tiré la sonnette d’alarme concernant les menaces que représente l’IA pour la sécurité des enfants, soulignant que les systèmes d’IA peuvent accélérer la création, la distribution et l’impact de contenus préjudiciables, notamment l’exploitation sexuelle, les abus et la manipulation des enfants en ligne. Alors que les jouets intelligents, les chatbots et les moteurs de recommandation façonnent de plus en plus les expériences numériques des jeunes, l’absence de garanties adéquates risque d’exposer toute une génération à de nouvelles formes d’exploitation et de préjudice.

Experts internationaux. Le deuxième rapport international sur la sécurité de l’IA constate que les capacités de l’IA continuent de progresser rapidement, les principaux systèmes surpassant les experts humains dans des domaines tels que les mathématiques, les sciences et certaines tâches logicielles autonomes, tandis que les performances restent inégales. L’adoption est rapide mais inégale à l’échelle mondiale. Les préjudices croissants comprennent les deepfakes, l’utilisation abusive dans le cadre de fraudes et de contenus non consensuels, ainsi que les impacts systémiques sur l’autonomie et la confiance. Les mesures de protection techniques et les cadres de sécurité volontaires se sont améliorés, mais restent incomplets, et une gestion efficace des risques à plusieurs niveaux fait toujours défaut.

L’UE et les États-Unis. L’Agence européenne des médicaments (EMA) et la Food and Drug Administration (FDA) américaine ont publié dix principes de bonnes pratiques en matière d’IA dans le cycle de vie des médicaments. Ces lignes directrices fournissent des orientations générales pour l’utilisation de l’IA dans la recherche, les essais cliniques, la fabrication et la surveillance de la sécurité. Ces principes concernent les développeurs de produits pharmaceutiques, les demandeurs d’autorisation de mise sur le marché et les titulaires d’autorisations, et serviront de base aux futures orientations en matière d’IA dans différentes juridictions.

De la révision au recalibrage : ce que les résultats du SMSI+20 signifient pour la gouvernance numérique mondiale

L’examen du SMSI+20, mené 20 ans après le Sommet mondial sur la société de l’information, s’est achevé en décembre 2025 à New York avec l’adoption d’un document final de haut niveau par l’Assemblée générale des Nations unies. Cet examen évalue les progrès accomplis dans la construction d’une société de l’information centrée sur l’humain, inclusive et axée sur le développement, met en évidence les domaines nécessitant des efforts supplémentaires et décrit les mesures visant à renforcer la coopération internationale.

Une décision institutionnelle majeure a été prise : faire du Forum sur la gouvernance de l’Internet (FGI) un organe permanent des Nations unies. Le résultat comprend également des mesures visant à renforcer son fonctionnement : élargir la participation, en particulier celle des pays en développement et des communautés sous-représentées, améliorer les travaux intersessions, soutenir les initiatives nationales et régionales et adopter des méthodes de collaboration innovantes et transparentes. Le secrétariat du FGI doit être renforcé, un financement durable assuré et des rapports annuels sur les progrès réalisés fournis aux organes des Nations unies, notamment à la Commission de la science et de la technologie au service du développement (CSTD).

Les négociations ont porté sur la création d’un segment gouvernemental au sein du FGI. Si certains États membres ont soutenu cette idée comme un moyen de favoriser le dialogue entre les gouvernements, d’autres ont craint qu’elle ne compromette la nature multipartite du FGI. Le compromis final encourage le dialogue entre les gouvernements avec la participation de toutes les parties prenantes.

Au-delà du FGI, le résultat confirme la poursuite du Forum annuel du SMSI et invite le Groupe des Nations unies sur la société de l’information (UNGIS) à accroître son efficacité, sa souplesse et le nombre de ses membres.

Les facilitateurs des lignes d’action du SMSI sont chargés d’élaborer des feuilles de route ciblées reliant les lignes d’action du SMSI aux ODD et aux engagements du Pacte numérique mondial (PMN).

Le Groupe d’experts intergouvernemental sur le SMSI (UNGIS) est chargé d’élaborer une feuille de route commune pour renforcer la cohérence entre le SMSI et le Pacte numérique mondial, qui sera présentée à la CSTD en 2026. Le Secrétaire général soumettra des rapports biennaux sur la mise en œuvre du SMSI, et le prochain examen de haut niveau est prévu pour 2035.

Le document place la réduction de la fracture numérique au cœur du programme du SMSI+20. Il aborde de multiples aspects de l’exclusion numérique, notamment l’accessibilité, l’abordabilité, la qualité de la connectivité, l’inclusion des groupes vulnérables, le multilinguisme, la diversité culturelle et la connexion de toutes les écoles à l’Internet. Il souligne que la connectivité seule est insuffisante, mettant en avant l’importance du développement des compétences, de la mise en place d’environnements politiques favorables et de la protection des droits de l’Homme.

Le résultat met également l’accent sur un développement numérique ouvert, équitable et non discriminatoire, notamment des politiques prévisibles et transparentes, des cadres juridiques et le transfert de technologies vers les pays en développement. La durabilité environnementale est mise en avant, avec des engagements à tirer parti des technologies numériques tout en abordant les questions de la consommation d’énergie, des déchets électroniques, des minéraux critiques et des normes internationales pour des produits numériques durables.

Les droits de l’Homme et les considérations éthiques sont réaffirmés comme fondamentaux. Le document souligne que les droits en ligne reflètent ceux hors ligne, appelle à la mise en place de garanties contre les effets négatifs des technologies numériques et exhorte le secteur privé à respecter les droits de l’homme tout au long du cycle de vie des technologies. Il aborde les préjudices en ligne tels que la violence, les discours haineux, la désinformation, le cyberharcèlement et l’exploitation sexuelle des enfants, tout en promouvant la liberté des médias, la vie privée et la liberté d’expression.

Le renforcement des capacités et le financement sont reconnus comme essentiels. Le document souligne la nécessité de renforcer les compétences numériques, l’expertise technique et les capacités institutionnelles, y compris dans le domaine de l’IA. Il invite l’Union internationale des télécommunications à créer un groupe de travail interne chargé d’évaluer les lacunes et les défis des mécanismes financiers pour le développement numérique et de présenter ses recommandations à la CSTD d’ici 2027. Il invite également le Groupe de travail interinstitutions des Nations unies sur l’IA à recenser les initiatives existantes en matière de renforcement des capacités, à identifier les lacunes et à élaborer des programmes tels qu’une bourse de renforcement des capacités en matière d’IA pour les fonctionnaires et les programmes de recherche.

Enfin, le document final souligne l’importance du suivi et de la mesure, demandant un examen systématique des indicateurs et méthodologies existants en matière de TIC par le Partenariat sur la mesure des TIC au service du développement, en coopération avec les facilitateurs des lignes d’action et la Commission statistique des Nations unies. Le Partenariat est chargé de faire rapport à la CSTD en 2027. Dans l’ensemble, la CSTD, l’ECOSOC et l’Assemblée générale continuent de jouer un rôle central dans le suivi et l’examen du SMSI.

Le texte final reflète un large compromis et a été adopté sans vote, bien que certains États membres et groupes aient exprimé des préoccupations concernant certaines dispositions.

Diplo et la Geneva Internet Platform (GIP) ont fourni des rapports en temps réel sur les deux jours d’examen de haut niveau du SMSI lors de la réunion de l’Assemblée générale des Nations unies (AGNU) les 16 et 17 décembre 2025. Notre page web dédiée contient les rapports des sessions, les listes des intervenants, des graphiques de connaissances, des analyses approfondies et les principales conclusions de cet événement historique.

Sécurité des enfants en ligne : interdictions et procès

La dynamique des interdictions des réseaux sociaux pour les enfants

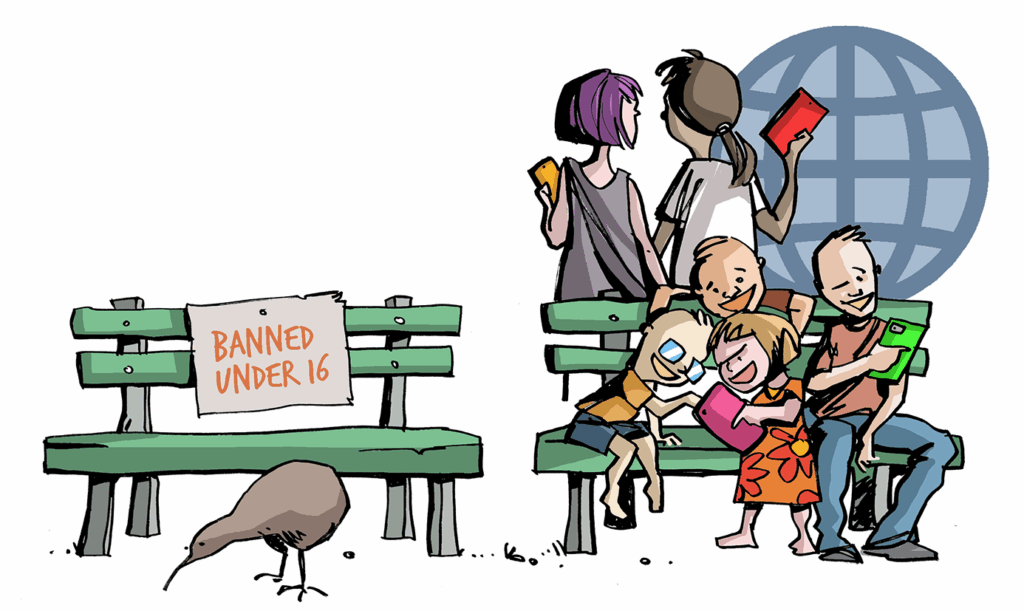

L’Australie est entrée dans l’histoire en décembre en commençant à appliquer ses restrictions historiques sur les réseaux sociaux pour les moins de 16 ans, les premières règles nationales de ce type au monde.

Cette mesure, qui consiste en une nouvelle exigence relative à l’âge minimum pour utiliser les réseaux sociaux (SMMA) dans le cadre de la loi sur la sécurité en ligne, oblige les principales plateformes à prendre des « mesures raisonnables » pour supprimer les comptes des mineurs et bloquer les nouvelles inscriptions, sous peine d’amendes de 49,5 millions de dollars australiens et de rapports mensuels de conformité.

Dès l’entrée en vigueur de cette mesure, la commissaire à la sécurité électronique, Julie Inman Grant, a exhorté les familles, en particulier celles vivant dans les régions rurales et isolées d’Australie, à consulter le nouveau guide publié, qui explique le fonctionnement de la limite d’âge, les raisons pour lesquelles elle a été relevée de 13 à 16 ans et la manière d’accompagner les jeunes pendant cette transition.

Le nouveau cadre ne doit pas être considéré comme une interdiction, mais comme un report, a souligné Mme Grant, qui a relevé l’âge minimum pour créer un compte de 13 à 16 ans afin de créer « un répit face aux fonctionnalités puissantes et persuasives conçues pour les rendre accros et qui permettent souvent des contenus et des comportements nuisibles ».

Cela fait près de deux mois que l’interdiction, nous continuons à utiliser le mot « interdiction » dans le texte, car il fait déjà partie du langage courant, est entrée en vigueur. Voici ce qui s’est passé entre-temps.

Réactions des adolescents. Le changement a été brutal pour les jeunes Australiens. À la veille de la date limite, les adolescents ont publié des messages d’adieu, déplorant la perte des communautés, des espaces créatifs et des réseaux de pairs qui ancraient leur vie quotidienne. Les défenseurs de la jeunesse ont fait remarquer que ceux qui dépendent des plateformes pour leur éducation, leurs réseaux de soutien, leurs espaces communautaires LGBTQ+ ou leur expression créative seraient touchés de manière disproportionnée.

Solutions de contournement et leurs limites. Comme on pouvait s’y attendre, des solutions de contournement ont immédiatement vu le jour. Certains adolescents ont tenté (et réussi) de tromper les outils d’estimation de l’âge du visage en déformant leurs expressions ; d’autres se sont tournés vers les VPN pour masquer leur emplacement. Cependant, les experts soulignent que les VPN gratuits monétisent souvent les données des utilisateurs ou contiennent des logiciels espions, ce qui soulève de nouveaux risques. Et cela pourrait être vain : les plateformes conservent un ensemble complet de signaux qu’elles peuvent utiliser pour déduire la véritable localisation et l’âge d’un utilisateur, notamment les adresses IP, les données GPS, les identifiants des appareils, les paramètres de fuseau horaire, les numéros de téléphone portable, les informations sur les boutiques d’applications et les modèles de comportement. Les marqueurs liés à l’âge, tels que l’analyse linguistique, les modèles d’activité pendant les heures scolaires, l’estimation de l’âge du visage ou de la voix, les interactions axées sur les jeunes et l’âge d’un compte, fournissent aux entreprises des outils supplémentaires pour identifier les utilisateurs mineurs.

Préoccupations en matière de confidentialité et d’efficacité. Les détracteurs affirment que cette politique soulève de sérieuses préoccupations en matière de confidentialité, car les systèmes de vérification de l’âge, qu’ils soient basés sur le téléchargement de pièces d’identité officielles, la biométrie ou des évaluations basées sur l’IA, obligent les gens à communiquer des données sensibles qui pourraient être utilisées à mauvais escient, violées ou normalisées dans le cadre de la surveillance quotidienne. D’autres soulignent que la technologie de reconnaissance faciale est la moins fiable pour les adolescents, le groupe même qu’elle est censée réglementer. Certains se demandent si les amendes ont un sens, étant donné que Meta gagne environ 50 millions de dollars australiens en moins de deux heures.

La portée limitée des règles a suscité un examen plus approfondi. Les sites de rencontre, les plateformes de jeux et les chatbots basés sur l’IA ne sont pas concernés par l’interdiction, même si certains chatbots ont été associés à des interactions préjudiciables avec des mineurs. Les éducateurs et les défenseurs des droits des enfants affirment que la culture numérique et la résilience protégeraient mieux les jeunes que la suppression pure et simple de l’accès. De nombreux adolescents déclarent qu’ils créeront de faux profils ou partageront des comptes communs avec leurs parents, ce qui soulève des doutes quant à l’efficacité à long terme de cette mesure.

Réaction de l’industrie. La plupart des grandes plateformes ont publiquement critiqué l’élaboration et le contenu de la loi. Elles affirment que la loi sera extrêmement difficile à appliquer, même si elles se préparent à s’y conformer pour éviter des amendes. Le groupe industriel NetChoice a qualifié cette mesure de « censure généralisée », tandis que Meta et Snap affirment que le véritable pouvoir d’application appartient à Apple et Google, grâce aux contrôles d’âge dans les boutiques d’applications, plutôt qu’aux plateformes.

Reddit a déposé un recours devant la Haute Cour contre cette interdiction, citant en justice le Commonwealth d’Australie et la ministre des Communications Anika Wells, et affirmant que la loi est appliquée de manière inexacte à Reddit. La plateforme soutient qu’il s’agit d’une plateforme destinée aux adultes et qu’elle ne dispose pas des fonctionnalités traditionnelles des réseaux sociaux qui posent problème au gouvernement.

Position du gouvernement. Le gouvernement, qui s’attend à une mise en œuvre mouvementée, présente cette mesure comme étant conforme à d’autres restrictions liées à l’âge (telles que l’interdiction de consommer de l’alcool avant 18 ans) et comme une réponse aux préoccupations persistantes du public concernant les dangers d’Internet. Les responsables affirment que l’Australie joue un rôle pionnier en matière de sécurité des jeunes en ligne, une position qui suscite un intérêt international considérable.

Intérêt international. Cette évolution a suscité un intérêt considérable au niveau international. De plus en plus de pays cherchent à interdire l’accès des mineurs aux principales plateformes.

- Le Parlement européen a proposé de fixer l’âge minimum pour accéder aux réseaux sociaux à 16 ans, avec l’autorisation parentale pour les utilisateurs âgés de 13 à 15 ans, et étudie actuellement la possibilité de limiter les fonctionnalités addictives telles que la lecture automatique et le défilement infini.

- L’Assemblée nationale française a fait avancer une législation visant à interdire aux enfants de moins de 15 ans d’accéder aux réseaux sociaux, en votant largement en faveur d’un projet de loi qui obligerait les plateformes à bloquer les moins de 15 ans et à appliquer des mesures de vérification de l’âge. Le projet de loi doit maintenant être soumis au Sénat pour approbation, avec une mise en œuvre prévue avant la prochaine année scolaire. L’autorité de surveillance de la santé du pays a mis en avant des recherches soulignant une série d’effets négatifs avérés de l’utilisation des réseaux sociaux sur la santé mentale des adolescents, notant que les plateformes en ligne amplifient les pressions néfastes, le cyberharcèlement et les normes de beauté irréalistes.

- La Chambre des lords britannique a voté en faveur d’un amendement au projet de loi sur le bien-être des enfants et les écoles qui interdirait aux enfants de moins de 16 ans d’accéder aux réseaux sociaux.

- L’Autriche envisage d’interdire aux enfants de moins de 14 ans d’utiliser les réseaux sociaux.

- Le Danemark et la Norvège envisagent de relever l’âge minimum pour accéder aux réseaux sociaux à 15 ans, le Danemark pouvant interdire purement et simplement l’accès aux moins de 15 ans et la Norvège proposant une vérification plus stricte de l’âge et une protection plus rigoureuse des données.

- La coalition au pouvoir en Pologne est en train de rédiger une loi qui interdirait l’utilisation des réseaux sociaux aux enfants de moins de 15 ans.

- L’Espagne envisage d’interdire les réseaux sociaux aux moins de 16 ans. Selon le président espagnol, le gouvernement va également rédiger un projet de loi visant à tenir les dirigeants des réseaux sociaux personnellement responsables des discours haineux tenus sur leurs plateformes.

- La Malaisie prévoit d’interdire les comptes sur les réseaux sociaux aux moins de 16 ans à partir de 2026.

- La Haute Cour de Madras, en Inde, a exhorté le gouvernement fédéral du pays à envisager une interdiction similaire à celle en vigueur en Australie. Les gouvernements des États de Goa et d’Andhra Pradesh étudient des restrictions similaires, envisageant des propositions visant à interdire l’utilisation des réseaux sociaux aux enfants de moins de 16 ans, dans un contexte de préoccupations croissantes concernant la sécurité en ligne et le bien-être des jeunes.

- En Nouvelle-Zélande, le débat politique a envisagé des restrictions pour les mineurs, mais aucune politique officielle n’a été adoptée.

- Selon la ministre australienne des Communications, Anika Wells, des responsables de l’UE, des Fidji, de la Grèce et de Malte ont sollicité l’aide de l’Australie, considérant la mise en place de la SMMA comme un modèle potentiel. Des informations récentes suggèrent que la Grèce prévoit d’interdire l’utilisation des réseaux sociaux aux enfants de moins de 15 ans.

Toutes ces juridictions observent désormais attentivement l’Australie, à l’affût d’une preuve de concept… ou d’un échec.

Les premiers résultats sont là. En termes d’application de la loi (conformité des plateformes et suppression de comptes), la loi fonctionne, les entreprises de réseaux sociaux ayant désactivé ou restreint environ 4,7 millions de comptes appartenant à des utilisateurs australiens de moins de 16 ans au cours du premier mois d’application.

Toutefois, en ce qui concerne les résultats comportementaux (à savoir si les moins de 16 ans sont réellement déconnectés, plus en sécurité ou ont remplacé leurs habitudes néfastes par des habitudes plus saines), les preuves restent peu concluantes et évoluent. Le gouvernement australien a également déclaré qu’il était trop tôt pour déclarer que l’interdiction était un succès incontestable.

La question reste en suspens. Les jeunes continuent d’avoir accès aux outils de messagerie de groupe, aux services de jeux et aux applications de vidéoconférence en attendant de pouvoir créer un compte complet sur les réseaux sociaux. Mais la question demeure : si l’accès à une grande partie de l’écosystème numérique reste ouvert, quel est l’intérêt pratique de cloisonner un seul segment d’Internet ?

Les plateformes devant les tribunaux

En janvier 2026, un procès historique s’est ouvert à Los Angeles, opposant K.G.M., un plaignant âgé de 19 ans, à de grandes entreprises de réseaux sociaux. L’affaire, initialement déposée en juillet 2023, accuse des plateformes telles que Meta (Instagram et Facebook), YouTube (Google/Alphabet), Snapchat et TikTok d’avoir intentionnellement conçu leurs applications pour qu’elles créent une dépendance, avec de graves conséquences pour la santé mentale des jeunes utilisateurs.

Selon la plainte, des fonctionnalités telles que le défilement infini, les recommandations algorithmiques et les notifications constantes ont contribué à une utilisation compulsive, à l’exposition à des contenus préjudiciables, à la dépression, à l’anxiété et même à des pensées suicidaires. Le procès allègue également que les plateformes ont rendu difficile pour K.G.M. d’éviter tout contact avec des inconnus et des adultes prédateurs, malgré les restrictions parentales. L’équipe juridique de K.G.M. soutient que les entreprises ont sciemment optimisé leurs plateformes afin de maximiser l’engagement au détriment du bien-être des utilisateurs.

Au début du procès, Snap Inc. et TikTok avaient déjà conclu des accords confidentiels, laissant Meta et YouTube comme seuls défendeurs. Meta et YouTube nient avoir causé intentionnellement un préjudice, mettant en avant les fonctionnalités de sécurité existantes, les contrôles parentaux et les filtres de contenu.

Par ailleurs, devant un tribunal fédéral, Meta, Snap, YouTube et TikTok ont demandé à un juge de rejeter les poursuites judiciaires intentées par des districts scolaires qui réclament des dommages-intérêts pour les coûts liés aux problèmes de santé mentale des élèves.

Dans les deux cas, les entreprises font valoir que l’article 230 de la loi américaine les protège de toute responsabilité, tandis que les plaignants rétorquent que leurs revendications portent sur des fonctionnalités prétendument addictives plutôt que sur le contenu généré par les utilisateurs.

Les experts juridiques et les défenseurs suivent de près l’affaire, soulignant que son issue pourrait créer un précédent pour des milliers de poursuites judiciaires similaires et, à terme, influencer les pratiques de conception des entreprises.

Des octets aux frontières : la quête de la souveraineté numérique

Les gouvernements débattent depuis longtemps du contrôle des données, des infrastructures et des technologies à l’intérieur de leurs frontières. Mais un sentiment d’urgence renouvelé se fait sentir, car les tensions géopolitiques poussent à identifier les dépendances, à renforcer les capacités nationales et à limiter l’exposition aux technologies étrangères.

Au niveau européen, la France fait pression pour que la souveraineté numérique soit mesurable et applicable. Paris a proposé la création d’un Observatoire européen de la souveraineté numérique afin de cartographier la dépendance des États membres à l’égard des technologies non européennes, des services cloud et des systèmes d’IA aux outils de cybersécurité. Associée à un indice de résilience numérique, cette initiative vise à donner aux décideurs politiques une image plus claire des dépendances stratégiques et une base plus solide pour une action coordonnée en matière d’approvisionnement, d’investissement et de politique industrielle.

Le bloc a toutefois déjà commencé à travailler sur la souveraineté numérique. En janvier dernier, le Parlement européen a adopté une résolution sur la souveraineté technologique européenne et les infrastructures numériques. Dans ce texte, le Parlement appelle à la mise en place d’une infrastructure publique numérique européenne (IPN) robuste, fondée sur des normes ouvertes, l’interopérabilité, la confidentialité et la sécurité dès la conception, ainsi qu’une gouvernance favorable à la concurrence. Les domaines prioritaires comprennent les semi-conducteurs et les puces d’IA, l’informatique haute performance et quantique, les infrastructures cloud et edge, les giga-usines d’IA, les centres de données, les systèmes d’identité et de paiement numériques, ainsi que les plateformes de données d’intérêt public.

La législation sur les réseaux numériques, qui définit la souveraineté comme la capacité de l’UE à contrôler, sécuriser et adapter ses infrastructures de connectivité critiques plutôt que comme un isolement par rapport aux marchés mondiaux, a également été récemment adoptée. Des réseaux numériques sûrs et de haute qualité sont présentés comme un élément fondamental de la transformation numérique, de la compétitivité et de la sécurité de l’Europe, la fragmentation des marchés nationaux étant considérée comme un obstacle à la capacité de l’Union à agir collectivement et à réduire ses dépendances. La connectivité par satellite est explicitement identifiée comme un pilier essentiel de l’autonomie stratégique de l’UE, indispensable pour l’accès au haut débit dans les zones reculées et pour la sécurité, la gestion des crises, la défense et d’autres applications critiques, ce qui incite à s’orienter vers une autorisation harmonisée au niveau de l’UE afin de renforcer la résilience et d’éviter la dépendance vis-à-vis des fournisseurs étrangers.

L’ADN complète le soutien de l’UE à la constellation de satellites IRIS2, une constellation multi-orbite prévue de 290 satellites conçue pour fournir des communications cryptées aux citoyens, aux gouvernements et aux organismes publics et réduire la dépendance de l’UE vis-à-vis des fournisseurs externes. À la mi-janvier, le calendrier de l’IRIS2 a été modifié, selon le commissaire européen chargé de la défense et de l’espace, Andrius Kubilius.

L’UE a également avancé son calendrier pour le réseau satellitaire IRIS2, selon le commissaire européen chargé de la défense et de l’espace, Andrius Kubilius. IRIS2, une constellation multi-orbite prévue de 290 satellites, vise à lancer ses premiers services de communication gouvernementaux d’ici 2029, soit un an plus tôt que prévu initialement. Le réseau est conçu pour fournir des communications cryptées aux citoyens, aux gouvernements et aux organismes publics. Il vise également à réduire la dépendance vis-à-vis des fournisseurs externes, car l’Europe est « assez dépendante des services américains », selon M. Kubilius.

La Commission est également prête à investir dans cet objectif : elle a annoncé un financement de 307,3 millions d’euros pour renforcer les capacités en matière d’IA, de robotique, de photonique et d’autres technologies émergentes. Une part importante de cet investissement est liée à des initiatives telles que l’Open Internet Stack, qui visent à renforcer l’autonomie numérique européenne. Ce financement, ouvert aux entreprises, aux universités et aux organismes publics, reflète une volonté plus large de traduire les ambitions politiques en capacités technologiques concrètes.

D’autres mesures sont en préparation. La loi sur le développement du cloud et de l’IA, une révision de la loi sur les puces électroniques et de la loi sur le quantique, toutes prévues pour 2026, renforceront également la souveraineté numérique de l’UE, améliorant ainsi l’autonomie stratégique dans l’ensemble de la pile numérique.

En outre, la Commission européenne prépare une stratégie visant à commercialiser les logiciels open source européens, parallèlement à la loi sur le développement du cloud et de l’IA, afin de renforcer les communautés de développeurs, de soutenir l’adoption dans divers secteurs et de garantir la compétitivité du marché. En apportant un soutien stable et en favorisant la collaboration entre les pouvoirs publics et l’industrie, cette stratégie vise à créer un écosystème open source économiquement durable.

Au Burkina Faso, l’accent est mis sur la réduction de la dépendance vis-à-vis des fournisseurs externes tout en consolidant l’autorité nationale sur les systèmes numériques essentiels. Le gouvernement a lancé un centre de supervision des infrastructures numériques afin de centraliser la surveillance des réseaux nationaux et de renforcer le contrôle de la cybersécurité. De nouveaux mini-centres de données destinés à l’administration publique sont en cours de déploiement afin de garantir que les données sensibles de l’État soient stockées et gérées au niveau national.

Les débats sur la souveraineté se traduisent également par des décisions visant à limiter, remplacer ou restructurer l’utilisation des services numériques fournis par des entités étrangères. La France a annoncé son intention de supprimer progressivement les plateformes de collaboration basées aux États-Unis, telles que Microsoft Teams, Zoom, Google Meet et Webex, de l’administration publique, pour les remplacer par une alternative développée au niveau national, « Visio ».

L’autorité néerlandaise chargée de la protection des données a exhorté le gouvernement à agir rapidement pour protéger la souveraineté numérique du pays, après que DigiD, le système national d’identité numérique, semblait sur le point d’être racheté par une entreprise américaine. L’organisme de surveillance a fait valoir que les Pays-Bas dépendent fortement d’un petit groupe de fournisseurs de services informatiques et de cloud computing non européens, et souligne que les organismes publics ne disposent pas de stratégies de sortie claires en cas de changement soudain de propriété étrangère.

Aux États-Unis, la controverse autour de TikTok peut également être considérée sous l’angle de la souveraineté : plutôt que d’interdire TikTok, les autorités ont poussé la plateforme à restructurer ses activités pour le marché américain. Une nouvelle entité gérera les activités de TikTok aux États-Unis, les données des utilisateurs et les algorithmes étant traités à l’intérieur des États-Unis. L’algorithme de recommandation est censé être entraîné uniquement sur les données des utilisateurs américains afin de répondre aux exigences réglementaires américaines.

Dans des contextes davantage axés sur la sécurité, le concept est encore plus précis. L’Europe restant fortement dépendante des fournisseurs de télécommunications chinois et des fournisseurs de cloud et de satellites américains, la Commission européenne a proposé des règles contraignantes en matière de cybersécurité visant les chaînes d’approvisionnement critiques des TIC.

Le Conseil de sécurité russe a récemment qualifié des services tels que Starlink et Gmail de menaces pour la sécurité nationale, les décrivant comme des outils d’« influence destructive sur le plan informationnel et technique ». Ces évaluations devraient alimenter la doctrine russe en matière de sécurité de l’information, renforçant ainsi le traitement des services numériques fournis par des entreprises étrangères non pas comme des infrastructures neutres, mais comme des vecteurs potentiels de risque géopolitique.Vue d’ensemble. Le fil conducteur est clair : la souveraineté numérique est désormais une considération essentielle pour les gouvernements du monde entier. Les approches peuvent différer, mais l’objectif reste largement le même : garantir que l’avenir numérique d’une nation soit façonné par ses propres priorités et règles. Mais la véritable indépendance est entravée par des chaînes d’approvisionnement mondiales profondément ancrées, des coûts prohibitifs pour la mise en place de systèmes parallèles et le risque d’étouffer l’innovation par l’isolement. Si la volonté stratégique de souveraineté est claire, se détacher des écosystèmes technologiques interdépendants nécessitera des années d’investissement, de migration et d’adaptation. Les initiatives actuelles marquent le début d’une transition longue et difficile.

Le choc Grok : comment les deepfakes générés par l’IA ont déclenché des réactions dans le monde entier

En janvier 2026, une tempête réglementaire a frappé Grok, l’outil d’IA intégré à la plateforme X d’Elon Musk, lorsque des informations ont révélé que Grok était utilisé pour produire des images sexualisées et deepfakes non consensuelles, notamment des représentations de personnes dénudées ou dans des situations compromettantes sans leur consentement.

Musk a suggéré que les utilisateurs qui recourent à de telles incitations soient tenus pour responsables, une mesure critiquée comme un transfert de responsabilité.

La réaction a été rapide et sévère. L’Ofcom britannique a lancé une enquête en vertu de la loi sur la sécurité en ligne afin de déterminer si X s’était acquitté de son obligation de protéger les citoyens britanniques contre les contenus illégaux dans le pays. Le Premier ministre britannique Keir Starmer a condamné ces résultats « répugnants ». L’UE a déclaré que ce contenu, en particulier celui impliquant des enfants, « n’avait pas sa place en Europe ». L’Asie du Sud-Est a agi de manière décisive : la Malaisie et l’Indonésie ont entièrement bloqué Grok, invoquant la génération d’images obscènes, et les Philippines ont rapidement emboîté le pas pour des raisons de protection des enfants.

Sous pression, X a annoncé un renforcement des contrôles sur les capacités d’édition d’images de Grok. La plateforme a déclaré avoir mis en place des mesures de protection technologiques pour bloquer la génération et l’édition d’images à caractère sexuel de personnes réelles dans les juridictions où ce type de contenu est illégal.

Toutefois, les autorités réglementaires ont indiqué que cette mesure, bien que positive, ne mettrait pas fin à la surveillance.

Au Royaume-Uni, l’Ofcom a souligné que son enquête officielle sur la gestion de Grok par X et l’émergence d’images deepfake se poursuivrait, même s’il saluait les changements apportés à la politique de la plateforme. Le régulateur a souligné sa volonté de comprendre comment la plateforme a facilité la prolifération de ce type de contenu et de veiller à ce que des mesures correctives soient mises en œuvre.

Le Bureau du commissaire à l’information du Royaume-Uni (ICO) a ouvert une enquête officielle sur X et xAI afin de déterminer si le traitement des données personnelles par Grok est conforme à la législation britannique en matière de protection des données, à savoir les principes fondamentaux de protection des données (légalité, équité et transparence), et si sa conception et son déploiement comprenaient des protections intégrées suffisantes pour empêcher l’utilisation abusive des données personnelles à des fins de création d’images préjudiciables ou manipulées.

Le commissaire à la protection de la vie privée du Canada a élargi une enquête existante sur X Corp. et a ouvert une enquête parallèle sur xAI afin d’évaluer si les entreprises ont obtenu un consentement valide pour la collecte, l’utilisation et la divulgation de renseignements personnels afin de créer des deepfakes générés par l’IA, y compris du contenu sexuellement explicite.

En France, le parquet de Paris a confirmé qu’il allait élargir l’enquête pénale en cours sur X pour y inclure la complicité dans la diffusion d’images pornographiques de mineurs, de deepfakes sexuellement explicites, la négation de crimes contre l’humanité et la manipulation d’un système automatisé de traitement de données. La brigade cybercriminalité du parquet de Paris a perquisitionné les bureaux français de X dans le cadre de cette enquête élargie. Musk et l’ancienne PDG Linda Yaccarino ont été convoqués pour des entretiens volontaires. X a nié toute malversation et a qualifié la perquisition d’« acte abusif des forces de l’ordre », tandis que Musk l’a décrite comme une « attaque politique ».

La Commission européenne a ouvert une enquête officielle sur X en vertu de la loi sur les services numériques (DSA) de l’Union européenne. L’enquête vise à déterminer si l’entreprise a respecté ses obligations légales en matière d’atténuation des risques liés aux deepfakes à caractère sexuel générés par l’IA et autres images préjudiciables produites par Grok, en particulier celles pouvant impliquer des mineurs ou du contenu non consensuel.

Le ministère public fédéral brésilien, l’autorité nationale de protection des données et le secrétariat national à la consommation ont publié des recommandations coordonnées à l’intention de X afin qu’il empêche Grok de produire et de diffuser des deepfakes à caractère sexuel, avertissant que les règles brésiliennes en matière de responsabilité civile pourraient s’appliquer si les contenus préjudiciables continuaient d’être diffusés et que la plateforme devrait être désactivée jusqu’à la mise en place de mesures de protection.

En Inde, le ministère de l’Électronique et des Technologies de l’information (Meity) a exigé le retrait des contenus obscènes et illégaux générés par l’outil d’IA et a demandé un rapport sur les mesures correctives dans un délai de 72 heures. Le ministère a également ordonné à l’entreprise de revoir le cadre technique et de gouvernance de Grok. Le délai est désormais écoulé, et ni le ministère ni Grok n’ont rendu publique la moindre information à ce sujet.

Les autorités réglementaires sud-coréennes examinent actuellement si Grok a enfreint les normes de protection et de sécurité des données personnelles en permettant la production de deepfakes explicites, et si cette question relève de leur compétence juridique.

L’Indonésie, la Malaisie et les Philippines ont toutefois rétabli l’accès après que la plateforme ait mis en place des contrôles de sécurité supplémentaires visant à limiter la génération et la modification de contenus problématiques.

Les lignes rouges. La réaction a été si immédiate et généralisée précisément parce qu’elle a touché deux points sensibles plutôt universels : la violation profonde de la vie privée par des images sexuelles non consenties – une ligne morale que presque tout le monde s’accorde à dire qu’il ne faut pas franchir – combinée aux dangers uniques de l’IA, un déclencheur de sensibilité aiguë de la part des gouvernements.Vue d’ensemble. L’examen minutieux mené actuellement par Grok montre que tous les régulateurs ne sont pas satisfaits des mesures de protection mises en œuvre jusqu’à présent, soulignant que les solutions pourraient devoir être adaptées aux différentes juridictions.

11e édition des Geneva Engage Awards

Diplo et la Geneva Internet Platform (GIP) ont organisé la 11e édition des Geneva Engage Awards, qui récompensent les efforts des acteurs internationaux de Genève en matière de communication numérique et d’engagement en ligne.

Le thème de cette année, « Back to Basics : The Future of Websites in the AI Era » (Retour aux sources : l’avenir des sites web à l’ère de l’IA), a mis en évidence les nouvelles pratiques dans lesquelles les utilisateurs s’appuient de plus en plus sur des assistants IA et des résumés générés par l’IA qui peuvent ne pas citer les sources primaires ou les plus pertinentes.

La première partie de l’événement a planté le décor d’un environnement numérique en mutation, explorant la transition d’un web basé sur la recherche vers un web axé sur les réponses et ses implications pour l’engagement du public. Elle a également offert un aperçu bref et transparent de la logique qui sous-tend le classement des prix de cette année, en dévoilant les indicateurs et les modèles mathématiques utilisés pour évaluer la présence numérique et l’accessibilité. Cela a conduit à la remise des prix, qui a récompensé les acteurs basés à Genève pour leur engagement et leur influence en ligne.

Les prix ont été décernés à des organisations dans trois catégories principales : les organisations internationales, les ONG et les représentations permanentes. Les prix ont évalué les efforts en matière d’engagement sur les réseaux sociaux, d’accessibilité du web et de leadership en matière d’IA, renforçant ainsi le rôle de Genève en tant que source fiable d’informations dans un contexte d’évolution rapide des technologies.

Dans la catégorie « Organisations internationales », la Conférence des Nations unies sur le commerce et le développement (CNUCED) a remporté la première place. L’Office des Nations unies à Genève (ONUG) et le Bureau de la coordination des affaires humanitaires des Nations unies (OCHA) ont été classés deuxièmes pour leur forte présence numérique et leur rayonnement.

Parmi les organisations non gouvernementales, l’International AIDS Society s’est classée première. Elle est suivie par l’Aga Khan Development Network (AKDN) et l’Union internationale pour la conservation de la nature (UICN), toutes deux reconnues comme finalistes pour leur engagement numérique efficace.

Dans la catégorie des représentations permanentes, la Mission permanente de la République d’Indonésie auprès de l’Office des Nations Unies et des autres organisations internationales à Genève a remporté la première place. La Mission permanente de la République du Rwanda et la Mission permanente de la France ont été classées deuxièmes.

Le prix de l’accessibilité du Web a été décerné à la Mission permanente du Canada, tandis que le prix du leadership en matière d’IA à Genève a été remis à l’Union internationale des télécommunications (UIT).

Des mentions honorables ont été décernées au Forum économique mondial (WEF), à la délégation permanente de l’Union européenne auprès de l’Office des Nations Unies à Genève, à l’Organisation mondiale de la santé (OMS) et au Haut-Commissariat des Nations Unies pour les réfugiés (HCR).