Rétrospective de novembre 2025

Le numéro de ce mois-ci vous emmène de Washington à Genève, de la COP 30 aux négociations du SMSI+20, retraçant les développements majeurs qui redéfinissent la politique en matière d’IA, de la sécurité en ligne et de la résilience de l’infrastructure numérique dont nous dépendons quotidiennement.

Voici ce que nous vous proposons dans cette édition.

La bulle de l’IA est-elle sur le point d’éclater ? La bulle de l’IA va-t-elle éclater ? L’IA est-elle désormais « trop importante pour faire faillite » ? Le gouvernement américain va-t-il renflouer les géants de l’IA, et quelles seraient les conséquences pour l’économie mondiale ?

La lutte mondiale pour réguler l’IA – Les gouvernements s’empressent de définir des règles, qu’il s’agisse de stratégies nationales en matière d’IA ou de nouveaux cadres mondiaux. Nous présentons les dernières initiatives.

Points forts du SMSI+20 Rev 1 — Un aperçu du document qui guide actuellement les négociations entre les États membres de l’ONU avant la réunion de haut niveau de l’Assemblée générale les 16 et 17 décembre 2025.

Quand le numérique rencontre le climat — Ce dont les États membres de l’ONU ont discuté en matière d’IA et de numérique lors de la COP 30.

Sécurité des enfants en ligne — De l’Australie à l’UE, les gouvernements mettent en place de nouvelles mesures de protection pour préserver les enfants des dangers d’Internet. Nous examinons leurs approches.

Panne numérique — La panne de Cloudflare a révélé la fragilité des dépendances au sein de l’Internet mondial. Nous analysons ses causes et ce que cet incident révèle sur la résilience numérique.

Le mois dernier à Genève — Retrouvez les discussions, les événements et les conclusions qui ont façonné la gouvernance numérique internationale.

Baromètre

GOUVERNANCE NUMÉRIQUE

La France et l’Allemagne ont organisé à Berlin un sommet sur la souveraineté numérique européenne afin d’accélérer l’indépendance numérique de l’Europe. Elles ont présenté une feuille de route comportant sept priorités : simplifier la réglementation (notamment en reportant certaines règles de la loi sur l’IA), garantir l’équité des marchés du cloud et du numérique, renforcer la souveraineté des données, faire progresser les biens communs numériques, développer les infrastructures publiques numériques open source, créer un groupe de travail sur la souveraineté numérique et stimuler l’innovation de pointe en matière d’IA. Plus de 12 milliards d’euros d’investissements privés ont été promis. Un développement majeur accompagnant le sommet a été le lancement du Réseau européen pour la résilience et la souveraineté technologiques (ETRS) afin de réduire la dépendance vis-à-vis des technologies étrangères (actuellement supérieure à 80 %) grâce à la collaboration d’experts, à la cartographie de la dépendance technologique et au soutien à l’élaboration de politiques fondées sur des données probantes.

TECHNOLOGIES

Le gouvernement néerlandais a suspendu son projet de rachat de Nexperia, un fabricant de puces basé aux Pays-Bas et détenu par la société chinoise Wingtech, à la suite de négociations positives avec les autorités chinoises. La Chine a également commencé à libérer ses stocks de puces afin d’atténuer la pénurie.

Baidu a présenté deux puces IA développées en interne, la M100 pour une inférence efficace sur des modèles mixtes d’experts (prévue début 2026) et la M300 pour l’entraînement de modèles multimodaux à des trillions de paramètres (2027). L’entreprise a également présenté des architectures en groupement (Tianchi256 au premier semestre 2026 ; Tianchi512 au second semestre 2026) pour mettre à l’échelle l’inférence via de grandes interconnexions. IBM a dévoilé deux puces quantiques : Nighthawk (120 qubits, 218 coupleurs accordables) et Quantum Connect (100 qubits, 100 coupleurs accordables). Tianchi512 au second semestre 2026) pour faire évoluer l’inférence via de grandes interconnexions.

IBM a présenté deux puces quantiques : Nighthawk (120 qubits, 218 coupleurs accordables) permettant des circuits environ 30 % plus complexes, et Loon, un banc d’essai tolérant aux pannes avec une connectivité à six voies et des coupleurs à longue portée.

INFRASTRUCTURE

Six États membres de l’UE — l’Autriche, la France, l’Allemagne, la Hongrie, l’Italie et la Slovénie — ont conjointement demandé que la loi sur les réseaux numériques (DNA) soit réexaminée, arguant que les éléments fondamentaux de la proposition — notamment la réglementation harmonisée de type télécom, les mécanismes de règlement des litiges relatifs aux frais de réseau et les règles plus larges en matière de fusion — devraient plutôt rester sous contrôle national.

CYBERSÉCURITÉ

Roblox mettra en place une estimation obligatoire de l’âge (à partir de décembre dans certains pays, puis à l’échelle mondiale en janvier) et segmentera les utilisateurs en tranches d’âge strictes afin de bloquer les discussions avec des adultes inconnus. Les moins de 13 ans resteront exclus des messages privés, sauf si leurs parents donnent leur accord.

Eurofiber a confirmé une violation de sa plateforme client ATE française et de son système de billetterie via un logiciel tiers, précisant que les services restaient opérationnels et que les données bancaires étaient sécurisées.

La FCC s’apprête à voter l’abrogation des règles de janvier prévues par la section 105 de la CALEA, qui obligeaient les principaux opérateurs à renforcer la sécurité de leurs réseaux contre les accès non autorisés et les interceptions, mesures adoptées après que la campagne de cyberespionnage Salt Typhoon ait révélé les vulnérabilités des télécommunications.

Le Royaume-Uni prévoit un projet de loi sur la cybersécurité et la résilience afin de renforcer les infrastructures nationales critiques et l’économie numérique en général contre les cybermenaces croissantes. Environ 1 000 fournisseurs de services essentiels (santé, énergie, informatique) seraient soumis à des normes renforcées, avec une extension potentielle à plus de 200 centres de données.

ÉCONOMIE

Les Émirats arabes unis ont réalisé leur première transaction gouvernementale à l’aide du dirham numérique, un projet pilote de monnaie numérique de banque centrale (CBDC) dans le cadre de son programme de transformation de l’infrastructure financière. De plus, la banque centrale des Émirats arabes unis a approuvé le Zand AED, la première monnaie stable réglementée et multi-chaînes adossée à l’AED, émise par la banque agréée Zand.

La Banque nationale tchèque a créé un portefeuille test d’actifs numériques d’une valeur de 1 million de dollars, comprenant des bitcoins, une monnaie stable en dollars américains et un dépôt sous forme de jetons, afin d’acquérir une expérience pratique en matière d’opérations, de sécurité et de lutte contre le blanchiment d’argent, sans intention d’investir activement.

La Roumanie a mené à bien son premier projet pilote en argent réel avec le portefeuille d’identité numérique de l’UE (EUDIW), en collaboration avec Banca Transilvania et BPC, permettant à un titulaire de carte d’authentifier un achat via le portefeuille plutôt que par SMS OTP ou lecteur de carte.

La Commission européenne a ouvert une enquête DMA afin de déterminer si Google Search pénalise injustement les éditeurs de presse via sa politique d’« abus de réputation de site », qui peut faire baisser le classement des médias hébergeant du contenu partenaire.

En termes de stratégies numériques, l’Agenda 2030 de la Commission européenne pour les consommateurs présente un plan visant à renforcer la protection, la confiance et la compétitivité tout en simplifiant la réglementation pour les entreprises.

Le Turkménistan a adopté sa première loi complète sur les actifs virtuels, qui entrera en vigueur le 1er janvier 2026, légalisant le minage de cryptomonnaies et autorisant les échanges sous réserve d’un enregistrement strict auprès de l’État.

DROITS DE L’HOMME

Le Conseil de l’UE a adopté de nouvelles mesures visant à accélérer le traitement des plaintes transfrontalières en matière de protection des données, avec des critères de recevabilité harmonisés et des droits procéduraux renforcés pour les citoyens et les entreprises. Un processus de coopération simplifié pour les cas simples permettra également de réduire les charges administratives et d’accélérer les résolutions.

L’Inde a commencé à mettre en œuvre sa loi de 2023 sur la protection des données personnelles numériques grâce à des règles nouvellement approuvées qui établissent les structures de gouvernance initiales, notamment un comité de protection des données, tout en accordant aux organisations un délai supplémentaire pour se conformer pleinement à leurs obligations.

JURIDIQUE

OpenAI s’oppose à une demande juridique restreinte du New York Times concernant 20 millions de conversations ChatGPT, dans le cadre du procès intenté par le Times pour utilisation abusive présumée de son contenu. OpenAI avertit que le partage de ces données pourrait exposer des informations sensibles et créer des précédents importants quant à la manière dont les plateformes d’IA traitent la confidentialité des utilisateurs, la conservation des données et la responsabilité juridique.

Un juge américain a autorisé la poursuite de l’action en justice engagée par l’Authors Guild contre OpenAI, rejetant le renvoi et admettant les allégations selon lesquelles les résumés de ChatGPT reproduisent illégalement le ton, l’intrigue et les personnages des auteurs.

L’autorité de régulation des médias irlandaise a ouvert sa première enquête DSA sur X, afin de déterminer si les utilisateurs disposent de voies de recours accessibles et de résultats clairs lorsque les demandes de suppression de contenu sont refusées.

Dans un revers pour la FTC, un juge américain a statué que Meta n’exerçait pas actuellement de pouvoir monopolistique dans le domaine des réseaux sociaux, rejetant ainsi une proposition qui aurait pu contraindre à la cession d’Instagram et de WhatsApp.

SOCIOCULTUREL

La Commission européenne a lancé le Culture Compass for Europe, un cadre visant à placer la culture au cœur de la politique de l’UE, à promouvoir l’identité et la diversité et à soutenir les secteurs créatifs.

Les régulateurs chinois du cyberespace ont lancé une campagne de répression contre les deepfakes utilisant l’IA pour usurper l’identité de personnalités publiques dans le cadre de ventes en direct, ordonnant le nettoyage des plateformes et la responsabilisation des spécialistes du marketing.

DÉVELOPPEMENT

Les ministres d’Afrique occidentale et centrale ont adopté la Déclaration de Cotonou afin d’accélérer la transformation numérique d’ici 2030, en visant la création d’un marché numérique africain unique, la généralisation du haut débit, la mise en place d’infrastructures numériques interopérables et l’harmonisation des règles en matière de cybersécurité, de gouvernance des données et d’intelligence artificielle. Cette initiative met l’accent sur le capital humain et l’innovation, avec pour objectif de doter 20 millions de personnes de compétences numériques, de créer deux millions d’emplois dans le secteur numérique et de stimuler le développement de l’intelligence artificielle et des infrastructures numériques régionales sous l’égide de l’Afrique.

Le rapport de l’UIT intitulé « Mesurer le développement numérique : faits et chiffres 2025 » révèle que, si la connectivité mondiale continue de se développer (avec près de 6 milliards de personnes connectées à Internet en 2025), 2,2 milliards de personnes restent encore hors ligne, principalement dans les pays à faible et moyen revenu. Des écarts importants persistent en matière de qualité de connexion, d’utilisation des données, d’accessibilité financière et de compétences numériques, ce qui empêche de nombreuses personnes de profiter pleinement du monde numérique.

La Suisse s’est officiellement associée à Horizon Europe, Digital Europe et Euratom R&T, accordant ainsi aux chercheurs suisses un statut équivalent à celui des chercheurs de l’UE pour diriger des projets et obtenir des financements dans tous les domaines à partir du 1er janvier 2025.

L’Ouzbékistan accorde désormais une validité juridique totale aux données personnelles sur le portail de services publics my.gov.uz, les assimilant à des documents papier (à compter du 1er novembre). Les citoyens peuvent accéder, partager et gérer leurs dossiers entièrement en ligne.

Ce mois-ci dans le domaine de l’IA et de la gouvernance des données

Australie. L’Australie a présenté un nouveau plan national pour l’intelligence artificielle (IA) visant à l’exploiter au service de la croissance économique, de l’inclusion sociale et de l’efficacité du secteur public, tout en mettant l’accent sur la sécurité, la confiance et l’équité dans son utilisation. Ce plan mobilise des investissements substantiels : des centaines de millions de dollars australiens sont consacrés à la recherche, aux infrastructures, au développement des compétences et à des programmes visant à aider les petites et moyennes entreprises à adopter l’IA. Le gouvernement prévoit également d’étendre l’accès à cette technologie à l’ensemble du pays.

Les mesures concrètes comprennent la création d’un centre national dédié à l’IA, le soutien à l’adoption de l’IA par les entreprises et les organisations à but non lucratif, l’amélioration des compétences numériques par le biais de formations dans les écoles et les communautés, et l’intégration de l’IA dans la prestation des services publics.

Afin de garantir une utilisation responsable, le gouvernement créera l’AI Safety Institute (AISI), un centre national chargé de consolider la recherche sur la sécurité de l’IA, de coordonner l’élaboration de normes et de conseiller le gouvernement et l’industrie sur les meilleures pratiques. L’institut évaluera la sécurité des modèles d’IA avancés, favorisera la résilience face aux abus ou aux accidents et servira de plaque tournante pour la coopération internationale en matière de gouvernance et de recherche dans le domaine de l’IA.

Le rapport met en évidence les atouts relatifs du Bangladesh : une infrastructure administrative en ligne en pleine expansion et une confiance généralement élevée du public dans les services numériques. Cependant, il dresse également un tableau franc des défis structurels : une connectivité inégale et un approvisionnement électrique peu fiable en dehors des grandes zones urbaines, une fracture numérique persistante (notamment entre les sexes et entre les zones urbaines et rurales), une capacité informatique haut de gamme limitée et une protection des données, une cybersécurité et des compétences liées à l’IA insuffisantes dans de nombreux secteurs de la société.

Dans le cadre de sa feuille de route, le pays prévoit de donner la priorité aux cadres de gouvernance, au renforcement des capacités et au déploiement inclusif, en veillant notamment à ce que l’IA soutienne les services publics dans les domaines de la santé, de l’éducation, de la justice et de la protection sociale.

Belgique. La Belgique rejoint un nombre grandissant de pays et d’organisations du secteur public qui ont restreint ou bloqué l’accès à DeepSeek en raison de craintes liées à la sécurité. Tous les fonctionnaires du gouvernement fédéral belge doivent cesser d’utiliser DeepSeek à compter du 1er décembre, et toutes les instances de DeepSeek doivent être supprimées des appareils officiels.

Cette décision fait suite à un avertissement du Centre pour la cybersécurité en Belgique, qui a identifié de graves risques liés à la protection des données associés à cet outil et a signalé que son utilisation posait problème pour le traitement d’informations gouvernementales sensibles.

Russie. Lors de la principale conférence russe sur l’IA (AI Journey), le président Vladimir Poutine a annoncé la création d’un groupe de travail national sur l’IA, le présentant comme essentiel pour réduire la dépendance vis-à-vis de l’IA étrangère. Le plan prévoit la construction de centres de données (alimentés même par des centrales nucléaires à petite échelle) et leur utilisation pour héberger des modèles d’IA générative qui protègent les intérêts nationaux. M. Poutine a également fait valoir que seuls des modèles développés au niveau national devraient être utilisés dans les secteurs sensibles, tels que la sécurité nationale, afin d’éviter toute fuite de données.

Singapour. Singapour vient de créer un espace de test mondial pour sécuriser l’intelligence artificielle. Les entreprises de tous pays peuvent désormais y mener des expérimentations concrètes afin de garantir le bon fonctionnement de leurs systèmes d’IA.

Ce dispositif est régi par 11 principes de gouvernance conformes aux normes internationales, notamment le cadre de gestion des risques liés à l’IA du NIST et la norme ISO/IEC 42001. Singapour espère ainsi combler le fossé entre les réglementations nationales fragmentées en matière d’IA et établir des références communes en matière de sécurité et de confiance.

L’UE. Une importante tempête politique se prépare au sein de l’UE. La Commission européenne a présenté ce qu’elle appelle l’Omnibus numérique, un ensemble de propositions visant à simplifier sa législation numérique. Cette initiative est saluée par certains comme nécessaire pour améliorer la compétitivité des acteurs numériques de l’UE, mais critiquée par d’autres en raison de ses implications potentiellement négatives dans des domaines tels que les droits numériques. Ce paquet comprend la proposition de règlement omnibus numérique Digital et la proposition de règlement omnibus numérique sur l’IA.

Dans un autre registre, mais toujours en lien avec ce sujet, la Commission européenne a lancé un outil de dénonciation de la législation sur l’IA, offrant ainsi aux citoyens de l’UE un canal sécurisé et confidentiel pour signaler toute violation présumée de la loi sur l’IA, y compris les déploiements d’IA dangereux ou à haut risque. Avec le lancement de cet outil, l’UE vise à combler les lacunes dans l’application de la loi européenne sur l’IA, à renforcer la responsabilité des développeurs et des déployeurs, et à promouvoir une culture d’utilisation responsable de l’IA dans tous les États membres.

Cet outil vise également à favoriser la transparence, en permettant aux régulateurs de réagir plus rapidement aux violations potentielles sans se fier uniquement aux audits ou aux inspections. Quels sont les développements notables au sein de l’UE ? La proposition de règlement omnibus numérique sur l’IA reporte la mise en œuvre des règles « à haut risque » prévues par la loi européenne sur l’IA jusqu’en 2027, accordant ainsi aux grandes entreprises technologiques un délai supplémentaire avant l’entrée en vigueur d’une surveillance plus stricte. L’entrée en vigueur des règles relatives à l’IA à haut risque sera désormais alignée sur la disponibilité des outils de soutien, ce qui donnera aux entreprises jusqu’à 16 mois pour se mettre en conformité. Les PME et les petites entreprises à moyenne capitalisation bénéficieront d’une documentation simplifiée, d’un accès plus large aux bacs à sable réglementaires et d’une surveillance centralisée des systèmes d’IA à usage général par le biais du Bureau de l’IA.

Les obligations de déclaration en matière de cybersécurité sont également simplifiées grâce à une interface unique pour les incidents relevant de plusieurs législations, tandis que les règles de confidentialité sont clarifiées afin de soutenir l’innovation sans affaiblir les protections prévues par le RGPD. Les règles relatives aux cookies seront modernisées afin de réduire les demandes de consentement répétitives et de permettre aux utilisateurs de gérer plus efficacement leurs préférences.

L’accès aux données sera amélioré grâce à la consolidation de la législation européenne en matière de données via la stratégie de l’Union des données, à des exemptions ciblées pour les petites entreprises et à de nouvelles orientations sur la conformité contractuelle. Ces mesures visent à débloquer des ensembles de données de haute qualité pour l’IA et à renforcer le potentiel d’innovation de l’Europe, tout en permettant aux entreprises d’économiser des milliards et en améliorant la clarté réglementaire.

La proposition de règlement omnibus numérique a des implications pour la protection des données dans l’UE. Les modifications proposées au règlement général sur la protection des données (RGPD) redéfiniraient la notion de données à caractère personnel, affaiblissant les garanties relatives à l’utilisation de ces données par les entreprises, en particulier pour la formation de l’IA. Parallèlement, le consentement aux cookies est simplifié en un modèle « en un clic » qui dure jusqu’à six mois.

Les groupes de défense de la vie privée et des droits civils ont exprimé leur inquiétude quant au fait que les modifications proposées au RGPD profitent de manière disproportionnée aux grandes entreprises technologiques. Une coalition de 127 organisations a publié un avertissement public indiquant que cela pourrait constituer « le plus grand recul des droits fondamentaux numériques dans l’histoire de l’UE ».

Ces propositions doivent passer par le processus colégislatif de l’UE : le Parlement et le Conseil vont les examiner, les amender et les négocier. Compte tenu de la controverse (soutien de l’industrie, opposition de la société civile), le résultat final pourrait être très différent de la proposition initiale de la Commission.

Le Royaume-Uni. Le gouvernement britannique a lancé une initiative majeure en matière d’intelligence artificielle afin de stimuler la croissance nationale dans ce domaine, combinant investissements dans les infrastructures, soutien aux entreprises et financement de la recherche. Le déploiement immédiat de 150 millions de livres sterling dans le Northamptonshire marque le coup d’envoi d’un programme de 18 milliards de livres sterling sur cinq ans visant à renforcer les capacités nationales en matière d’IA. Grâce à un engagement de marché avancé de 100 millions de livres sterling, l’État agira en tant que premier client des start-ups nationales spécialisées dans le matériel informatique dédié à l’IA, contribuant ainsi à réduire les risques liés à l’innovation et à stimuler la compétitivité.

Le plan comprend des zones de croissance de l’IA, avec un site phare dans le sud du Pays de Galles qui devrait créer plus de 5 000 emplois, et un accès élargi au calcul haute performance pour les universités, les start-ups et les organismes de recherche. Un volet dédié de 137 millions de livres sterling, intitulé « AI for Science » (l’IA au service de la science), permettra d’accélérer les percées dans les domaines de la découverte de médicaments, des énergies propres et des matériaux avancés, garantissant ainsi que l’IA stimule à la fois la croissance économique et la valeur publique.

Les Etats-Unis. L’ombre d’une politique restrictive en matière de réglementation plane sur les États-Unis. Les républicains alignés sur Trump ont une nouvelle fois insisté pour obtenir un moratoire sur la réglementation de l’IA au niveau des États. L’idée est d’empêcher les États d’adopter leurs propres lois sur l’IA, en arguant qu’un paysage réglementaire fragmenté entraverait l’innovation. Une version de la proposition lierait le financement fédéral du haut débit à la volonté des États de renoncer aux règles relatives à l’IA, pénalisant ainsi efficacement tout État qui tenterait de légiférer. Cependant, cette opposition ne fait pas l’unanimité : plus de 260 législateurs d’État de tous les États-Unis, républicains comme démocrates, ont dénoncé ce moratoire.

Le président a officiellement créé la Genesis Mission par décret le 24 novembre 2025, chargeant le département américain de l’Énergie (DOE) de diriger un effort national de recherche scientifique axé sur l’IA. Cette mission permettra de créer une « plateforme américaine pour la science et la sécurité » unifiée, combinant les supercalculateurs des 17 laboratoires nationaux du DOE, les ensembles de données scientifiques fédérales accumulées au fil des décennies et une capacité de calcul haute performance sécurisée, créant ainsi ce que l’administration décrit comme « l’instrument scientifique le plus complexe et le plus puissant jamais construit au monde ».

Dans le cadre de ce plan, l’IA générera des « modèles scientifiques fondamentaux » et des agents IA capables d’automatiser la conception d’expériences, d’exécuter des simulations, de tester des hypothèses et d’accélérer les découvertes dans des domaines stratégiques clés : biotechnologie, matériaux avancés, minéraux critiques, science de l’information quantique, fission et fusion nucléaires, exploration spatiale, semi-conducteurs et micro-électronique.

Cette initiative est présentée comme essentielle pour la sécurité énergétique, le leadership technologique et la compétitivité nationale. L’administration affirme que malgré des décennies d’augmentation des fonds consacrés à la recherche, le rendement scientifique par dollar investi a stagné et que l’IA peut radicalement stimuler la productivité de la recherche en l’espace d’une décennie.

Pour concrétiser ces ambitions, le décret présidentiel établit une structure de gouvernance : le secrétaire du DOE supervise la mise en œuvre ; l’assistant du président pour la science et la technologie assure la coordination entre les agences ; et le DOE peut s’associer à des entreprises du secteur privé, des universités et d’autres parties prenantes pour intégrer les données, les calculs et les infrastructures.

Émirats arabes unis et Afrique. L’initiative « AI for Development » a été annoncée afin de promouvoir les infrastructures numériques à travers l’Afrique, soutenue par un engagement d’un milliard de dollars américains de la part des Émirats arabes unis. Selon les déclarations officielles, l’initiative prévoit d’allouer des ressources à des secteurs tels que l’éducation, l’agriculture, l’adaptation au changement climatique, les infrastructures et la gouvernance, aidant ainsi les gouvernements africains à adopter des solutions basées sur l’IA, même lorsque les capacités nationales en matière d’IA restent limitées.

Bien que tous les détails restent à préciser (par exemple, la sélection des pays partenaires, les mécanismes de gouvernance et de contrôle), l’ampleur et l’ambition de cette initiative témoignent de la volonté des Émirats arabes unis d’agir non seulement comme un centre d’adoption de l’IA, mais aussi comme un catalyseur régional et mondial du développement fondé sur l’IA.

Ouzbékistan. L’Ouzbékistan a annoncé le lancement du projet «5 millions de leaders en IA» visant à développer ses capacités nationales dans ce domaine. Dans le cadre de ce plan, le gouvernement intégrera des programmes axés sur l’IA dans les écoles, les formations professionnelles et les universités ; formera 4,75 millions d’étudiants, 150 000 enseignants et 100 000 fonctionnaires ; et lancera des concours à grande échelle pour les start-ups et les talents dans le domaine de l’IA.

Le programme prévoit également la mise en place d’une infrastructure informatique haute performance (en partenariat avec une grande entreprise technologique), la création d’un bureau national de transfert de l’IA à l’étranger et la création de laboratoires de pointe dans les établissements d’enseignement, le tout dans le but d’accélérer l’adoption de l’IA dans tous les secteurs.

Le gouvernement considère cela comme essentiel pour moderniser l’administration publique et positionner l’Ouzbékistan parmi les 50 premiers pays au monde prêts pour l’IA.

La bulle de l’intelligence artificielle est-elle sur le point d’éclater ?

La bulle de l’IA est en train de gonfler au point d’éclater. Il existe cinq causes à la situation actuelle et cinq scénarios futurs qui indiquent comment prévenir ou gérer un éventuel « éclatement ».

La frénésie des investissements dans l’IA ne s’est pas produite dans le vide. Plusieurs facteurs ont contribué à notre tendance à la surévaluation et à nos attentes irréalistes.

Première cause : le battage médiatique. L’IA a été présentée comme l’avenir inévitable de l’humanité. Ce discours a créé une forte peur de passer à côté (FOMO), incitant les entreprises et les gouvernements à investir massivement dans l’IA, souvent sans faire preuve de réalisme.

Deuxième cause : le rendement décroissant de la puissance de calcul et des données. La formule simple qui a dominé ces dernières années était la suivante : plus de puissance de calcul (c’est-à-dire plus de GPU Nvidia) + plus de données = une meilleure IA. Cette croyance a conduit à la création d’énormes usines d’IA : des centres de données à très grande échelle et une empreinte électrique et hydrique alarmante. Le simple fait d’empiler davantage de GPU ne permet plus aujourd’hui d’obtenir que des améliorations marginales.

Troisième cause : les limites logiques et conceptuelles des grands modèles linguistiques (LLM). Les LLM se heurtent à des limites structurelles qui ne peuvent être résolues simplement en augmentant les données et la puissance de calcul. Malgré le discours dominant sur l’imminence de la superintelligence, de nombreux chercheurs de premier plan doutent que les LLM actuels puissent simplement « évoluer » vers une intelligence artificielle générale (AGI) de niveau humain.

Quatrième cause : lenteur de la transformation de l’IA. La plupart des investissements dans l’IA sont encore basés sur le potentiel, et non sur une valeur mesurable et réalisée. La technologie progresse plus rapidement que la capacité de la société à l’absorber. Les précédents hivers de l’IA dans les années 1970 et à la fin des années 1980 ont fait suite à des périodes de promesses excessives et de résultats insuffisants, entraînant des réductions drastiques des financements et l’effondrement de l’industrie.

Cinquième cause : les écarts de coûts considérables. La dernière vague de modèles open source a démontré que ces derniers, qui coûtent quelques millions de dollars, peuvent égaler ou surpasser des modèles coûtant des centaines de millions. Cela soulève des questions quant à l’efficacité et la nécessité des dépenses actuelles en matière d’IA propriétaire.

Cinq scénarios décrivent comment l’engouement actuel pourrait évoluer.

Premier scénario : le pivot rationnel (la solution classique). Une correction du marché pourrait éloigner le développement de l’IA de l’hypothèse selon laquelle plus de puissance de calcul produit automatiquement de meilleurs modèles. Au contraire, le domaine s’orienterait vers des architectures plus intelligentes, une intégration plus profonde avec les connaissances humaines et les institutions, et des systèmes plus petits, spécialisés et souvent open source. Les politiques publiques s’orientent déjà dans cette direction : le plan d’action américain en matière d’IA considère les modèles ouverts comme des atouts stratégiques. Cependant, ce pivot se heurte à la résistance des modèles propriétaires bien établis, à la dépendance vis-à-vis des données fermées et aux débats non résolus sur la manière dont les créateurs de connaissances humaines devraient être rémunérés.

Deuxième scénario : « Trop grand pour faire faillite » (le scénario du sauvetage de 2008). Une autre issue consiste à considérer les grandes entreprises d’IA comme des infrastructures économiques essentielles. Les leaders du secteur mettent déjà en garde contre l’« irrationalité » des niveaux d’investissement actuels, suggérant qu’un trimestre faible d’une entreprise clé pourrait ébranler les marchés mondiaux. Dans ce scénario, les gouvernements fournissent des filets de sécurité implicites ou explicites (crédits bon marché, réglementation favorable ou accords d’infrastructure public-privé) en partant du principe que les géants de l’IA sont d’importance systémique.

Troisième scénario : justification géopolitique (la Chine est à nos portes). La concurrence avec la Chine pourrait devenir la principale justification d’un investissement public soutenu. Les progrès rapides de la Chine, notamment avec des modèles ouverts à faible coût comme DeepSeek R1, suscitent déjà des comparaisons avec le « choc Spoutnik ». Le soutien aux champions nationaux est alors présenté comme une question de souveraineté technologique, transférant le risque des investisseurs aux contribuables.

Quatrième scénario : monopolisation de l’IA (le pari de Wall Street). Si les petites entreprises ne parviennent pas à monétiser leurs activités, les capacités en matière d’IA pourraient se concentrer entre les mains d’une poignée de géants technologiques, à l’image de la monopolisation passée dans les domaines de la recherche, des réseaux sociaux et du cloud. La domination de Nvidia dans le domaine du matériel informatique dédié à l’IA renforce cette dynamique. Les modèles open source ralentissent la consolidation, mais ne l’empêchent pas.

Cinquième scénario : l’hiver de l’IA et les nouveaux jouets numériques. Enfin, un léger hiver de l’IA pourrait apparaître à mesure que les investissements se refroidissent et que l’attention se tourne vers de nouvelles frontières : l’informatique quantique, les jumeaux numériques, la réalité immersive. L’IA resterait une infrastructure vitale, mais ne serait plus au centre de l’engouement spéculatif.

Les prochaines années montreront si l’IA deviendra un autre jouet numérique surévalué ou une partie plus mesurée, ouverte et durable de notre infrastructure économique et politique.

Ce texte est une adaptation de l’article du Dr Jovan Kurbalija intitulé « La bulle de l’IA est-elle sur le point d’éclater ? Cinq causes et cinq scénarios ». Veuillez consulter l’article original ci-dessous.

This text outlines five causes and five scenarios around the AI bubble and potential burst.

Réajustement de l’agenda numérique : points clés du document SMSI+20 Rev 1

Une version révisée du document final du SMSI+20 – Révision 1 – a été publiée le 7 novembre par les co-facilitateurs du processus intergouvernemental. Ce document servira de base aux négociations entre les États membres de l’ONU avant la réunion de haut niveau de l’Assemblée générale qui se tiendra les 16 et 17 décembre 2025.

Tout en conservant la structure générale du projet zéro publié en août, la révision 1 introduit plusieurs modifications et nouveaux éléments.

Le nouveau texte comprend des formulations révisées et renforcées à certains endroits – soulignant la nécessité de combler plutôt que de réduire les fractures numériques, présentées comme des défis multidimensionnels qui doivent être relevés pour réaliser la vision du SMSI.

Parallèlement, certaines questions ont été dépriorisées : par exemple, les références aux déchets électroniques et l’appel à l’adoption de normes mondiales de reporting sur les impacts environnementaux ont été supprimées de la section consacrée à l’environnement.

Plusieurs nouveaux éléments font également leur apparition. Dans la section consacrée aux environnements favorables, les États sont enjoints de s’abstenir de prendre des mesures unilatérales contraires au droit international.

L’importance d’une participation inclusive à l’élaboration des normes est également de nouveau reconnue.

La section consacrée aux mécanismes financiers invite le Secrétaire général à envisager la création d’un groupe de travail sur les futurs mécanismes financiers pour le développement numérique, dont les conclusions seront présentées à l’Assemblée générale des Nations unies lors de sa 81ème session.

La section consacrée à la gouvernance de l’Internet fait désormais référence aux lignes directrices NetMundial+10.

Les formulations relatives au Forum sur la gouvernance de l’Internet (FGI) restent largement fidèles au projet Zéro. Cela confirme la volonté de pérenniser le forum et de charger le Secrétaire général de soumettre des propositions sur son financement futur. De nouveaux passages invitent par ailleurs le FGI à renforcer la participation des gouvernements et des acteurs des pays en développement aux débats sur la gouvernance du web et les technologies émergentes.

Plusieurs domaines ont connu des changements de ton. Le langage utilisé dans la section consacrée aux droits de l’homme a été adouci à certains endroits (par exemple, les références aux garanties en matière de surveillance et aux menaces pesant sur les journalistes ont été supprimées).

Et la manière dont l’interaction entre le SMSI et le PNM est présentée a changé : l’accent est désormais mis sur l’alignement entre les processus du SMSI et du PNM plutôt que sur leur intégration. Par exemple, si la feuille de route conjointe PNM-SMSI visait initialement à « intégrer les engagements du PNM dans l’architecture du SMSI », elle devrait désormais « viser à renforcer la cohérence entre les processus du SMSI et du PNM ». Des ajustements correspondants sont également reflétés dans les rôles du Conseil économique et social et de la Commission de la science et de la technologie pour le développement.

Quelle est la prochaine étape ? Les inscriptions sont désormais ouvertes pour la prochaine consultation virtuelle des parties prenantes du SMSI+20, prévue le lundi 8 décembre 2025, afin de recueillir des commentaires sur le projet de document final révisé (Rev2). Les participants doivent s’inscrire avant le dimanche 7 décembre à 23 h 59 (heure de l’Est).

Une première réponse au Rev2 et un document-cadre guideront la session et seront publiés dès qu’ils seront disponibles.

Cette consultation s’inscrit dans le cadre des préparatifs de la réunion de haut niveau de l’Assemblée générale consacrée à l’examen global de la mise en œuvre des résultats du Sommet mondial sur la société de l’information (SMSI+20), qui se tiendra les 16 et 17 décembre 2025.

Programmation et climat : les enjeux de l’IA et du numérique à la COP 30

La COP 30, la 30e conférence annuelle des Nations unies sur le climat, s’est officiellement achevée vendredi dernier, le 21 novembre. Alors que le calme revient à Belém, nous examinons de plus près les résultats obtenus et leurs implications pour les technologies numériques et l’IA.

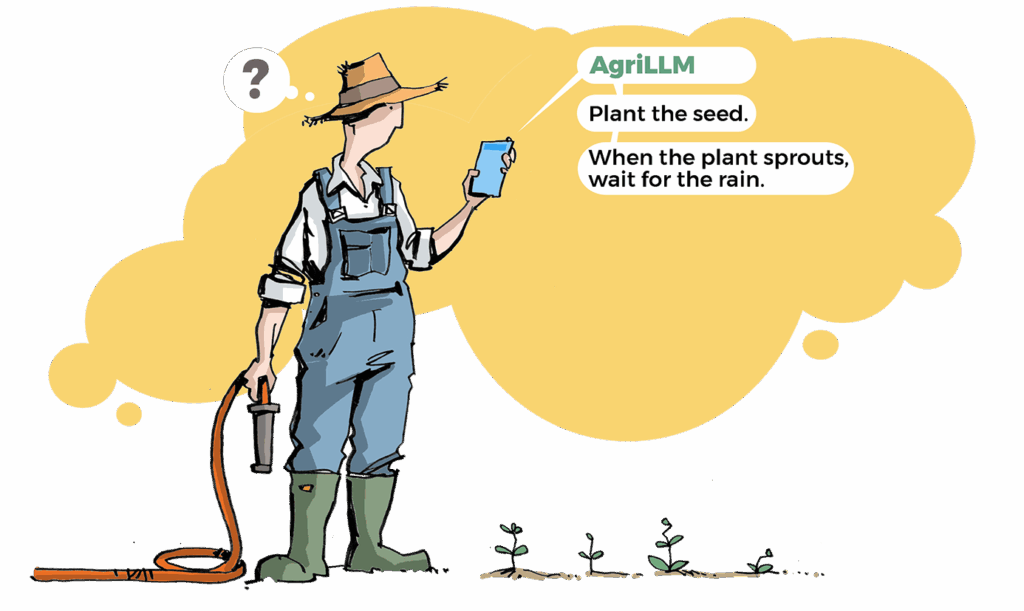

Dans le domaine de l’agriculture, la dynamique est clairement en train de s’accélérer. Le Brésil et les Émirats arabes unis ont dévoilé AgriLLM, le premier modèle linguistique open source de grande envergure spécialement conçu pour l’agriculture, développé avec le soutien de partenaires internationaux dans le domaine de la recherche et de l’innovation. L’objectif est de fournir aux gouvernements et aux organisations locales une base numérique commune pour créer des outils permettant de fournir aux agriculteurs des conseils pertinents et adaptés à leur situation locale. Parallèlement, l’initiative AIM for Scale vise à fournir des services de conseil numériques, notamment des prévisions climatiques et des informations sur les cultures, à 100 millions d’agriculteurs.

Les villes et les infrastructures s’engagent également davantage dans la transformation numérique. Grâce au Fonds de développement de la résilience des infrastructures, les assureurs, les banques de développement et les investisseurs privés mettent en commun leurs capitaux pour financer des infrastructures résilientes au changement climatique dans les économies émergentes, qu’il s’agisse de systèmes d’énergie propre et d’approvisionnement en eau ou de réseaux numériques nécessaires pour maintenir les communautés connectées et protégées en cas de chocs climatiques.

Le programme numérique le plus explicite a vu le jour dans le cadre des « facilitateurs et accélérateurs ». Le Brésil et ses partenaires ont lancé la première infrastructure numérique pour l’action climatique au monde, une initiative mondiale visant à aider les pays à adopter des biens publics numériques ouverts dans des domaines tels que la réponse aux catastrophes, la gestion de l’eau et l’agriculture résiliente au climat. Le défi de l’innovation qui l’accompagne soutient déjà de nouvelles solutions conçues pour être déployées à grande échelle.

Le Green Digital Action Hub a également été lancé et aidera les pays à mesurer et à réduire l’empreinte environnementale de la technologie, tout en élargissant l’accès aux outils qui utilisent la technologie au service de la durabilité.

La formation et le renforcement des capacités ont fait l’objet d’une attention particulière grâce au nouveau AI Climate Institute, qui aidera les pays du Sud à développer et à déployer des applications d’IA adaptées aux besoins locaux, en particulier des modèles légers et économes en énergie.

Le Nature’s Intelligence Studio, basé en Amazonie, soutiendra l’innovation inspirée par la nature et introduira des outils d’IA ouverts qui aideront à relever les défis réels en matière de durabilité grâce à des solutions biosourcées.

Enfin, la COP 30 a réalisé une première en inscrivant fermement l’intégrité de l’information à l’ordre du jour de l’action climatique.

La désinformation et la mésinformation étant reconnues comme un risque mondial majeur, les gouvernements et les partenaires ont lancé une déclaration et un nouveau processus multipartite visant à renforcer la transparence, la responsabilité partagée et la confiance du public dans les informations climatiques, y compris les plateformes numériques qui les façonnent.

Vue d’ensemble. Dans tous les domaines, la COP 30 a envoyé un message clair : la dimension numérique de l’action climatique n’est pas facultative, elle fait partie intégrante de la mise en œuvre de l’action climatique.

De l’Australie à l’Union européenne : de nouvelles mesures protègent les enfants contre les dangers en ligne

Les interdictions visant les moins de 16 ans se généralisent à l’échelle mondiale, et l’Australie est le pays qui va le plus loin dans cette voie. Les autorités de régulation australiennes ont désormais élargi le champ d’application de l’interdiction pour inclure des plateformes telles que Twitch, qui est considérée comme soumise à une restriction d’âge en raison de ses fonctionnalités d’interaction sociale. Meta a commencé à informer les utilisateurs australiens présumés âgés de moins de 16 ans que leurs comptes Facebook et Instagram seront désactivés à compter du 4 décembre, une semaine avant l’entrée en vigueur officielle de la loi le 10 décembre.

Afin d’accompagner les familles dans cette transition, le gouvernement a mis en place un groupe consultatif de parents, réunissant des organisations représentant divers types de ménages, afin d’aider les parents à guider leurs enfants en matière de sécurité en ligne, de communication et de connexion numérique sécurisée.

L’interdiction a déjà suscité une opposition. Les principales plateformes de réseaux sociaux ont critiqué cette interdiction, mais ont indiqué qu’elles s’y conformeraient, YouTube étant la dernière à se rallier. Cependant, l’interdiction est désormais contestée devant la Haute Cour par deux jeunes de 15 ans, soutenus par le groupe de défense Digital Freedom Project. Ils affirment que la loi limite de manière injuste la capacité des moins de 16 ans à participer au débat public et à l’expression politique, réduisant ainsi au silence les jeunes sur des questions qui les concernent directement.

La Malaisie prévoit également d’interdire les comptes sur les réseaux sociaux aux personnes de moins de 16 ans à partir de 2026. Le gouvernement a approuvé cette mesure afin de protéger les enfants contre les dangers en ligne tels que le cyberharcèlement, les escroqueries et l’exploitation sexuelle. Les autorités envisagent des approches telles que la vérification électronique de l’âge à l’aide de cartes d’identité ou de passeports, bien que la date exacte de mise en œuvre n’ait pas encore été fixée.

Les législateurs européens ont proposé des protections similaires. Le Parlement européen a adopté un rapport non législatif appelant à une harmonisation de l’âge minimum à 16 ans au sein de l’UE pour les réseaux sociaux, les plateformes de partage de vidéos et les assistants IA. L’accès des 13-16 ans ne serait autorisé qu’avec le consentement parental. Les députés soutiennent le développement d’une application européenne de vérification d’âge et du portefeuille d’identité numérique européen (eID), tout en insistant sur le fait que ces outils ne dispensent pas les plateformes de concevoir des services sûrs par défaut.

Au-delà des restrictions d’âge, l’UE renforce les mesures de protection de manière plus générale. Les États membres ont approuvé une position du Conseil en faveur d’un règlement visant à prévenir et à combattre les abus sexuels sur enfants en ligne qui définit des obligations concrètes et exécutoires pour les fournisseurs de services en ligne. Les plateformes devront procéder à des évaluations formelles des risques afin d’identifier comment leurs services pourraient être utilisés pour diffuser du matériel pédopornographique ou pour solliciter des enfants, puis mettre en place des mesures d’atténuation, allant de paramètres de confidentialité par défaut plus sûrs pour les enfants et d’outils de signalement pour les utilisateurs à des garanties techniques. Les États membres désigneront des autorités nationales de coordination et compétentes qui pourront examiner ces évaluations des risques, obliger les fournisseurs à mettre en œuvre des mesures d’atténuation et, si nécessaire, imposer des sanctions financières en cas de non-respect.

Il est important de noter que le Conseil introduit une classification des risques à trois niveaux pour les services en ligne (élevé, moyen, faible). Les services jugés à haut risque, sur la base de critères concrets tels que le type de service, peuvent être tenus non seulement d’appliquer des mesures d’atténuation plus strictes, mais aussi de contribuer au développement de technologies visant à réduire ces risques. Les moteurs de recherche peuvent être contraints de supprimer des résultats ; les autorités compétentes peuvent exiger la suppression ou le blocage de l’accès aux contenus pédopornographiques. Cette position maintient et vise à rendre permanente une exemption temporaire existante qui permet aux fournisseurs (par exemple, les services de messagerie) de scanner volontairement les contenus à la recherche de pédopornographie — une exemption qui expire le 3 avril 2026.

Afin de mettre en œuvre et de coordonner l’application de la réglementation, celle-ci prévoit la création d’un nouvel organe régulateur, le Centre de l’UE sur les abus sexuels sur enfants. Le Centre traitera et évaluera les informations et signalements transmis par les plateformes, gérera une base de données contenant les rapports des fournisseurs et ainsi qu’une base d’indicateurs d’abus sexuels, que les entreprises pourront utiliser pour leurs activités de détection volontaire, soutiendra les victimes à obtenir le retrait ou le blocage de l’accès aux contenus les mettant en scène, et partagera les informations pertinentes avec Europol et les services répressifs nationaux. Le siège du Centre n’a pas encore été fixé ; il fera l’objet de négociations avec le Parlement européen. L’accord trouvé au sein du Conseil marque une étape décisive. Les négociations formelles en « trilogue » (discussions entre le Conseil, le Parlement et la Commission) peuvent désormais débuter, le Parlement ayant déjà adopté sa propre position en novembre 2023.

Le rapport du Parlement européen s’attaque également aux risques numériques du quotidien. Les députés appellent à l’interdiction des pratiques addictives les plus nocives, notamment : le défilement infini (infinite scroll), la lecture automatique (autoplay), les boucles de récompense (reward loops), le mécanisme de “tirer pour rafraîchir” (pull-to-refresh). D’autres fonctionnalités addictives devraient être désactivées par défaut pour les mineurs. Le Parlement demande instamment l’interdiction des algorithmes de recommandation basés sur l’engagement pour les jeunes utilisateurs, tout en exigeant que les règles claires du règlement sur les services numériques (DSA) soient étendues aux plateformes de partage de vidéos. Le rapport cible également les mécanismes de jeu qui imitent les jeux de hasard. Les « loot boxes » (coffres à butin), les récompenses aléatoires intégrées aux applications et les mécaniques de « pay-to-progress » (payer pour progresser) devraient être proscrites afin de protéger les plus jeunes de l’engrenage financier et psychologique. Enfin, le texte aborde l’exploitation commerciale, demandant instamment l’interdiction pour les plateformes de proposer des incitations financières pour le « kidfluencing », c’est-à-dire l’utilisation d’enfants comme influenceurs.

Les députés européens ont pointé du doigt les risques liés à l’IA générative : deepfakes, chatbots de compagnie, agents d’IA et applications de nudité par IA créant des images manipulées non consensuelles, appelant à une action juridique et éthique urgente. La rapporteure Christel Schaldemose a présenté ces mesures comme le tracé d’une ligne rouge claire : les plateformes ne sont « pas conçues pour les enfants » et l’expérimentation consistant à laisser des designs addictifs et manipulateurs cibler les mineurs doit prendre fin.

Une nouvelle initiative multilatérale est également en cours : le commissaire à la sécurité électronique (Australie), l’Ofcom (Royaume-Uni) et la DG CNECT de la Commission européenne vont coopérer afin de protéger les droits, la sécurité et la vie privée des enfants en ligne.

Les instances de régulation appliqueront les lois relatives à la sécurité en ligne, exigeront des plateformes qu’elles évaluent et atténuent les risques pour les enfants, encourageront les technologies préservant la vie privée telles que la vérification de l’âge, et s’associeront à la société civile et au monde universitaire afin que les approches réglementaires restent ancrées dans la réalité.

Un nouveau groupe technique trilatéral sera créé afin d’étudier comment les systèmes de vérification de l’âge peuvent fonctionner de manière fiable et interopérable, renforçant ainsi les preuves pour de futures mesures réglementaires.

Les députés européens ont mis en avant les risques liés à l’IA générative (deepfakes, chatbots de compagnie, agents IA et applications de nudité alimentées par l’IA qui créent des images modifiées sans consentement) et ont appelé à une action juridique et éthique urgente. La rapporteure Christel Schaldemose a présenté ces mesures comme une ligne claire : les plateformes ne sont « pas conçues pour les enfants » et l’expérience consistant à laisser des designs addictifs et manipulateurs cibler les mineurs doit cesser.

Une nouvelle initiative multilatérale est également en cours : le commissaire à la sécurité électronique (Australie), l’Ofcom (Royaume-Uni) et la DG CNECT de la Commission européenne vont coopérer afin de protéger les droits, la sécurité et la vie privée des enfants en ligne.

Les instances de régulation appliqueront les lois relatives à la sécurité en ligne, exigeront des plateformes qu’elles évaluent et atténuent les risques pour les enfants, encourageront les technologies préservant la vie privée telles que la vérification de l’âge, et s’associeront à la société civile et au monde universitaire afin que les approches réglementaires restent ancrées dans la réalité.

Un nouveau groupe technique trilatéral sera créé afin d’étudier comment les systèmes de vérification de l’âge peuvent fonctionner de manière fiable et interopérable, renforçant ainsi les preuves pour de futures mesures réglementaires.

L’objectif global est d’aider les enfants et les familles à utiliser Internet de manière plus sûre et plus confiante, en favorisant la culture numérique, l’esprit critique et en rendant les plateformes en ligne plus responsables.

Cloud en panne : le grand désert numérique.

Le 18 novembre, Cloudflare, l’infrastructure invisible qui soutient des millions de sites web, a connu une panne que l’entreprise qualifie de « la plus grave depuis 2019 ». Les utilisateurs du monde entier ont reçu des messages d’erreur interne du serveur lorsque des services tels que X et ChatGPT ont été temporairement hors ligne.

La cause était une erreur de configuration interne. Une modification de routine des autorisations dans une base de données ClickHouse a entraîné la création d’un « fichier de fonctionnalités » mal formé utilisé par l’outil de gestion des robots de Cloudflare. Ce fichier a doublé de taille de manière inattendue et, lorsqu’il a été diffusé sur le réseau mondial de Cloudflare, il a dépassé les limites intégrées, provoquant des pannes en cascade.

Alors que les ingénieurs s’empressaient d’isoler le fichier défectueux, le trafic a progressivement repris. En milieu d’après-midi, Cloudflare a interrompu la propagation, remplacé le fichier corrompu et redémarré les systèmes clés ; le réseau a été entièrement rétabli quelques heures plus tard.

Une vision plus large. Cet incident n’est pas isolé. Le mois dernier, Microsoft Azure a subi une panne de plusieurs heures qui a perturbé les clients professionnels en Europe et aux États-Unis, tandis qu’Amazon Web Services (AWS) a connu des interruptions intermittentes affectant les plateformes de streaming et les sites de commerce électronique. Ces événements, combinés à la panne de Cloudflare, soulignent la fragilité de l’infrastructure cloud mondiale.

Cette panne survient à un moment politiquement sensible dans le débat sur la politique européenne en matière de cloud. Les régulateurs bruxellois enquêtent déjà sur AWS et Microsoft Azure afin de déterminer s’ils doivent être désignés comme « gardiens » au titre de la loi européenne sur les marchés numériques (DMA). Ces enquêtes visent à évaluer si leur position dominante dans l’infrastructure cloud leur confère un contrôle disproportionné, même si, techniquement, ils ne répondent pas aux critères habituels de taille fixés par la loi.

Ce schéma récurrent met en évidence une vulnérabilité majeure de l’Internet moderne, née d’une dépendance excessive à l’égard d’une poignée de fournisseurs essentiels. Lorsqu’un de ces piliers centraux vacille, que ce soit en raison d’une mauvaise configuration, d’un bug logiciel ou d’un problème régional, les effets se répercutent à tous les niveaux. La concentration même des services, qui permet l’efficacité et l’évolutivité, crée également des points de défaillance uniques avec des conséquences en cascade.

Le mois dernier à Genève

Le monde de la gouvernance numérique a été très actif à Genève en novembre. Voici ce que nous avons essayé de suivre.

Le CERN présente sa stratégie en matière d’intelligence artificielle pour faire progresser la recherche et les opérations

Le CERN a approuvé une stratégie globale en matière d’IA afin de guider son utilisation dans les domaines de la recherche, des opérations et de l’administration. Cette stratégie rassemble différentes initiatives au sein d’un cadre cohérent visant à promouvoir une IA responsable et efficace au service de l’excellence scientifique et opérationnelle.

Elle s’articule autour de quatre objectifs principaux : accélérer les découvertes scientifiques, améliorer la productivité et la fiabilité, attirer et développer les talents, et permettre le déploiement à grande échelle de l’IA grâce à des partenariats stratégiques avec l’industrie et les États membres.

Des outils communs et des expériences partagées entre les différents secteurs renforceront la communauté du CERN et garantiront un déploiement efficace.

La mise en œuvre impliquera des plans prioritaires et une collaboration avec les programmes de l’UE, l’industrie et les États membres afin de renforcer les capacités, d’obtenir des financements et de développer les infrastructures. Les applications de l’IA soutiendront les expériences de physique des hautes énergies, les futurs accélérateurs, les détecteurs et la prise de décision fondée sur les données.

Le groupe intersessions 2025-2026 de la Commission des Nations Unies pour la science et la technologie au service du développement (CSTD)

La Commission de la science et de la technique au service du développement (CSTD) de l’ONU a tenu sa réunion intersessions 2025-2026 le 17 novembre au Palais des Nations à Genève. L’ordre du jour était axé sur la science, la technologie et l’innovation à l’ère de l’IA, avec des contributions d’experts issus du monde universitaire, d’organisations internationales et du secteur privé. Les délégations ont également examiné les progrès réalisés dans la mise en œuvre du SMSI avant le processus SMSI+20 et ont reçu des informations actualisées sur la mise en œuvre du Pacte numérique mondial (PNM) et les travaux en cours sur la gouvernance des données au sein du groupe de travail dédié de la CSTD. Les conclusions et recommandations du panel seront examinées lors de la vingt-neuvième session de la Commission en 2026.

Quatrième réunion du groupe de travail multipartite de la CSTD des Nations Unies sur la gouvernance des données à tous les niveaux

Le groupe de travail multipartite de la CSTD sur la gouvernance des données à tous les niveaux s’est réuni pour la quatrième fois les 18 et 19 novembre. Le programme a débuté par des allocutions d’ouverture et l’adoption officielle de l’ordre du jour. Le secrétariat de la CNUCED a ensuite présenté un aperçu des contributions soumises depuis la dernière session, en soulignant les nouveaux domaines de convergence et de divergence entre les parties prenantes. La réunion s’est poursuivie par des délibérations de fond organisées autour de quatre axes couvrant les dimensions clés de la gouvernance des données : les principes applicables à tous les niveaux ; l’interopérabilité entre les systèmes ; le partage des avantages des données ; et la mise en place de flux de données sûrs, sécurisés et fiables, y compris au-delà des frontières. Ces discussions ont pour objectif d’explorer les approches pratiques, les défis existants et les voies possibles vers un consensus.

Après la pause déjeuner, les délégués se sont réunis à nouveau pour une séance plénière qui a duré tout l’après-midi afin de poursuivre les échanges thématiques, avec des occasions d’interaction entre les États membres, le secteur privé, la société civile, le monde universitaire, la communauté technique et les organisations internationales.

La deuxième journée a été consacrée aux étapes importantes du groupe de travail. Les délégations ont examiné les grandes lignes, le calendrier et les attentes concernant le rapport d’étape à présenter à l’Assemblée générale, ainsi que le processus de sélection du prochain président du groupe de travail. La session s’est conclue par un accord sur le calendrier des prochaines réunions et sur toute question supplémentaire soulevée par les participants.

Dialogue sur l’innovation 2025 : Les neurotechnologies et leurs implications pour la paix et la sécurité internationales

On 24 November, UNIDIR hosted its Innovations Dialogue on neurotechnologies and their implications for international peace and security in Geneva and online. Experts from neuroscience, law, ethics, and security policy discussed developments such as brain-computer interfaces and cognitive enhancement tools, exploring both their potential applications and the challenges they present, including ethical and security considerations. The event included a poster exhibition on responsible use and governance approaches.

14e Forum des Nations Unies sur les entreprises et les droits de l’Homme

Le 14e Forum des Nations Unies sur les entreprises et les droits de l’Homme s’est tenu du 24 au 26 novembre à Genève et en ligne, sur le thème « Accélérer l’action en faveur des entreprises et des droits de l’Homme face aux crises et aux transformations ». Le forum a abordé des questions clés, notamment la protection des droits de l’Homme à l’ère de l’IA et l’exploration des droits de l’Homme et du travail sur les plateformes dans la région Asie-Pacifique dans le contexte de la transformation numérique en cours. En marge de l’événement, une session a également examiné de près “le travail de l’ombre” derrière l’intelligence artificielle.